बीटा वितरण: Difference between revisions

No edit summary |

No edit summary |

||

| (23 intermediate revisions by 3 users not shown) | |||

| Line 1: | Line 1: | ||

{{short description|Probability distribution}} | {{short description|Probability distribution}} | ||

{{Distinguish| | {{Distinguish|बीटा फलन}} | ||

{{Probability distribution | {{Probability distribution | ||

| name = Beta | | name = Beta | ||

| Line 37: | Line 37: | ||

}} | }} | ||

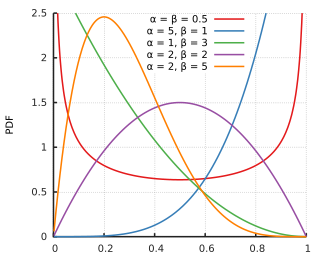

संभाव्यता सिद्धांत और सांख्यिकी में, बीटा वितरण दो | संभाव्यता सिद्धांत और सांख्यिकी में, '''बीटा वितरण''' के दो धनात्मक [[सांख्यिकीय पैरामीटर|सांख्यिकीय मापदंड]] होते है इसके संदर्भ में अंतराल [0,1] पर परिभाषित निरंतर संभाव्यता वितरण का परिवार है, जिसे 'अल्फा' (''α'') और बीटा (β) द्वारा दर्शाया गया है। जो वेरिएबल के घातांक और क्रमशः 1 के पूरक के रूप में दिखाई देते हैं, और वितरण के [[आकार पैरामीटर|आकार मापदंड]] को नियंत्रित करते हैं। | ||

विभिन्न प्रकार के विषयों में परिमित लंबाई के अंतराल तक सीमित [[यादृच्छिक चर]] | विभिन्न प्रकार के विषयों में परिमित लंबाई के अंतराल तक सीमित [[यादृच्छिक चर|यादृच्छिक वेरिएबल]] है जिन्हें उनके व्यवहार को मॉडल करने के लिए बीटा वितरण के रूप में प्रयुक्त किया गया है। बीटा वितरण प्रतिशत और अनुपात के यादृच्छिक व्यवहार के लिए उपयुक्त मॉडल है। | ||

बायेसियन अनुमान में, बीटा वितरण बर्नौली वितरण, [[द्विपद वितरण]], [[नकारात्मक द्विपद वितरण]] और [[ज्यामितीय वितरण]] वितरण के लिए [[संयुग्मित पूर्व वितरण]] है। | बायेसियन अनुमान में, बीटा वितरण बर्नौली वितरण, [[द्विपद वितरण]], [[नकारात्मक द्विपद वितरण|ऋणात्मक द्विपद वितरण]] और [[ज्यामितीय वितरण]] वितरण के लिए [[संयुग्मित पूर्व वितरण]] है। | ||

यहां चर्चा किए गए बीटा वितरण के सूत्रीकरण को पहली तरह के बीटा वितरण के रूप में भी जाना जाता है, जबकि | यहां चर्चा किए गए बीटा वितरण के सूत्रीकरण को पहली तरह के बीटा वितरण के रूप में भी जाना जाता है, जबकि दूसरी तरह का बीटा वितरण [[बीटा प्राइम वितरण]] का वैकल्पिक नाम है। अनेक वेरिएबलों के सामान्यीकरण को [[डिरिचलेट वितरण]] कहा जाता है। | ||

== परिभाषाएँ == | == परिभाषाएँ == | ||

=== संभाव्यता घनत्व | === संभाव्यता घनत्व फलन === | ||

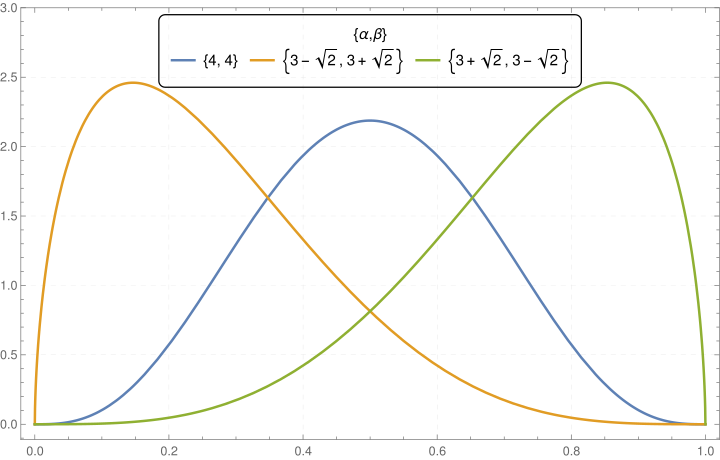

[[File:PDF of the Beta distribution.gif|thumb|इसके मापदंडों के विभिन्न मूल्यों के लिए बीटा वितरण का एनीमेशन।]]प्रायिकता घनत्व | [[File:PDF of the Beta distribution.gif|thumb|इसके मापदंडों के विभिन्न मूल्यों के लिए बीटा वितरण का एनीमेशन।]]प्रायिकता घनत्व फलन (पीडीएफ) बीटा वितरण के लिए {{nowrap|0 ≤ ''x'' ≤ 1}}, और आकार मापदंड α, β > 0, वेरिएबल x और उसके प्रतिबिंब सूत्र का {{nowrap|(1 − ''x'')}} शक्ति कार्य है निम्नलिखित नुसार: | ||

: <math> | : <math> | ||

| Line 58: | Line 58: | ||

\end{align} | \end{align} | ||

</math> | </math> | ||

जहां Γ(z) गामा फलन है। [[बीटा समारोह]], <math>\Beta</math>, यह सुनिश्चित करने के लिए [[सामान्यीकरण स्थिरांक]] है कि कुल संभाव्यता 1 है। उपरोक्त समीकरणों में x यादृच्छिक | जहां Γ(z) गामा फलन है। [[बीटा समारोह|बीटा फलन]] , <math>\Beta</math>, यह सुनिश्चित करने के लिए [[सामान्यीकरण स्थिरांक]] है कि कुल संभाव्यता 1 है। उपरोक्त समीकरणों में x यादृच्छिक वेरिएबल X का अहसास (संभावना) है—एक प्रेक्षित मान जो वास्तव में हुआ है। | ||

इस परिभाषा में दोनों छोर | इस परिभाषा में दोनों छोर सम्मिलित हैं {{nowrap|1=''x'' = 0}} और {{nowrap|1=''x'' = 1}}, जो संभाव्यता वितरण की अन्य सूची के लिए परिभाषाओं के अनुरूप है, जो बीटा वितरण के विशेष स्तिथियाँ हैं, उदाहरण के लिए [[आर्क्सिन वितरण]], और अनेक लेखकों के साथ संगत है, जैसे '''|'''एन। एल. जॉनसन और एस. कोटज़।<ref name=JKB /><ref name=Keeping>{{cite book|last=Keeping|first=E. S.|title=सांख्यिकीय निष्कर्ष का परिचय|url=https://archive.org/details/introductiontost0000keep|url-access=registration|year=2010|publisher=Dover Publications|isbn=978-0486685021}}</ref><ref name=Wadsworth /><ref name="Hahn and Shapiro">{{cite book|last1=Hahn|first1=Gerald J.|last2=Shapiro|first2=S.|title=इंजीनियरिंग में सांख्यिकीय मॉडल (विली क्लासिक्स लाइब्रेरी)|year=1994|publisher=Wiley-Interscience|isbn=978-0471040651}}</ref> चूंकि, {{nowrap|1=''x'' = 0}} और {{nowrap|1=''x'' = 1}} का समावेश {{nowrap|''α'', ''β'' < 1}} के लिए काम नहीं करता है ; तदनुसार, विलियम फेलर सहित अनेक अन्य लेखक | डब्ल्यू। ,<ref name=Feller>{{cite book|last=Feller|first=William|title=An Introduction to Probability Theory and Its Applications, Vol. 2|year=1971|publisher=Wiley|isbn=978-0471257097|url=https://archive.org/details/introductiontopr00fell}}</ref><ref name="Handbook of Beta Distribution" /><ref name=Panik /> {{nowrap|1=''x'' = 0}} और {{nowrap|1=''x'' = 1}}, फलेर सिरों को बाहर करना चुनें (जिससे दो छोर वास्तव में घनत्व फलन के डोमेन का भाग न हों) और इसके अतिरिक्त {{nowrap|0 < ''x'' < 1}} पर विचार करें . | ||

नॉर्मन लॉयड जॉनसन सहित | नॉर्मन लॉयड जॉनसन सहित अनेक लेखक एन. एल. जॉनसन और सैमुअल कोट्ज़ (एस. कोटज़),<ref name=JKB /> बीटा वितरण के आकार मापदंडों के लिए प्रतीकों p और q (α और β के अतिरिक्त) का उपयोग करें,तथा यह पारंपरिक रूप से बर्नौली वितरण के मापदंडों के लिए उपयोग किए जाने वाले प्रतीकों की याद दिलाते हैं, क्योंकि बीटा वितरण सीमा में बर्नौली वितरण तक पहुंचता है जब दोनों आकार मापदंड α और β शून्य के मान तक पहुंचते हैं। | ||

निम्नलिखित में, | निम्नलिखित में, मापदंड α और β के साथ यादृच्छिक वेरिएबल X बीटा-वितरित द्वारा निरूपित किया जाएगा:<ref name="Mathematical Statistics with MATHEMATICA"/><ref name="Kruschke2011">{{cite book|last=Kruschke|first=John K.|author-link=John K. Kruschke|title=Doing Bayesian data analysis: A tutorial with R and BUGS|year=2011|publisher=Academic Press / Elsevier|location=p. 83|isbn=978-0123814852}}</ref> | ||

:<math>X \sim \operatorname{Beta}(\alpha, \beta)</math> | :<math>X \sim \operatorname{Beta}(\alpha, \beta)</math> | ||

सांख्यिकीय साहित्य में प्रयुक्त बीटा-वितरित यादृच्छिक | सांख्यिकीय साहित्य में प्रयुक्त बीटा-वितरित यादृच्छिक वेरिएबल के लिए अन्य अंकन <math>X \sim \mathcal{B}e(\alpha, \beta)</math><ref name=BergerDecisionTheory>{{cite book |last=Berger |first=James O. |title=सांख्यिकीय निर्णय सिद्धांत और बायेसियन विश्लेषण|edition=2nd |year=2010 |publisher=Springer |isbn=978-1441930743}}</ref> और <math>X \sim \beta_{\alpha, \beta}</math> हैं.<ref name=Feller /> | ||

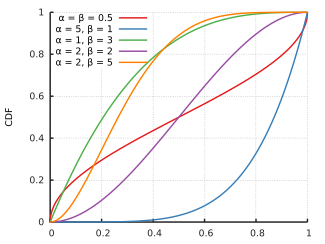

=== संचयी वितरण फलन === | |||

संचयी वितरण फलन है | |||

:<math>F(x;\alpha,\beta) = \frac{\Beta{}(x;\alpha,\beta)}{\Beta{}(\alpha,\beta)} = I_x(\alpha,\beta) | |||

</math> | |||

जहाँ <math>\Beta(x;\alpha,\beta)</math> बीटा फलन है और <math>I_x(\alpha,\beta)</math> अधूरा बीटा फलन [[नियमित अधूरा बीटा फ़ंक्शन|नियमित अधूरा बीटा फलन]] है। | |||

=== वैकल्पिक | === वैकल्पिक मापदंडकरण === | ||

==== दो | ==== दो मापदंड ==== | ||

== माध्य और | == माध्य और प्रतिरूप आकार == | ||

बीटा वितरण को इसके औसत μ | बीटा वितरण को इसके औसत μ{{nowrap|1=(0 < ''μ'' < 1)}} और दो आकार के मापदंडों का योग {{nowrap|1= ''ν'' = ''α'' + ''β'' > 0}}( पी 83)<ref name="Kruschke2011" />. के संदर्भ में भी पुनर्मूल्यांकित किया जा सकता है α पोस्टीरियर और β पोस्टीरियर द्वारा पोस्टीरियर बीटा डिस्ट्रीब्यूशन के शेप मापदंड्स को अस्वीकार करना , जिसके परिणाम स्वरूप बेयस प्रमेय को द्विपदीय संभावना फलन और पूर्व संभावना पर प्रयुक्त किया जाता है, प्रतिरूप आकार होने के लिए दोनों आकार मापदंडों के जोड़ की व्याख्या = ν = α·पोस्टीरियर + β· हाल्डेन पूर्व संभाव्यता बीटा (0,0) के लिए केवल पश्च भाग ही सही है। विशेष रूप से, बेयस (यूनिफ़ॉर्म) पूर्व बीटा (1,1) के लिए सही व्याख्या प्रतिरूप आकार = α·पोस्टीरियर + β पोस्टीरियर - 2, या ν = (प्रतिरूप आकार) + 2 होगी। 2 से बहुत बड़े सैंपल आकार के लिए, इन दो पूर्वों के मध्य का अंतर नगण्य हो जाता है। (अधिक विवरण के लिए अनुभाग या बायेसियन अनुमान देखें।) ν = α + β को बीटा वितरण के प्रतिरूप आकार के रूप में संदर्भित किया जाता है, किन्तु किसी को यह याद रखना चाहिए कि यह सख्ती से बोलना,जरुरी है तथा द्विपदीय संभावना फलन का प्रतिरूप आकार केवल उपयोग करते समय बेज़ प्रमेय से पहले हाल्डेन बीटा (0,0) होता है । | ||

यह पैरामीट्रिजेशन बायेसियन | यह पैरामीट्रिजेशन बायेसियन मापदंड आकलन में उपयोगी हो सकता है। उदाहरण के लिए, कोई व्यक्ति अनेक व्यक्तियों को परीक्षण दे सकता है। यदि यह मान लिया जाए कि प्रत्येक व्यक्ति का स्कोर (0 ≤ θ ≤ 1) संख्या -स्तर बीटा वितरण से लिया गया है, तब महत्वपूर्ण आँकड़ा इस संख्या -स्तर वितरण का माध्य है। माध्य और प्रतिरूप आकार मापदंड आकार मापदंड α और β के माध्यम से संबंधित हैं<ref name=Kruschke2011/> | ||

: α = μν, β = (1 - μ)ν | : α = μν, β = (1 - μ)ν | ||

इस सांख्यिकीय | इस सांख्यिकीय मापदंड के अनुसार है , जिसको प्रतिरूप आकार के लिए धनात्मक वास्तविकताओं पर माध्य पर अनौपचारिक पूर्व संभावना, और अस्पष्ट पूर्व संभावना (जैसे घातीय या गामा वितरण) रख सकते हैं, यदि वे स्वतंत्र हैं, और पूर्व डेटा या विश्वासियें है तो इसे सही ठहराते हैं। | ||

=== मोड और एकाग्रता === | === मोड और एकाग्रता === | ||

अवतल कार्य बीटा वितरण | अवतल कार्य बीटा वितरण जिनके <math>\alpha,\beta>1</math> पास है मोड और एकाग्रता के संदर्भ में पैरामीट्रिज्ड किया जा सकता है। साधन, <math>\omega=\frac{\alpha-1}{\alpha+\beta-2}</math>, और एकाग्रता, <math>\kappa = \alpha + \beta</math>, का उपयोग सामान्य आकार के मापदंडों को निम्नानुसार परिभाषित करने के लिए किया जा सकता है:<ref name="Kruschke2015">{{cite book|last=Kruschke|first=John K.|author-link=John K. Kruschke|title=Doing Bayesian Data Analysis: A Tutorial with R, JAGS and Stan|year=2015|publisher=Academic Press / Elsevier|isbn=978-0-12-405888-0}}</ref> | ||

:<math>\begin{align} | :<math>\begin{align} | ||

\alpha &= \omega (\kappa - 2) + 1\\ | \alpha &= \omega (\kappa - 2) + 1\\ | ||

\beta &= (1 - \omega)(\kappa - 2) + 1 | \beta &= (1 - \omega)(\kappa - 2) + 1 | ||

\end{align}</math> | \end{align}</math> | ||

मोड के लिए, <math>0<\omega<1</math>, अच्छी तरह से परिभाषित होने के लिए, हमें | मोड के लिए, <math>0<\omega<1</math>, अच्छी तरह से परिभाषित होने के लिए, हमें <math>\alpha,\beta>1</math>, या समकक्ष <math>\kappa>2</math>. की आवश्यकता है यदि इसके अतिरिक्त हम एकाग्रता को <math>c=\alpha+\beta-2</math> के रूप में परिभाषित करते हैं तो स्थिति <math>c>0</math> सरल हो जाती है और <math>\alpha=1+c\omega</math> और <math>\beta=1+c(1-\omega)</math> पर बीटा घनत्व पर इस प्रकार लिखा जा सकता है: | ||

:<math> | :<math> | ||

f(x;\omega,c) = \frac{x^{c\omega}(1-x)^{c(1-\omega)}}{\Beta\bigl(1+c\omega,1+c(1-\omega)\bigr)} | f(x;\omega,c) = \frac{x^{c\omega}(1-x)^{c(1-\omega)}}{\Beta\bigl(1+c\omega,1+c(1-\omega)\bigr)} | ||

</math> | </math> | ||

जहाँ <math>c</math> सीधे पर्याप्त आँकड़ों <math>\log(x)</math>और <math>\log(1-x)</math>. को मापता है, यह भी ध्यान दें कि सीमा में, <math>c\to0</math>, वितरण सपाट हो जाता है। | |||

=== माध्य और विचरण === | === माध्य और विचरण === | ||

उपरोक्त वर्गों में दिए गए (युग्मित) समीकरणों की प्रणाली को माध्य के समीकरणों के रूप में हल करना और मूल मापदंडों α और β के संदर्भ में बीटा वितरण का विचरण, माध्य के संदर्भ में α और β मापदंडों को व्यक्त कर सकता है ( μ) और विचरण (var): | उपरोक्त वर्गों में दिए गए (युग्मित) समीकरणों की प्रणाली को माध्य के समीकरणों के रूप में हल करना और मूल मापदंडों α और β के संदर्भ में बीटा वितरण का विचरण , माध्य के संदर्भ में α और β मापदंडों को व्यक्त कर सकता है ( μ) और विचरण (var): | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 112: | Line 110: | ||

\alpha&= \mu \nu =\mu \left(\frac{\mu(1-\mu)}{\text{var}}-1\right), \text{ if } \text{var}< \mu(1-\mu)\\ | \alpha&= \mu \nu =\mu \left(\frac{\mu(1-\mu)}{\text{var}}-1\right), \text{ if } \text{var}< \mu(1-\mu)\\ | ||

\beta &= (1 - \mu) \nu = (1 - \mu)\left(\frac{\mu(1-\mu)}{\text{var}}-1\right), \text{ if }\text{var}< \mu(1-\mu). | \beta &= (1 - \mu) \nu = (1 - \mu)\left(\frac{\mu(1-\mu)}{\text{var}}-1\right), \text{ if }\text{var}< \mu(1-\mu). | ||

\end{align}</math> | \end{align} | ||

बीटा वितरण का यह सांख्यिकीय | |||

</math> | |||

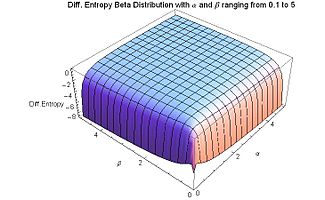

बीटा वितरण का यह सांख्यिकीय मापदंड मूल मापदंड α और β के आधार पर से अधिक सहज ज्ञान युक्त समझ उत्पन्न कर सकता है। उदाहरण के लिए, माध्य और विचरण के संदर्भ में मोड, विषमता, अतिरिक्त कुर्टोसिस और अंतर एन्ट्रापी को व्यक्त करके: | |||

[[File:Mode Beta Distribution for both alpha and beta greater than 1 - J. Rodal.jpg|325px]][[File:Mode Beta Distribution for both alpha and beta greater than 1 - another view - J. Rodal.jpg|325px]] | [[File:Mode Beta Distribution for both alpha and beta greater than 1 - J. Rodal.jpg|325px]][[File:Mode Beta Distribution for both alpha and beta greater than 1 - another view - J. Rodal.jpg|325px]] | ||

| Line 120: | Line 120: | ||

[[File:Differential Entropy Beta Distribution with mean from 0.2 to 0.8 and variance from 0.01 to 0.09 - J. Rodal.jpg|325px]][[File:Differential Entropy Beta Distribution with mean from 0.3 to 0.7 and variance from 0 to 0.2 - J. Rodal.jpg|325px]] | [[File:Differential Entropy Beta Distribution with mean from 0.2 to 0.8 and variance from 0.01 to 0.09 - J. Rodal.jpg|325px]][[File:Differential Entropy Beta Distribution with mean from 0.3 to 0.7 and variance from 0 to 0.2 - J. Rodal.jpg|325px]] | ||

====चार | ====चार मापदंड्स ==== | ||

दो आकार | दो आकार मापदंड α और β के साथ बीटा वितरण श्रेणी [0,1] या (0,1) पर समर्थित है। न्यूनतम, a, और अधिकतम c(c> a), वितरण के मूल्यों का प्रतिनिधित्व करने वाले दो और मापदंड प्रस्तुत करके वितरण के स्थान और पैमाने को बदलना संभव है,<ref name=JKB/> गैर-आयामी वेरिएबल को प्रतिस्थापित करने वाले रैखिक परिवर्तन द्वारा x नए वेरिएबल y के संदर्भ में (समर्थन [a, c] या (a, c) के साथ) और मापदंड a और c होंगे : | ||

:<math>y = x(c-a) + a, \text{ therefore }x = \frac{y-a}{c-a}.</math> | :<math>y = x(c-a) + a, \text{ therefore }x = \frac{y-a}{c-a}.</math> | ||

चार | चार मापदंड बीटा वितरण का प्रायिकता घनत्व फलन दो मापदंड वितरण के सामान्तर है, जिसे रेंज (c-a) द्वारा स्केल किया गया है, (जिससेघनत्व वक्र के अंतर्गत कुल क्षेत्रफल की संभावना के सामान्तर हो), और y वेरिएबल के साथ शिफ्ट हो गया और निम्नानुसार स्केल किया गया: | ||

::<math>f(y; \alpha, \beta, a, c) = \frac{f(x;\alpha,\beta)}{c-a} =\frac{\left(\frac{y-a}{c-a}\right)^{\alpha-1} \left (\frac{c-y}{c-a} \right)^{\beta-1} }{(c-a)B(\alpha, \beta)}=\frac{ (y-a)^{\alpha-1} (c-y)^{\beta-1} }{(c-a)^{\alpha+\beta-1}B(\alpha, \beta)}.</math> | ::<math>f(y; \alpha, \beta, a, c) = \frac{f(x;\alpha,\beta)}{c-a} =\frac{\left(\frac{y-a}{c-a}\right)^{\alpha-1} \left (\frac{c-y}{c-a} \right)^{\beta-1} }{(c-a)B(\alpha, \beta)}=\frac{ (y-a)^{\alpha-1} (c-y)^{\beta-1} }{(c-a)^{\alpha+\beta-1}B(\alpha, \beta)}. | ||

यह कि यादृच्छिक | |||

</math> | |||

यह कि यादृच्छिक वेरिएबल Y को चार मापदंड α, β, a, और c हैं बीटा-वितरित है जिसे निम्न द्वारा दर्शाया गया है | | |||

:<math>Y \sim \operatorname{Beta}(\alpha, \beta, a, c).</math> | :<math>Y \sim \operatorname{Beta}(\alpha, \beta, a, c).</math> | ||

| Line 139: | Line 141: | ||

नोट: ज्यामितीय माध्य और हार्मोनिक माध्य को रेखीय परिवर्तन द्वारा रूपांतरित नहीं किया जा सकता है, जिस तरह से माध्य, माध्यिका और मोड कर सकते हैं। | नोट: ज्यामितीय माध्य और हार्मोनिक माध्य को रेखीय परिवर्तन द्वारा रूपांतरित नहीं किया जा सकता है, जिस तरह से माध्य, माध्यिका और मोड कर सकते हैं। | ||

Y के आकार के मापदंडों को इसके माध्य और विचरण के रूप में लिखा जा सकता है | Y के आकार के मापदंडों को इसके माध्य और विचरण के रूप में लिखा जा सकता है | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 151: | Line 153: | ||

::<math>(\text{(mean deviation around mean)}(X))(c-a) =\frac{2 \alpha^{\alpha} \beta^{\beta}}{\Beta(\alpha,\beta)(\alpha + \beta)^{\alpha + \beta + 1}}(c-a)</math> | ::<math>(\text{(mean deviation around mean)}(X))(c-a) =\frac{2 \alpha^{\alpha} \beta^{\beta}}{\Beta(\alpha,\beta)(\alpha + \beta)^{\alpha + \beta + 1}}(c-a)</math> | ||

::<math> \text{var}(Y) =\text{var}(X)(c-a)^2 =\frac{\alpha\beta (c-a)^2}{(\alpha+\beta)^2(\alpha+\beta+1)}.</math> | ::<math> \text{var}(Y) =\text{var}(X)(c-a)^2 =\frac{\alpha\beta (c-a)^2}{(\alpha+\beta)^2(\alpha+\beta+1)}.</math> | ||

चूँकि [[तिरछापन]] और [[अतिरिक्त कर्टोसिस]] गैर-आयामी मात्राएँ हैं (जैसा कि क्षण (गणित) माध्य पर केंद्रित है और [[मानक विचलन]] द्वारा सामान्यीकृत है), वे | चूँकि [[तिरछापन|विषमता]] और [[अतिरिक्त कर्टोसिस]] गैर-आयामी मात्राएँ हैं (जैसा कि क्षण (गणित) माध्य पर केंद्रित है और [[मानक विचलन]] द्वारा सामान्यीकृत है), वे मापदंड a और c से स्वतंत्र हैं, और इसलिए ऊपर दिए गए भावों के सामान्तर हैं x (समर्थन के साथ [0,1] या (0,1)): | ||

::<math> \text{skewness}(Y) =\text{skewness}(X) = \frac{2 (\beta - \alpha) \sqrt{\alpha + \beta + 1} }{(\alpha + \beta + 2) \sqrt{\alpha \beta}}.</math> | ::<math> \text{skewness}(Y) =\text{skewness}(X) = \frac{2 (\beta - \alpha) \sqrt{\alpha + \beta + 1} }{(\alpha + \beta + 2) \sqrt{\alpha \beta}}.</math> | ||

::<math> \text{kurtosis excess}(Y) =\text{kurtosis excess}(X)=\frac{6[(\alpha - \beta)^2 (\alpha +\beta + 1) - \alpha \beta (\alpha + \beta + 2)]} | ::<math> \text{kurtosis excess}(Y) =\text{kurtosis excess}(X)=\frac{6[(\alpha - \beta)^2 (\alpha +\beta + 1) - \alpha \beta (\alpha + \beta + 2)]} | ||

{\alpha \beta (\alpha + \beta + 2) (\alpha + \beta + 3)} </math> | {\alpha \beta (\alpha + \beta + 2) (\alpha + \beta + 3)} </math> | ||

== गुण == | == गुण == | ||

| Line 165: | Line 165: | ||

α, β> 1 के साथ बीटा वितरित रैंडम वेरिएबल X का [[मोड (सांख्यिकी)]] वितरण का सबसे संभावित मान है (PDF में शिखर के अनुरूप), और निम्नलिखित अभिव्यक्ति द्वारा दिया गया है:<ref name=JKB>{{cite book|last1=Johnson|first1= Norman L. |first2= Samuel|last2= Kotz |first3= N. |last3= Balakrishnan| year=1995 |title=Continuous Univariate Distributions Vol. 2 |edition=2nd |publisher= Wiley |isbn= 978-0-471-58494-0 |chapter= Chapter 25:Beta Distributions}}</ref> | α, β> 1 के साथ बीटा वितरित रैंडम वेरिएबल X का [[मोड (सांख्यिकी)]] वितरण का सबसे संभावित मान है (PDF में शिखर के अनुरूप), और निम्नलिखित अभिव्यक्ति द्वारा दिया गया है:<ref name=JKB>{{cite book|last1=Johnson|first1= Norman L. |first2= Samuel|last2= Kotz |first3= N. |last3= Balakrishnan| year=1995 |title=Continuous Univariate Distributions Vol. 2 |edition=2nd |publisher= Wiley |isbn= 978-0-471-58494-0 |chapter= Chapter 25:Beta Distributions}}</ref> | ||

:<math>\frac{\alpha - 1} {\alpha + \beta - 2} .</math> | :<math>\frac{\alpha - 1} {\alpha + \beta - 2} .</math> | ||

जब दोनों | जब दोनों मापदंड (α, β <1) से कम होते हैं, तब यह एंटी-मोड होता है: प्रायिकता घनत्व वक्र का निम्नतम बिंदु।<ref name=Wadsworth>{{cite book|last=Wadsworth |first=George P. and Joseph Bryan |title=संभाव्यता और यादृच्छिक चर का परिचय|url=https://archive.org/details/introductiontopr0000wads |url-access=registration |year=1960|publisher=McGraw-Hill}}</ref> | ||

Α = β देने पर, मोड के लिए अभिव्यक्ति 1/2 तक सरल हो जाती है, यह दिखाते हुए कि α = β> 1 के लिए मोड (प्रतिक्रिया विरोधी मोड जब {{nowrap|''α'', ''β'' < 1}}), वितरण के केंद्र में है: यह उन | |||

[[File:Mode Beta Distribution for alpha and beta from 1 to 5 - J. Rodal.jpg|325px|thumb|1 ≤ α ≤ 5 और 1 ≤ β ≤ 5 के लिए बीटा वितरण के लिए मोड]] | Α = β देने पर, मोड के लिए अभिव्यक्ति 1/2 तक सरल हो जाती है, यह दिखाते हुए कि α = β> 1 के लिए मोड (प्रतिक्रिया विरोधी मोड जब {{nowrap|''α'', ''β'' < 1}}), वितरण के केंद्र में है: यह उन स्थितियों में सममित है। α और β के इच्छानुसार मानों के लिए मोड स्थितियों की पूरी सूची के लिए इस आलेख में बीटा वितरण या आकार अनुभाग देखें, । इनमें से अनेक स्थितियों के लिए, घनत्व फलन का अधिकतम मान या दोनों सिरों पर होता है। कुछ स्थितियों में अंत में होने वाले घनत्व फलन का (अधिकतम) मान परिमित होता है। उदाहरण के लिए, α = 2, β = 1 (या α = 1, β = 2) के स्तिथियों में, घनत्व फलन त्रिकोणीय बंटन बन जाता है। समकोण-त्रिकोण वितरण जो दोनों सिरों पर परिमित है। अनेक अन्य स्थितियों में छोर पर [[गणितीय विलक्षणता]] होती है, जहां घनत्व फलन का मान अनंत तक पहुंचता है। उदाहरण के लिए, स्तिथियों में α = β = 1/2, बीटा वितरण आर्सेन वितरण बनने के लिए सरल हो जाता है। इनमें से कुछ स्थितियों को लेकर गणितज्ञों के मध्य बहस है और क्या छोरों (x = 0, और x = 1) को बहुलक कहा जा सकता है या नहीं।<ref name="Handbook of Beta Distribution" /><ref name="Mathematical Statistics with MATHEMATICA">{{cite book |last1=Rose |first1=Colin |last2=Smith |first2=Murray D. |title=गणित के साथ गणितीय सांख्यिकी|year=2002 |publisher=Springer |isbn=978-0387952345}}</ref> | ||

[[File:Mode Beta Distribution for alpha and beta from 1 to 5 - J. Rodal.jpg|325px|thumb|1 ≤ α ≤ 5 और 1 ≤ β ≤ 5 के लिए बीटा वितरण के लिए मोड]]क्या सिरे घनत्व फलन के फलन के डोमेन का भाग हैं | |||

* क्या गणितीय विलक्षणता को कभी भी विधा कहा जा सकता है | * क्या गणितीय विलक्षणता को कभी भी विधा कहा जा सकता है | ||

* क्या दो मैक्सिमा वाले | * क्या दो मैक्सिमा वाले स्थितियों को बिमॉडल कहा जाना चाहिए | ||

==== मध्य ==== | ==== मध्य ==== | ||

[[File:Median Beta Distribution for alpha and beta from 0 to 5 - J. Rodal.jpg|325px|thumb|0 ≤ α ≤ 5 और 0 ≤ β ≤ 5 के लिए बीटा वितरण के लिए माध्यिका]] | [[File:Median Beta Distribution for alpha and beta from 0 to 5 - J. Rodal.jpg|325px|thumb|0 ≤ α ≤ 5 और 0 ≤ β ≤ 5 के लिए बीटा वितरण के लिए माध्यिका]] | ||

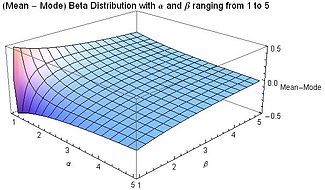

[[File:(Mean - Median) for Beta distribution versus alpha and beta from 0 to 2 - J. Rodal.jpg|thumb|(मीन-माध्यिका) बीटा वितरण बनाम 0 से 2 तक अल्फा और बीटा के लिए]]बीटा वितरण का माध्य अद्वितीय वास्तविक संख्या | [[File:(Mean - Median) for Beta distribution versus alpha and beta from 0 to 2 - J. Rodal.jpg|thumb|(मीन-माध्यिका) बीटा वितरण बनाम 0 से 2 तक अल्फा और बीटा के लिए]]इसमें बीटा वितरण का माध्य अद्वितीय वास्तविक संख्या <math>x = I_{\frac{1}{2}}^{[-1]}(\alpha,\beta)</math> है जिसके लिए नियमित अधूरा बीटा फलन <math>I_x(\alpha,\beta) = \tfrac{1}{2} </math>. α और β के इच्छानुसार मूल्यों के लिए बीटा वितरण के माध्यिका के लिए कोई सामान्य विवृत -रूप अभिव्यक्ति नहीं है। मापदंडों α और β के विशेष मूल्यों के लिए विवृत -रूप अभिव्यक्ति का पालन करें: | ||

* सममित | * सममित स्थितियों के लिए α = β, माध्यिका = 1/2। | ||

* α = 1 और β > 0 के लिए माध्यिका <math> =1-2^{-\frac{1}{\beta}}</math> (यह केस [[ दर्पण छवि ]] है | पावर | * α = 1 और β > 0 के लिए माध्यिका <math> =1-2^{-\frac{1}{\beta}}</math> (यह केस [[ दर्पण छवि ]] है | पावर फलन [0,1] डिस्ट्रीब्यूशन की मिरर-इमेज) | ||

* α > 0 और β = 1 के लिए माध्यिका = <math>2^{-\frac{1}{\alpha}}</math> (यह | * α > 0 और β = 1 के लिए माध्यिका = <math>2^{-\frac{1}{\alpha}}</math> (यह स्तिथि पावर फलन [0,1] वितरण है<ref name="Handbook of Beta Distribution" /> | ||

* α = 3 और β = 2 के लिए माध्यिका = 0.6142724318676105..., [[चतुर्थक समारोह]] 1 − 8x | * α = 3 और β = 2 के लिए माध्यिका = 0.6142724318676105..., [[चतुर्थक समारोह|चतुर्थक फलन]] 1 − 8x<sup>3</sup> + 6x<sup>4</sup> = 0 का वास्तविक समाधान , जो [0,1] में है। | ||

* α = 2 और β = 3 के लिए, माध्य = 0.38572756813238945... = 1−माध्यिका (बीटा (3, 2)) | * α = 2 और β = 3 के लिए, माध्य = 0.38572756813238945... = 1−माध्यिका (बीटा (3, 2)) | ||

एक | एक मापदंड परिमित (गैर-शून्य) के साथ निम्नलिखित सीमाएँ हैं और दूसरी इन सीमाओं तक पहुँच रही हैं: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 187: | Line 188: | ||

\lim_{\alpha\to 0} \text{median}= \lim_{\beta \to \infty} \text{median} = 0. | \lim_{\alpha\to 0} \text{median}= \lim_{\beta \to \infty} \text{median} = 0. | ||

\end{align}</math> | \end{align}</math> | ||

α और β दोनों के लिए से अधिक या | α और β दोनों के लिए से अधिक या सामान्तर, बीटा वितरण के माध्यिका के मूल्य का उचित सन्निकटन सूत्र द्वारा दिया गया है<ref name=Kerman2011/> | ||

:<math>\text{median} \approx \frac{\alpha - \tfrac{1}{3}}{\alpha + \beta - \tfrac{2}{3}} \text{ for } \alpha, \beta \ge 1.</math> | :<math>\text{median} \approx \frac{\alpha - \tfrac{1}{3}}{\alpha + \beta - \tfrac{2}{3}} \text{ for } \alpha, \beta \ge 1.</math> | ||

जब α, β ≥ 1, इस सन्निकटन में सापेक्ष त्रुटि (माध्यिका द्वारा विभाजित [[सन्निकटन त्रुटि]]) 4% से कम है और α ≥ 2 और β ≥ 2 दोनों के लिए यह 1% से कम है। माध्य और मोड के | जब α, β ≥ 1, इस सन्निकटन में सापेक्ष त्रुटि (माध्यिका द्वारा विभाजित [[सन्निकटन त्रुटि]]) 4% से कम है और α ≥ 2 और β ≥ 2 दोनों के लिए यह 1% से कम है। माध्य और मोड के मध्य के अंतर से विभाजित सन्निकटन त्रुटि समान रूप से छोटी है: | ||

[[File:Relative Error for Approximation to Median of Beta Distribution for alpha and beta from 1 to 5 - J. Rodal.jpg|325px|1 ≤ α ≤ 5 और 1 ≤ β ≤ 5 के लिए बीटा वितरण के लिए ABS [(माध्यिका-Appr.)/मध्यिका]]][[File:Error in Median Apprx. relative to Mean-Mode distance for Beta Distribution with alpha and beta from 1 to 5 - J. Rodal.jpg|325px|1≤α≤5 और 1≤β≤5 के लिए बीटा वितरण के लिए Abs[(माध्य-Appr.)/(मीन-मोड)]]] | [[File:Relative Error for Approximation to Median of Beta Distribution for alpha and beta from 1 to 5 - J. Rodal.jpg|325px|1 ≤ α ≤ 5 और 1 ≤ β ≤ 5 के लिए बीटा वितरण के लिए ABS [(माध्यिका-Appr.)/मध्यिका]]][[File:Error in Median Apprx. relative to Mean-Mode distance for Beta Distribution with alpha and beta from 1 to 5 - J. Rodal.jpg|325px|1≤α≤5 और 1≤β≤5 के लिए बीटा वितरण के लिए Abs[(माध्य-Appr.)/(मीन-मोड)]]] | ||

मीन === | मीन === | ||

[[File:Mean Beta Distribution for alpha and beta from 0 to 5 - J. Rodal.jpg|325px|thumb|बीटा वितरण के लिए | [[File:Mean Beta Distribution for alpha and beta from 0 to 5 - J. Rodal.jpg|325px|thumb|बीटा वितरण के लिए कारण{{nowrap|0 ≤ ''α'' ≤ 5}} और {{nowrap|0 ≤ ''β'' ≤ 5}}]]दो मापदंड α और β के साथ बीटा वितरण यादृच्छिक वेरिएबल X का अपेक्षित मान (माध्य) (μ) इन मापदंडों के केवल β/α का फलन है:<ref name=JKB /> | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 204: | Line 205: | ||

&= \frac{1}{1 + \frac{\beta}{\alpha}} | &= \frac{1}{1 + \frac{\beta}{\alpha}} | ||

\end{align}</math> | \end{align}</math> | ||

उपरोक्त अभिव्यक्ति में {{nowrap|1=''α'' = ''β''}} देने पर {{nowrap|1=''μ'' = 1/2}} प्राप्त करता है {{nowrap|1=''α'' = ''β''}} माध्य वितरण के केंद्र में है: यह सममित है। साथ ही, उपरोक्त अभिव्यक्ति से निम्नलिखित सीमाएँ प्राप्त की जा सकती हैं: | |||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 210: | Line 211: | ||

\lim_{\frac{\beta}{\alpha} \to \infty} \mu = 0 | \lim_{\frac{\beta}{\alpha} \to \infty} \mu = 0 | ||

\end{align}</math> | \end{align}</math> | ||

इसलिए, β/α → 0 | इसलिए, β/α → 0 , या α/β → ∞ के लिए, माध्य दाहिने छोर पर स्थित है, {{nowrap|1=''x'' = 1}}. इन सीमा अनुपातबं के लिए, बीटा वितरण [[डिराक डेल्टा समारोह|डिराक डेल्टा फलन]] के साथ एक-बिंदु पतित वितरण बन जाता है, दाहिने छोर पर स्पाइक, {{nowrap|1=''x'' = 1}}, प्रायिकता 1 के साथ, और हर स्थान पर शून्य प्रायिकता पाई जाती है । 100% संभावना (पूर्ण निश्चितता) {{nowrap|1=''x'' = 1}} सही छोर पर केंद्रित है| . | ||

:<math> \begin{align} | <nowiki>:</nowiki><math> \begin{align} | ||

\lim_{\beta \to 0} \mu = \lim_{\alpha \to \infty} \mu = 1\\ | \lim_{\beta \to 0} \mu = \lim_{\alpha \to \infty} \mu = 1\\ | ||

\lim_{\alpha\to 0} \mu = \lim_{\beta \to \infty} \mu = 0 | \lim_{\alpha\to 0} \mu = \lim_{\beta \to \infty} \mu = 0 | ||

\end{align}</math> | \end{align}</math> | ||

जबकि ठेठ एकरूप वितरण के लिए (केंद्रीय रूप से स्थित मोड के साथ, मोड के दोनों किनारों पर नतिकरण बिंदु, और लंबी टेल ) (बीटा (α, β) के साथ जैसे कि {{nowrap|''α'', ''β'' > 2}}) यह ज्ञात है कि प्रतिरूप माध्य (स्थान के अनुमान के रूप में) प्रतिरूप माध्यिका के रूप में [[मजबूत आँकड़े|शक्तिशाली आँकड़े]] नहीं है, इसके विपरीत वर्दी या यू-आकार के बिमोडल वितरण (बीटा (α, β) के साथ) के स्तिथियों में है {{nowrap|''α'', ''β'' ≤ 1}}), वितरण के अंत में स्थित मोड के साथ। मोस्टेलर और टुकी टिप्पणी के रूप में (<ref name=MostellerTukey>{{cite book|last=Mosteller|first=Frederick and John Tukey|title=Data Analysis and Regression: A Second Course in Statistics|url=https://archive.org/details/dataanalysisregr0000most|url-access=registration|year=1977|publisher=Addison-Wesley Pub. Co.|isbn=978-0201048544|bibcode=1977dars.book.....M}}</ref> पी। 207) दो वेरिएबल म अवलोकनों का औसत सभी प्रतिरूप जानकारी का उपयोग करता है। यह दर्शाता है कि कैसे लघु-टेल वितरण के लिए, वेरिएबल म प्रेक्षणों को अधिक भार मिलना चाहिए। इसके विपरीत, यह वितरण के किनारे पर मोड के साथ यू-आकार के बिमोडल वितरण का माध्यिका है (बीटा (α, β) के साथ जैसे कि {{nowrap|''α'', ''β'' ≤ 1}}) शक्तिशाली नहीं है, क्योंकि प्रतिरूप माध्यिका अत्यधिक प्रतिरूप टिप्पणियों को विचार से हटा देती है। इसका व्यावहारिक अनुप्रयोग उदाहरण के लिए [[यादृच्छिक चाल]] के लिए होता है, क्योंकि रैंडम वॉक में मूल स्थान पर अंतिम विज़िट के समय की संभावना आर्क्सिन वितरण बीटा (1/2, 1/2) के रूप में वितरित की जाती है:<ref name=Feller/><ref name=WillyFeller1/>एक यादृच्छिक चलने की अनेक प्राप्ति (संभावना) का कारणऔसत से अधिक शक्तिशाली अनुमानक है (जो इस स्तिथियों में अनुचित प्रतिरूप माप अनुमान है)। | |||

==== ज्यामितीय माध्य ==== | |||

[[File:(Mean - GeometricMean) for Beta Distribution versus alpha and beta from 0 to 2 - J. Rodal.jpg|thumb|(मीन - जियोमेट्रिक मीन) बीटा वितरण बनाम α और 0 से 2 के लिए, ज्यामितीय माध्य के लिए α और β के मध्य विषमता दिखा रहा है]]यादृच्छिक वेरिएबल X के साथ वितरण का ज्यामितीय माध्य G<sub>X</sub> का लघुगणक ln(X) का अंकगणितीय माध्य है, या, समतुल्य, इसका अपेक्षित मान है | |||

:<math>\ln G_X = \operatorname{E}[\ln X]</math> | :<math>\ln G_X = \operatorname{E}[\ln X]</math> | ||

बीटा वितरण के लिए, अपेक्षित मान अभिन्न देता है: | बीटा वितरण के लिए, अपेक्षित मान अभिन्न देता है: | ||

| Line 239: | Line 235: | ||

&= \frac{\partial \ln \Gamma(\alpha)}{\partial \alpha} - \frac{\partial \ln \Gamma(\alpha + \beta)}{\partial \alpha} \\[4pt] | &= \frac{\partial \ln \Gamma(\alpha)}{\partial \alpha} - \frac{\partial \ln \Gamma(\alpha + \beta)}{\partial \alpha} \\[4pt] | ||

&= \psi(\alpha) - \psi(\alpha + \beta) | &= \psi(\alpha) - \psi(\alpha + \beta) | ||

\end{align}</math> | \end{align} </math> | ||

जहां ψ [[डिगामा समारोह]] है। | जहां ψ [[डिगामा समारोह|डिगामा फलन]] है। | ||

इसलिए, आकार | इसलिए, इसका आकार मापदंड α और β के साथ बीटा वितरण का ज्यामितीय माध्य α और β के डिगामा कार्यों का घातांक निम्नानुसार है: | ||

:<math>G_X =e^{\operatorname{E}[\ln X]}= e^{\psi(\alpha) - \psi(\alpha + \beta)}</math> | :<math>G_X =e^{\operatorname{E}[\ln X]}= e^{\psi(\alpha) - \psi(\alpha + \beta)}</math> | ||

जबकि समान आकार के | जबकि समान आकार के मापदंड α = β के साथ बीटा वितरण के लिए, यह इस प्रकार है कि विषमता = 0 और मोड = माध्य = औसत = 1/2, ज्यामितीय माध्य 1/2 से कम है: {{nowrap|0 < ''G''<sub>''X''</sub> < 1/2}}. इसका कारण यह है कि लॉगरिदमिक परिवर्तन X के मूल्यों को शून्य के समीप दृढ़ता से भारित करता है, क्योंकि ln(X) दृढ़ता से ऋणात्मक अनन्तता की ओर जाता है क्योंकि X शून्य तक पहुंचता है, जबकि ln(X) {{nowrap|''X'' → 1}} शून्य की ओर चपटा होता है . | ||

एक पंक्ति के साथ {{nowrap|1=''α'' = ''β''}}, निम्नलिखित सीमाएँ | एक पंक्ति के साथ {{nowrap|1=''α'' = ''β''}}, निम्नलिखित सीमाएँ प्रयुक्त होती हैं: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 253: | Line 249: | ||

&\lim_{\alpha = \beta \to \infty} G_X =\tfrac{1}{2} | &\lim_{\alpha = \beta \to \infty} G_X =\tfrac{1}{2} | ||

\end{align}</math> | \end{align}</math> | ||

निम्नलिखित | निम्नलिखित मापदंड परिमित (गैर-शून्य) के साथ सीमाएँ हैं और अन्य इन सीमाओं के समीप हैं: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 259: | Line 255: | ||

\lim_{\alpha\to 0} G_X = \lim_{\beta \to \infty} G_X = 0 | \lim_{\alpha\to 0} G_X = \lim_{\beta \to \infty} G_X = 0 | ||

\end{align}</math> | \end{align}</math> | ||

संलग्न आलेख शून्य से 2 तक आकृति | संलग्न आलेख शून्य से 2 तक आकृति मापदंड α और β उपयोग किये जाते है जिनके लिए माध्य और ज्यामितीय माध्य के मध्य अंतर दिखाता है। इस तथ्य के अतिरिक्त कि उनके मध्य का अंतर शून्य तक पहुंच जाता है क्योंकि α और β अनंत तक पहुंचते हैं और यह अंतर α के मानों के लिए बड़ा हो जाता है और β शून्य के समीप पहुंचने वाला होता है, आकार मापदंड α और β के संबंध में ज्यामितीय माध्य की स्पष्ट विषमता देखी जा सकती है। जब कि β और α के परिमाणों का आदान-प्रदान करने की तुलना में β के संबंध में α के छोटे मानों के लिए ज्यामितीय माध्य और माध्य के मध्य का अंतर बड़ा है। | ||

नॉर्मन लॉयड जॉनसन|एन. एल.जॉनसन और सैमुअल कोटज़ | नॉर्मन लॉयड जॉनसन|(एन. एल.जॉनसन) और सैमुअल कोटज़(एस. कोटज़)<ref name=JKB /> डिगामा फलन ψ(α) ≈ ln(α − 1/2) के लिए लघुगणक सन्निकटन का सुझाव देते है , जिसके परिणामस्वरूप ज्यामितीय माध्य के लिए निम्नलिखित सन्निकटन होता है: | ||

:<math>G_X \approx \frac{\alpha \, - \frac{1}{2}}{\alpha +\beta - \frac{1}{2}}\text{ if } \alpha, \beta > 1.</math> | :<math>G_X \approx \frac{\alpha \, - \frac{1}{2}}{\alpha +\beta - \frac{1}{2}}\text{ if } \alpha, \beta > 1. </math> | ||

इस सन्निकटन में सापेक्ष त्रुटि के लिए संख्यात्मक मान अनुसरण करते हैं: [{{nowrap|1=(''α'' = ''β'' = 1): 9.39%}}]; [{{nowrap|1=(''α'' = ''β'' = 2): 1.29%}}]; [{{nowrap|1=(''α'' = 2, ''β'' = 3): 1.51%}}]; [{{nowrap|1=(''α'' = 3, ''β'' = 2): 0.44%}}]; [{{nowrap|1=(''α'' = ''β'' = 3): 0.51%}}]; [{{nowrap|1=(''α'' = ''β'' = 4): 0.26%}}]; [{{nowrap|1=(''α'' = 3, ''β'' = 4): 0.55%}}]; [{{nowrap|1=(''α'' = 4, ''β'' = 3): 0.24%}}]। | इस सन्निकटन में सापेक्ष त्रुटि के लिए संख्यात्मक मान अनुसरण करते हैं: [{{nowrap|1=(''α'' = ''β'' = 1): 9.39%}}]; [{{nowrap|1=(''α'' = ''β'' = 2): 1.29%}}]; [{{nowrap|1=(''α'' = 2, ''β'' = 3): 1.51%}}]; [{{nowrap|1=(''α'' = 3, ''β'' = 2): 0.44%}}]; [{{nowrap|1=(''α'' = ''β'' = 3): 0.51%}}]; [{{nowrap|1=(''α'' = ''β'' = 4): 0.26%}}]; [{{nowrap|1=(''α'' = 3, ''β'' = 4): 0.55%}}]; [{{nowrap|1=(''α'' = 4, ''β'' = 3): 0.24%}}]। | ||

इसी तरह, ज्यामितीय माध्य के | इसी तरह, ज्यामितीय माध्य के सामान्तर 1/2 के लिए आवश्यक आकार मापदंडों के मान की गणना कर सकते हैं। मापदंड β के मान को देखते हुए, 1/2 के सामान्तर ज्यामितीय माध्य के लिए आवश्यक अन्य मापदंड α का मान क्या होगा?. उत्तर यह है कि (β > 1 के लिए), आवश्यक α का मान β → ∞ के रूप में β + 1/2 की ओर बढ़ता है। उदाहरण के लिए, इन सभी जोड़ों का 1/2 का समान ज्यामितीय माध्य है: [{{nowrap|1=''β'' = 1, ''α'' = 1.4427}}], [{{nowrap|1=''β'' = 2, ''α'' = 2.46958}}], [{{nowrap|1=''β'' = 3, ''α'' = 3.47943}}], [{{nowrap|1=''β'' = 4, ''α'' = 4.48449}}], [{{nowrap|1=''β'' = 5, ''α'' = 5.48756}}], [{{nowrap|1=''β'' = 10, ''α'' = 10.4938}}], [{{nowrap|1=''β'' = 100, ''α'' = 100.499}}]। | ||

ज्यामितीय माध्य का मौलिक गुण | ज्यामितीय माध्य का मौलिक गुण है जो किसी अन्य माध्य के लिए असत्य सिद्ध हो सकता है, | ||

:<math>G\left(\frac{X_i}{Y_i}\right) = \frac{G(X_i)}{G(Y_i)}</math> | :<math>G\left(\frac{X_i}{Y_i}\right) = \frac{G(X_i)}{G(Y_i)}</math> | ||

यह ज्यामितीय माध्य को एकमात्र सही माध्य बनाता है जब सामान्यीकृत परिणामों का औसत निकाला जाता है, अर्थात वे परिणाम जो संदर्भ मूल्यों के अनुपात के रूप में प्रस्तुत किए जाते हैं।<ref>Philip J. Fleming and John J. Wallace. ''How not to lie with statistics: the correct way to summarize benchmark results''. Communications of the ACM, 29(3):218–221, March 1986.</ref> यह प्रासंगिक है क्योंकि बीटा वितरण प्रतिशत के यादृच्छिक व्यवहार के लिए उपयुक्त मॉडल है और यह अनुपात के सांख्यिकीय मॉडलिंग के लिए विशेष रूप से उपयुक्त है। ज्यामितीय माध्य अधिकतम संभावना अनुमान में केंद्रीय भूमिका निभाता है, खंड | यह ज्यामितीय माध्य को एकमात्र सही माध्य बनाता है जब सामान्यीकृत परिणामों का औसत निकाला जाता है, अर्थात वे परिणाम जो संदर्भ मूल्यों के अनुपात के रूप में प्रस्तुत किए जाते हैं।<ref>Philip J. Fleming and John J. Wallace. ''How not to lie with statistics: the correct way to summarize benchmark results''. Communications of the ACM, 29(3):218–221, March 1986.</ref> यह प्रासंगिक है क्योंकि बीटा वितरण प्रतिशत के यादृच्छिक व्यवहार के लिए उपयुक्त मॉडल है और यह अनुपात के सांख्यिकीय मॉडलिंग के लिए विशेष रूप से उपयुक्त है। ज्यामितीय माध्य अधिकतम संभावना अनुमान में केंद्रीय भूमिका निभाता है,जिससे कि खंड मापदंड के अनुमान, तथा अधिकतम संभावना देखें जा सके। दरअसल, अधिकतम संभावना का अनुमान लगाते समय, यादृच्छिक वेरिएबल X के आधार पर ज्यामितीय माध्य G<sub>X</sub> के अतिरिक्त , और ज्यामितीय माध्य भी स्वाभाविक रूप से प्रकट होता है: रैखिक परिवर्तन के आधार पर ज्यामितीय माध्य--{{nowrap|(1 − ''X'')}}, X की दर्पण छवि, जिसे G<sub>(1−''X'')</sub> द्वारा निरूपित किया जाता है: | ||

: | |||

:<math>G_{(1-X)} = e^{\operatorname{E}[\ln(1-X)] } = e^{\psi(\beta) - \psi(\alpha + \beta)}</math> | :<math>G_{(1-X)} = e^{\operatorname{E}[\ln(1-X)] } = e^{\psi(\beta) - \psi(\alpha + \beta)}</math> | ||

एक पंक्ति के साथ {{nowrap|1=''α'' = ''β''}}, निम्नलिखित सीमाएँ | एक पंक्ति के साथ {{nowrap|1=''α'' = ''β''}}, निम्नलिखित सीमाएँ प्रयुक्त होती हैं: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 280: | Line 277: | ||

&\lim_{\alpha = \beta \to \infty} G_{(1-X)} =\tfrac{1}{2} | &\lim_{\alpha = \beta \to \infty} G_{(1-X)} =\tfrac{1}{2} | ||

\end{align}</math> | \end{align}</math> | ||

निम्नलिखित | निम्नलिखित मापदंड परिमित (गैर-शून्य) के साथ सीमाएँ हैं और अन्य इन सीमाओं के समीप हैं: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 288: | Line 285: | ||

इसका निम्नलिखित अनुमानित मूल्य है: | इसका निम्नलिखित अनुमानित मूल्य है: | ||

:<math>G_{(1-X)} \approx \frac{\beta - \frac{1}{2}}{\alpha+\beta-\frac{1}{2}}\text{ if } \alpha, \beta > 1.</math> | :<math>G_{(1-X)} \approx \frac{\beta - \frac{1}{2}}{\alpha+\beta-\frac{1}{2}}\text{ if } \alpha, \beta > 1. </math> | ||

चूंकि दोनों G<sub>''X''</sub> और G<sub>(1−''X'')</sub> असममित हैं, इस स्तिथियों में इनकी दोनों की आकार मापदंड समान {{nowrap|1=''α'' = ''β''}} हैं , ज्यामितीय साधन सामान्तर हैं: G<sub>''X''</sub> = G<sub>(1−''X'')</sub>. यह समानता दोनों ज्यामितीय साधनों के मध्य प्रदर्शित निम्नलिखित समरूपता से होती है: | |||

<nowiki>:</nowiki> | |||

:<math>G_X (\Beta(\alpha, \beta) )=G_{(1-X)}(\Beta(\beta, \alpha) ). </math> | :<math>G_X (\Beta(\alpha, \beta) )=G_{(1-X)}(\Beta(\beta, \alpha) ). </math> | ||

==== हार्मोनिक | ==== हार्मोनिक कारण ==== | ||

[[File:Harmonic mean for Beta distribution for alpha and beta ranging from 0 to 5 - J. Rodal.jpg|thumb|0 < α < 5 और 0 < β < 5 के लिए बीटा वितरण के लिए सुरीले माध्य]] | [[File:Harmonic mean for Beta distribution for alpha and beta ranging from 0 to 5 - J. Rodal.jpg|thumb|0 < α < 5 और 0 < β < 5 के लिए बीटा वितरण के लिए सुरीले माध्य]] | ||

[[File:(Mean - HarmonicMean) for Beta distribution versus alpha and beta from 0 to 2 - J. Rodal.jpg|thumb|0 से 2 तक बीटा वितरण बनाम α और β के लिए हार्मोनिक माध्य]] | [[File:(Mean - HarmonicMean) for Beta distribution versus alpha and beta from 0 to 2 - J. Rodal.jpg|thumb|0 से 2 तक बीटा वितरण बनाम α और β के लिए हार्मोनिक माध्य]]यादृच्छिक वेरिएबल X के साथ वितरण का हार्मोनिक माध्य H<sub>X</sub> का व्युत्क्रम 1/X का अंकगणितीय माध्य है या, समतुल्य, इसका अपेक्षित मान है। इसलिए, आकार मापदंड α और β के साथ बीटा वितरण का है: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

H_X &= \frac{1}{\operatorname{E}\left[\frac{1}{X}\right]} \\ | H_X &= \frac{1}{\operatorname{E}\left[\frac{1}{X}\right]} \\ | ||

| Line 306: | Line 301: | ||

&=\frac{1}{\int_0^1 \frac{x^{\alpha-1}(1-x)^{\beta-1}}{x \Beta(\alpha,\beta)}\,dx} \\ | &=\frac{1}{\int_0^1 \frac{x^{\alpha-1}(1-x)^{\beta-1}}{x \Beta(\alpha,\beta)}\,dx} \\ | ||

&= \frac{\alpha - 1}{\alpha + \beta - 1}\text{ if } \alpha > 1 \text{ and } \beta > 0 \\ | &= \frac{\alpha - 1}{\alpha + \beta - 1}\text{ if } \alpha > 1 \text{ and } \beta > 0 \\ | ||

\end{align}</math> | \end{align} </math> | ||

हार्मोनिक माध्य ( | α <1 के साथ बीटा वितरण का हार्मोनिक माध्य (H<sub>X</sub>) अपरिभाषित है, क्योंकि इसकी परिभाषित अभिव्यक्ति एकता से कम आकार मापदंड α के लिए [0, 1] में सीमित नहीं है। | ||

उपरोक्त व्यंजक में α = β देने से प्राप्त होता है | उपरोक्त व्यंजक में α = β देने से प्राप्त होता है | ||

| Line 314: | Line 310: | ||

दिखा रहा है कि α = β के लिए हार्मोनिक माध्य 0 से है, α = β = 1 के लिए, 1/2 के लिए, α = β → ∞ के लिए। | दिखा रहा है कि α = β के लिए हार्मोनिक माध्य 0 से है, α = β = 1 के लिए, 1/2 के लिए, α = β → ∞ के लिए। | ||

निम्नलिखित | निम्नलिखित मापदंड परिमित (गैर-शून्य) के साथ सीमाएँ हैं और अन्य इन सीमाओं के समीप हैं: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 320: | Line 316: | ||

&\lim_{\alpha\to 1} H_X = \lim_{\beta \to \infty} H_X = 0 \\ | &\lim_{\alpha\to 1} H_X = \lim_{\beta \to \infty} H_X = 0 \\ | ||

&\lim_{\beta \to 0} H_X = \lim_{\alpha \to \infty} H_X = 1 | &\lim_{\beta \to 0} H_X = \lim_{\alpha \to \infty} H_X = 1 | ||

\end{align}</math> | \end{align} </math> | ||

ज्यामितीय माध्य के अतिरिक्त, हार्मोनिक माध्य चार | ज्यामितीय माध्य के अतिरिक्त, हार्मोनिक माध्य चार मापदंड स्तिथियों के लिए अधिकतम संभावना अनुमान में भूमिका निभाता है। दरअसल, हार्मोनिक माध्य H<sub>X</sub> के अतिरिक्त, चार मापदंड स्तिथियों के लिए अधिकतम संभावना अनुमान लगाते समययादृच्छिक वेरिएबल X के आधार पर, अन्य हार्मोनिक माध्य भी स्वाभाविक रूप से प्रकट होता है: रैखिक परिवर्तन (1 − X) पर आधारित हार्मोनिक माध्य, X की दर्पण-छवि, H द्वारा निरूपित<sub>1 − ''X''</sub>: | ||

:<math>H_{1-X} = \frac{1}{\operatorname{E} \left[\frac 1 {1-X}\right]} = \frac{\beta - 1}{\alpha + \beta-1} \text{ if } \beta > 1, \text{ and } \alpha> 0. </math> | :<math>H_{1-X} = \frac{1}{\operatorname{E} \left[\frac 1 {1-X}\right]} = \frac{\beta - 1}{\alpha + \beta-1} \text{ if } \beta > 1, \text{ and } \alpha> 0. | ||

हार्मोनिक माध्य (एच<sub>(1 − ''X'')</sub>β <1 के साथ बीटा वितरण अपरिभाषित है, क्योंकि इसकी परिभाषित अभिव्यक्ति [0, 1] में एकता से कम आकार | </math> | ||

हार्मोनिक माध्य (एच<sub>(1 − ''X'')</sub>β <1 के साथ बीटा वितरण अपरिभाषित है, क्योंकि इसकी परिभाषित अभिव्यक्ति [0, 1] में एकता से कम आकार मापदंड β के लिए बाध्य नहीं है। | |||

उपरोक्त व्यंजक में α = β देने से प्राप्त होता है | उपरोक्त व्यंजक में α = β देने से प्राप्त होता है | ||

| Line 331: | Line 328: | ||

दिखा रहा है कि α = β के लिए हार्मोनिक माध्य 0 से है, α = β = 1 के लिए, 1/2 के लिए, α = β → ∞ के लिए। | दिखा रहा है कि α = β के लिए हार्मोनिक माध्य 0 से है, α = β = 1 के लिए, 1/2 के लिए, α = β → ∞ के लिए। | ||

निम्नलिखित | निम्नलिखित मापदंड परिमित (गैर-शून्य) के साथ सीमाएँ हैं और अन्य इन सीमाओं के समीप हैं: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 338: | Line 335: | ||

&\lim_{\alpha\to 0} H_{1-X} = \lim_{\beta\to \infty} H_{1-X} = 1 | &\lim_{\alpha\to 0} H_{1-X} = \lim_{\beta\to \infty} H_{1-X} = 1 | ||

\end{align}</math> | \end{align}</math> | ||

चूंकि दोनों H<sub>''X''</sub> और H<sub>1−''X''</sub> असममित हैं, इस स्तिथियों में α = β कि दोनों आकार मापदंड सामान्तर हैं, H<sub>''X''</sub> = H<sub>1−''X''</sub>. हार्मोनिक साधन सामान्तर हैं: यह समानता दोनों हार्मोनिक साधनों के मध्य प्रदर्शित निम्नलिखित समरूपता से होती है: | |||

:<math>H_X (\Beta(\alpha, \beta) )=H_{1-X}(\Beta(\beta, \alpha) ) \text{ if } \alpha, \beta> 1.</math> | :<math>H_X (\Beta(\alpha, \beta) )=H_{1-X}(\Beta(\beta, \alpha) ) \text{ if } \alpha, \beta> 1.</math> | ||

| Line 346: | Line 343: | ||

==== विचरण ==== | ==== विचरण ==== | ||

मापदंड α और β के साथ बीटा वितरण यादृच्छिक वेरिएबल X का विचरण (माध्य पर केंद्रित दूसरा क्षण) है:<ref name=JKB /><ref>{{cite web | url = http://www.itl.nist.gov/div898/handbook/eda/section3/eda366h.htm | title = NIST/SEMATECH e-Handbook of Statistical Methods 1.3.6.6.17. Beta Distribution | website = [[National Institute of Standards and Technology]] Information Technology Laboratory | access-date = May 31, 2016 |date = April 2012 }}</ref> | |||

:<math>\operatorname{var}(X) = \operatorname{E}[(X - \mu)^2] = \frac{\alpha \beta}{(\alpha + \beta)^2(\alpha + \beta + 1)}</math> | :<math>\operatorname{var}(X) = \operatorname{E}[(X - \mu)^2] = \frac{\alpha \beta}{(\alpha + \beta)^2(\alpha + \beta + 1)}</math> | ||

उपरोक्त व्यंजक में α = β देने से प्राप्त होता है | उपरोक्त व्यंजक में α = β देने से प्राप्त होता है | ||

:<math>\operatorname{var}(X) = \frac{1}{4(2\beta + 1)},</math> | :<math>\operatorname{var}(X) = \frac{1}{4(2\beta + 1)},</math> | ||

दिखा रहा है कि α = β के लिए | दिखा रहा है कि α = β के लिए जैसे जैसे {{nowrap|1=''α'' = ''β''}} बढ़ती है। वैसे वैसे विचरण नीरस रूप से घटता है समुच्चयिंग {{nowrap|1=''α'' = ''β'' = 0}} इस व्यंजक में, अधिकतम प्रसरण var(X) = 1/4 मिलता है<ref name=JKB />जो केवल {{nowrap|1=''α'' = ''β'' = 0}}. पर सीमा के निकट होता है, | ||

माध्य μ | बीटा वितरण को इसके माध्य μ (0 < μ < 1) और प्रतिरूप आकार ν = α + β (ν > 0) के संदर्भ में भी पैरामीट्रिज्ड किया जा सकता है (उपखंड माध्य और प्रतिरूप आकार देखें): | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 359: | Line 356: | ||

\beta &= (1 - \mu) \nu, \text{ where }\nu =(\alpha + \beta) >0. | \beta &= (1 - \mu) \nu, \text{ where }\nu =(\alpha + \beta) >0. | ||

\end{align}</math> | \end{align}</math> | ||

इस सांख्यिकीय | इस सांख्यिकीय मापदंड का उपयोग करते हुए, माध्य μ और प्रतिरूप आकार ν के संदर्भ में विचरण को निम्नानुसार व्यक्त किया जा सकता है: | ||

:<math>\operatorname{var}(X) = \frac{\mu (1-\mu)}{1 + \nu}</math> | :<math>\operatorname{var}(X) = \frac{\mu (1-\mu)}{1 + \nu}</math> | ||

| Line 367: | Line 364: | ||

:<math>\operatorname{var}(X) = \frac{1}{4 (1 + \nu)} \text{ if } \mu = \tfrac{1}{2}</math> | :<math>\operatorname{var}(X) = \frac{1}{4 (1 + \nu)} \text{ if } \mu = \tfrac{1}{2}</math> | ||

साथ ही, उपरोक्त भावों से निम्नलिखित सीमाएँ प्राप्त की जा सकती हैं (केवल विख्यात | साथ ही, उपरोक्त भावों से निम्नलिखित सीमाएँ प्राप्त की जा सकती हैं (केवल विख्यात वेरिएबल सीमा तक पहुँच रहे हैं): | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 376: | Line 373: | ||

[[File:Variance for Beta Distribution for alpha and beta ranging from 0 to 5 - J. Rodal.jpg|325px]] | [[File:Variance for Beta Distribution for alpha and beta ranging from 0 to 5 - J. Rodal.jpg|325px]] | ||

==== ज्यामितीय विचरण और सहप्रसरण ==== | ==== ज्यामितीय विचरण और सहप्रसरण ==== | ||

[[File:Beta distribution log geometric variances front view - J. Rodal.png|thumb|लॉग ज्यामितीय प्रसरण बनाम α और β]] | [[File:Beta distribution log geometric variances front view - J. Rodal.png|thumb|लॉग ज्यामितीय प्रसरण बनाम α और β]] | ||

[[File:Beta distribution log geometric variances back view - J. Rodal.png|thumb|लॉग ज्यामितीय प्रसरण बनाम α और β]]ज्यामितीय विचरण का लघुगणक, ln(var<sub>''GX''</sub>), यादृच्छिक | [[File:Beta distribution log geometric variances back view - J. Rodal.png|thumb|लॉग ज्यामितीय प्रसरण बनाम α और β]]ज्यामितीय विचरण का लघुगणक, ln(var<sub>''GX''</sub>), यादृच्छिक वेरिएबल X के साथ वितरण का X के लघुगणक का दूसरा क्षण X के ज्यामितीय माध्य ln(G<sub>X</sub>) पर केंद्रित है, | ||

:<math>\begin{align} | :<math>\begin{align} | ||

| Line 386: | Line 383: | ||

&= \operatorname{var}[\ln X] | &= \operatorname{var}[\ln X] | ||

\end{align}</math> | \end{align}</math> | ||

और इसलिए, ज्यामितीय विचरण है: | और इसलिए, ज्यामितीय विचरण है: | ||

:<math>\operatorname{var}_{GX} = e^{\operatorname{var}[\ln X]}</math> | :<math>\operatorname{var}_{GX} = e^{\operatorname{var}[\ln X]}</math> | ||

फिशर सूचना | फिशर सूचना आव्युह में, और लॉग संभावना फलन की वक्रता, प्रतिबिंब सूत्र वेरिएबल 1 − X के ज्यामितीय भिन्नता का लघुगणक और X और 1 − X के मध्य ज्यामितीय सहप्रसरण का लघुगणक प्रकट होता है: | ||

:<math>\begin{align} | :<math>\begin{align} | ||

| Line 405: | Line 402: | ||

& \\ | & \\ | ||

\operatorname{cov}_{G{X,(1-X)}} &= e^{\operatorname{cov}[\ln X, \ln(1-X)]} | \operatorname{cov}_{G{X,(1-X)}} &= e^{\operatorname{cov}[\ln X, \ln(1-X)]} | ||

\end{align}</math> | \end{align} </math> | ||

बीटा वितरण के लिए, दो गामा वितरणों के अनुपात के रूप में बीटा वितरण के प्रतिनिधित्व का उपयोग करके और अभिन्न के माध्यम से अंतर करके उच्च क्रम लॉगरिदमिक क्षण प्राप्त किए जा सकते हैं। उन्हें उच्च क्रम के पॉली-गामा कार्यों के संदर्भ में व्यक्त किया जा सकता है। अनुभाग देखें {{section link|| | बीटा वितरण के लिए, दो गामा वितरणों के अनुपात के रूप में बीटा वितरण के प्रतिनिधित्व का उपयोग करके और अभिन्न के माध्यम से अंतर करके उच्च क्रम लॉगरिदमिक क्षण प्राप्त किए जा सकते हैं। उन्हें उच्च क्रम के पॉली-गामा कार्यों के संदर्भ में व्यक्त किया जा सकता है। अनुभाग देखें {{section link||लघुगणकीय रूप से परिवर्तित यादृच्छिक चर के क्षण}}. लघुगणकीय वेरिएबल का प्रसरण और ln X और ln(1−X) का [[सहप्रसरण]] हैं: | ||

: <math>\operatorname{var}[\ln X]= \psi_1(\alpha) - \psi_1(\alpha + \beta)</math> | : <math>\operatorname{var}[\ln X]= \psi_1(\alpha) - \psi_1(\alpha + \beta)</math> | ||

: <math>\operatorname{var}[\ln (1-X)] = \psi_1(\beta) - \psi_1(\alpha + \beta)</math> | : <math>\operatorname{var}[\ln (1-X)] = \psi_1(\beta) - \psi_1(\alpha + \beta)</math> | ||

: <math>\operatorname{cov}[\ln X, \ln(1-X)] = -\psi_1(\alpha+\beta)</math> | : <math>\operatorname{cov}[\ln X, \ln(1-X)] = -\psi_1(\alpha+\beta)</math> | ||

जहाँ त्रिगामा फलन, ψ | जहाँ त्रिगामा फलन, ψ<sub>1</sub>(α) निरूपित करता है, तथा बहुग्राम कार्यों का दूसरा फलन है और इसे डिगामा फलन के व्युत्पन्न के रूप में परिभाषित किया गया है: | ||

:<math>\psi_1(\alpha) = \frac{d^2\ln\Gamma(\alpha)}{d\alpha^2}= \frac{d \, \psi(\alpha)}{d\alpha}.</math> | :<math>\psi_1(\alpha) = \frac{d^2\ln\Gamma(\alpha)}{d\alpha^2}= \frac{d \, \psi(\alpha)}{d\alpha}.</math> | ||

| Line 419: | Line 416: | ||

:<math> \ln \operatorname{var}_{G(1-X)} =\operatorname{var}[\ln (1-X)] = \psi_1(\beta) - \psi_1(\alpha + \beta)</math> | :<math> \ln \operatorname{var}_{G(1-X)} =\operatorname{var}[\ln (1-X)] = \psi_1(\beta) - \psi_1(\alpha + \beta)</math> | ||

:<math> \ln \operatorname{cov}_{GX,1-X} =\operatorname{cov}[\ln X, \ln(1-X)] = -\psi_1(\alpha+\beta)</math> | :<math> \ln \operatorname{cov}_{GX,1-X} =\operatorname{cov}[\ln X, \ln(1-X)] = -\psi_1(\alpha+\beta)</math> | ||

साथ वाले प्लॉट लॉग ज्यामितीय प्रसरण दिखाते हैं और ज्यामितीय सहप्रसरण बनाम आकृति | इसके साथ वाले प्लॉट लॉग ज्यामितीय प्रसरण दिखाते हैं और ज्यामितीय सहप्रसरण बनाम आकृति मापदंड α और β लॉग करते हैं। भूखंड दिखाते हैं कि लॉग ज्यामितीय संस्करण और लॉग ज्यामितीय सहप्रसरण आकार मापदंडों α और β 2 से अधिक के लिए शून्य के समीप हैं, और यह कि आकार मापदंड मान α और β एकता से कम के लिए लॉग ज्यामितीय संस्करण तेजी से मूल्य में वृद्धि करते हैं। आकार के मापदंडों के सभी मूल्यों के लिए लॉग ज्यामितीय संस्करण धनात्मक हैं। आकार के मापदंडों के सभी मूल्यों के लिए लॉग ज्यामितीय सहप्रसरण ऋणात्मक है, और यह एकता से कम α और β के लिए बड़े ऋणात्मक मूल्यों तक पहुंचता है। | ||

निम्नलिखित | निम्नलिखित मापदंड परिमित (गैर-शून्य) के साथ सीमाएँ हैं और अन्य इन सीमाओं के समीप हैं: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 431: | Line 428: | ||

&\lim_{\beta\to 0} \ln \operatorname{cov}_{GX,(1-X)} = - \psi_1(\alpha) | &\lim_{\beta\to 0} \ln \operatorname{cov}_{GX,(1-X)} = - \psi_1(\alpha) | ||

\end{align}</math> | \end{align}</math> | ||

अलग-अलग दो | अलग-अलग दो मापदंड वाली सीमाएँ: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 438: | Line 435: | ||

&\lim_{\alpha\to 0} (\lim_{\beta \to 0} \ln \operatorname{cov}_{GX,(1-X)}) = \lim_{\beta\to 0} (\lim_{\alpha\to 0} \ln \operatorname{cov}_{GX,(1-X)}) = - \infty | &\lim_{\alpha\to 0} (\lim_{\beta \to 0} \ln \operatorname{cov}_{GX,(1-X)}) = \lim_{\beta\to 0} (\lim_{\alpha\to 0} \ln \operatorname{cov}_{GX,(1-X)}) = - \infty | ||

\end{align}</math> | \end{align}</math> | ||

चूंकि दोनों ln(varGX) और ln(varG(1 − X)) असममित हैं, जब आकार मापदंड सामान्तर होते हैं, तब α = β, में होता है: ln(var<sub>''GX''</sub>) = ln(varG(1 − X). यह समानता दोनों लॉग ज्यामितीय भिन्नताओं के मध्य प्रदर्शित निम्नलिखित समरूपता से होती है: | |||

:<math>\ln \operatorname{var}_{GX}(\Beta(\alpha, \beta))=\ln \operatorname{var}_{G(1-X)}(\Beta(\beta, \alpha)).</math> | :<math>\ln \operatorname{var}_{GX}(\Beta(\alpha, \beta))=\ln \operatorname{var}_{G(1-X)}(\Beta(\beta, \alpha)).</math> | ||

| Line 448: | Line 445: | ||

==== माध्य के आस-पास निरपेक्ष विचलन ==== | ==== माध्य के आस-पास निरपेक्ष विचलन ==== | ||

[[File:Ratio of Mean Abs. Dev. to Std.Dev. Beta distribution with alpha and beta from 0 to 5 - J. Rodal.jpg|thumb|मीन एब्स.देव का अनुपात। Std.Dev के लिए। α और β के साथ बीटा वितरण के लिए 0 से 5 तक]] | [[File:Ratio of Mean Abs. Dev. to Std.Dev. Beta distribution with alpha and beta from 0 to 5 - J. Rodal.jpg|thumb|मीन एब्स.देव का अनुपात। Std.Dev के लिए। α और β के साथ बीटा वितरण के लिए 0 से 5 तक]] | ||

[[File:Ratio of Mean Abs. Dev. to Std.Dev. Beta distribution vs. nu from 0 to 10 and vs. mean - J. Rodal.jpg|thumb|मीन एब्स.देव का अनुपात। Std.Dev के लिए। माध्य 0 ≤ μ ≤ 1 और | [[File:Ratio of Mean Abs. Dev. to Std.Dev. Beta distribution vs. nu from 0 to 10 and vs. mean - J. Rodal.jpg|thumb|मीन एब्स.देव का अनुपात। Std.Dev के लिए। माध्य 0 ≤ μ ≤ 1 और प्रतिरूप आकार 0 < ν ≤ 10 के साथ बीटा वितरण के लिए]]आकार मापदंडों α और β के साथ बीटा वितरण के लिए माध्य के आसपास औसत निरपेक्ष विचलन है:'''<ref name="Handbook of Beta Distribution" />''' | ||

:<math>\operatorname{E}[|X - E[X]|] = \frac{2 \alpha^{\alpha} \beta^{\beta}}{\Beta(\alpha,\beta)(\alpha + \beta)^{\alpha + \beta + 1}} </math> | :<math>\operatorname{E}[|X - E[X]|] = \frac{2 \alpha^{\alpha} \beta^{\beta}}{\Beta(\alpha,\beta)(\alpha + \beta)^{\alpha + \beta + 1}} </math> | ||

माध्य के चारों ओर औसत निरपेक्ष विचलन मोड के प्रत्येक पक्ष में | माध्य के चारों ओर औसत निरपेक्ष विचलन मोड के प्रत्येक पक्ष में टेल और विभक्ति बिंदुओं के साथ बीटा वितरण के लिए मानक विचलन की तुलना में [[सांख्यिकीय फैलाव]] का अधिक शक्तिशाली सांख्यिकी अनुमानक है, α,β > 2 के साथ बीटा(α, β) वितरण यह माध्य से वर्ग विचलन के अतिरिक्त रैखिक (पूर्ण) विचलन पर निर्भर करता है। इसलिए, माध्य से बहुत बड़े विचलन का प्रभाव उतना अधिक भारित नहीं होता है। | ||

गामा फलन के लिए स्टर्लिंग के सन्निकटन का उपयोग करते हुए, नॉर्मन लॉयड जॉनसन|एन.एल.जॉनसन और सैमुअल कोटज़|एस.कोट्ज़<ref name=JKB />एकता से अधिक आकार के मापदंडों के मूल्यों के लिए निम्नलिखित सन्निकटन प्राप्त किया (इस सन्निकटन के लिए सापेक्ष त्रुटि α = β = 1 के लिए केवल -3.5% है, और यह α → ∞, β → ∞ के रूप में शून्य हो जाती है): | गामा फलन के लिए स्टर्लिंग के सन्निकटन का उपयोग करते हुए, नॉर्मन लॉयड जॉनसन|(एन.एल.जॉनसन) और सैमुअल कोटज़|(एस.कोट्ज़)<ref name=JKB />एकता से अधिक आकार के मापदंडों के मूल्यों के लिए निम्नलिखित सन्निकटन प्राप्त किया (इस सन्निकटन के लिए सापेक्ष त्रुटि α = β = 1 के लिए केवल -3.5% है, और यह α → ∞, β → ∞ के रूप में शून्य हो जाती है): | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 459: | Line 456: | ||

&\approx \sqrt{\frac{2}{\pi}} \left(1+\frac{7}{12 (\alpha+\beta)}{}-\frac{1}{12 \alpha}-\frac{1}{12 \beta} \right), \text{ if } \alpha, \beta > 1. | &\approx \sqrt{\frac{2}{\pi}} \left(1+\frac{7}{12 (\alpha+\beta)}{}-\frac{1}{12 \alpha}-\frac{1}{12 \beta} \right), \text{ if } \alpha, \beta > 1. | ||

\end{align}</math> | \end{align}</math> | ||

सीमा α → ∞, β → ∞ पर, मानक विचलन (बीटा वितरण के लिए) के औसत पूर्ण विचलन का अनुपात सामान्य वितरण के लिए समान उपायों के अनुपात के | सीमा α → ∞, β → ∞ पर, मानक विचलन (बीटा वितरण के लिए) के औसत पूर्ण विचलन का अनुपात सामान्य वितरण के लिए समान उपायों के अनुपात के सामान्तर हो जाता है: <math>\sqrt{\frac{2}{\pi}}</math>. α = β = 1 के लिए यह अनुपात <math>\frac{\sqrt{3}}{2}</math> सामान्तर है , जिससे कि α = β = 1 से α, β → ∞ अनुपात 8.5% कम हो जाएगा। α = β = 0 के लिए मानक विचलन माध्य के चारों ओर [[पूर्ण विचलन]] के सामान्तर है। इसलिए, यह अनुपात α = β = 0 से α = β = 1 तक 15% कम हो जाता है, और α = β = 0 से α, β → ∞ तक 25% कम हो जाता है। चूंकि, विषम बीटा वितरण के लिए जैसे कि α → 0 या β → 0, मानक विचलन का औसत निरपेक्ष विचलन का अनुपात अनंत तक पहुंचता है (चूंकि उनमें से प्रत्येक, व्यक्तिगत रूप से, शून्य तक पहुंचता है) क्योंकि औसत निरपेक्ष विचलन शून्य की तुलना में तेजी से पहुंचता है मानक विचलन। | ||

माध्य μ और | माध्य μ और प्रतिरूप आकार ν = α + β > 0 के संदर्भ में सांख्यिकीय मापदंड का उपयोग करना: | ||

:α = μν, β = (1−μ)ν | :α = μν, β = (1−μ)ν | ||

माध्य μ और | माध्य μ और प्रतिरूप आकार ν के संदर्भ में माध्य के चारों ओर औसत निरपेक्ष विचलन को निम्नानुसार व्यक्त किया जा सकता है: | ||

:<math>\operatorname{E}[| X - E[X]|] = \frac{2 \mu^{\mu\nu} (1-\mu)^{(1-\mu)\nu}}{\nu \Beta(\mu \nu,(1-\mu)\nu)}</math> | :<math>\operatorname{E}[| X - E[X]|] = \frac{2 \mu^{\mu\nu} (1-\mu)^{(1-\mu)\nu}}{\nu \Beta(\mu \nu,(1-\mu)\nu)}</math> | ||

एक सममित वितरण के लिए, माध्य वितरण के मध्य में है | एक सममित वितरण के लिए, μ = 1/2, माध्य वितरण के मध्य में है,और इसलिए: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 475: | Line 472: | ||

\lim_{\nu \to \infty} \left (\lim_{\mu \to \frac{1}{2}} \operatorname{E}[| X - E[X]|] \right ) &= 0 | \lim_{\nu \to \infty} \left (\lim_{\mu \to \frac{1}{2}} \operatorname{E}[| X - E[X]|] \right ) &= 0 | ||

\end{align}</math> | \end{align}</math> | ||

साथ ही, उपरोक्त भावों से निम्नलिखित सीमाएँ प्राप्त की जा सकती हैं (केवल विख्यात | साथ ही, उपरोक्त भावों से निम्नलिखित सीमाएँ प्राप्त की जा सकती हैं (केवल विख्यात वेरिएबल सीमा तक पहुँच रहे हैं): | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 483: | Line 480: | ||

\lim_{\nu \to 0} \operatorname{E}[|X - E[X]|] &= \sqrt{\mu (1-\mu)} \\ | \lim_{\nu \to 0} \operatorname{E}[|X - E[X]|] &= \sqrt{\mu (1-\mu)} \\ | ||

\lim_{\nu \to \infty} \operatorname{E}[|X - E[X]|] &= 0 | \lim_{\nu \to \infty} \operatorname{E}[|X - E[X]|] &= 0 | ||

\end{align}</math> | \end{align} </math> | ||

==== [[मतलब पूर्ण अंतर]] ==== | ==== [[मतलब पूर्ण अंतर|कारणपूर्ण अंतर]] ==== | ||

बीटा वितरण के लिए औसत निरपेक्ष अंतर है: | बीटा वितरण के लिए औसत निरपेक्ष अंतर है: | ||

| Line 496: | Line 493: | ||

=== | === विषमता === | ||

[[File:Skewness for Beta Distribution as a function of the variance and the mean - J. Rodal.jpg|325px|thumb|विचरण और माध्य के कार्य के रूप में बीटा वितरण के लिए | [[File:Skewness for Beta Distribution as a function of the variance and the mean - J. Rodal.jpg|325px|thumb|विचरण और माध्य के कार्य के रूप में बीटा वितरण के लिए विषमता]]विषमता (बीटा वितरण का तीसरा क्षण माध्य पर केंद्रित, विचरण की 3/2 शक्ति द्वारा सामान्यीकृत) है<ref name=JKB /> | ||

:<math>\gamma_1 =\frac{\operatorname{E}[(X - \mu)^3]}{(\operatorname{var}(X))^{3/2}} = \frac{2(\beta - \alpha)\sqrt{\alpha + \beta + 1}}{(\alpha + \beta + 2) \sqrt{\alpha \beta}} .</math> | :<math>\gamma_1 =\frac{\operatorname{E}[(X - \mu)^3]}{(\operatorname{var}(X))^{3/2}} = \frac{2(\beta - \alpha)\sqrt{\alpha + \beta + 1}}{(\alpha + \beta + 2) \sqrt{\alpha \beta}} .</math> | ||

उपरोक्त अभिव्यक्ति में α = β देने से γ | उपरोक्त अभिव्यक्ति में α = β देने से γ<sub>1</sub> = 0 प्राप्त होता है ,तथा बार फिर दिखा रहा है कि α = β के लिए वितरण सममित है और इसलिए विषमता शून्य है। α < β के लिए धनात्मक विषम (दायां-टेल), α> β के लिए ऋणात्मक विषम (बायां-टेल)। | ||

औसत μ और | और औसत μ और प्रतिरूप आकार ν = α + β के संदर्भ में सांख्यिकीय मापदंड का उपयोग करना: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 508: | Line 505: | ||

\beta & {} = (1 - \mu) \nu , \text{ where }\nu =(\alpha + \beta) >0. | \beta & {} = (1 - \mu) \nu , \text{ where }\nu =(\alpha + \beta) >0. | ||

\end{align}</math> | \end{align}</math> | ||

माध्य μ और | माध्य μ और प्रतिरूप आकार ν के संदर्भ में विषमता व्यक्त किया जा सकता है: | ||

:<math>\gamma_1 =\frac{\operatorname{E}[(X - \mu)^3]}{(\operatorname{var}(X))^{3/2}} = \frac{2(1-2\mu)\sqrt{1+\nu}}{(2+\nu)\sqrt{\mu (1 - \mu)}}.</math> | :<math>\gamma_1 =\frac{\operatorname{E}[(X - \mu)^3]}{(\operatorname{var}(X))^{3/2}} = \frac{2(1-2\mu)\sqrt{1+\nu}}{(2+\nu)\sqrt{\mu (1 - \mu)}}.</math> | ||

विषमता केवल विचरण संस्करण और माध्य μ के रूप में निम्नानुसार व्यक्त किया जा सकता है: | |||

:<math>\gamma_1 =\frac{\operatorname{E}[(X - \mu)^3]}{(\operatorname{var}(X))^{3/2}} = \frac{2(1-2\mu)\sqrt{\text{ var }}}{ \mu(1-\mu) + \operatorname{var}}\text{ if } \operatorname{var} < \mu(1-\mu)</math> | :<math>\gamma_1 =\frac{\operatorname{E}[(X - \mu)^3]}{(\operatorname{var}(X))^{3/2}} = \frac{2(1-2\mu)\sqrt{\text{ var }}}{ \mu(1-\mu) + \operatorname{var}}\text{ if } \operatorname{var} < \mu(1-\mu)</math> | ||

विचरण और माध्य के कार्य के रूप में | विचरण और माध्य के कार्य के रूप में विषमता के साथ की साजिश से पता चलता है कि अधिकतम विचरण (1/4) शून्य विषमता और समरूपता की स्थिति (μ = 1/2) के साथ युग्मित है, और वह अधिकतम विषमता (धनात्मक या ऋणात्मक अनंत) तब होता है जब माध्य छोर या दूसरे छोर पर स्थित है, जिससे संभाव्यता वितरण का द्रव्यमान सिरों पर केंद्रित हो (न्यूनतम विचरण )। | ||

प्रतिरूप के आकार ν = α + β और विचरण संस्करण के संदर्भ में विषमता के वर्ग के लिए निम्नलिखित अभिव्यक्ति, चार मापदंडों के क्षणों के आकलन की विधि के लिए उपयोगी है: | |||

:<math>(\gamma_1)^2 =\frac{(\operatorname{E}[(X - \mu)^3])^2}{(\operatorname{var}(X))^3} = \frac{4}{(2+\nu)^2}\bigg(\frac{1}{\text{var}}-4(1+\nu)\bigg)</math> | :<math>(\gamma_1)^2 =\frac{(\operatorname{E}[(X - \mu)^3])^2}{(\operatorname{var}(X))^3} = \frac{4}{(2+\nu)^2}\bigg(\frac{1}{\text{var}}-4(1+\nu)\bigg)</math> | ||

यह अभिव्यक्ति सही ढंग से α = β के लिए शून्य का | यह अभिव्यक्ति सही ढंग से α = β के लिए शून्य का विषमता देती है, क्योंकि उस स्तिथियाँ में (देखें {{section link||वरिएंस }}): <math>\operatorname{var} = \frac{1}{4 (1 + \nu)}</math>. | ||

सममित | सममित स्तिथियाँ के लिए (α = β), विषमता = 0 पूरी सीमा पर, और निम्नलिखित सीमाएँ प्रयुक्त होती हैं: | ||

:<math>\lim_{\alpha = \beta \to 0} \gamma_1 = \lim_{\alpha = \beta \to \infty} \gamma_1 =\lim_{\nu \to 0} \gamma_1=\lim_{\nu \to \infty} \gamma_1=\lim_{\mu \to \frac{1}{2}} \gamma_1 = 0</math> | :<math>\lim_{\alpha = \beta \to 0} \gamma_1 = \lim_{\alpha = \beta \to \infty} \gamma_1 =\lim_{\nu \to 0} \gamma_1=\lim_{\nu \to \infty} \gamma_1=\lim_{\mu \to \frac{1}{2}} \gamma_1 = 0</math> | ||

असममित | असममित स्थितियों के लिए (α ≠ β) निम्नलिखित सीमाएँ (केवल विख्यात वेरिएबल सीमा के समीप पहुंचकर) उपरोक्त अभिव्यक्तियों से प्राप्त की जा सकती हैं: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 536: | Line 533: | ||

[[File:Skewness Beta Distribution for alpha and beta from 1 to 5 - J. Rodal.jpg|325px]][[File:Skewness Beta Distribution for alpha and beta from .1 to 5 - J. Rodal.jpg|325px]] | [[File:Skewness Beta Distribution for alpha and beta from 1 to 5 - J. Rodal.jpg|325px]][[File:Skewness Beta Distribution for alpha and beta from .1 to 5 - J. Rodal.jpg|325px]] | ||

=== | === कुर्तबसिस === | ||

[[File:Excess Kurtosis for Beta Distribution as a function of variance and mean - J. Rodal.jpg|325px|thumb|विचरण और माध्य के कार्य के रूप में बीटा वितरण के लिए अतिरिक्त कर्टोसिस]]गियर के | [[File:Excess Kurtosis for Beta Distribution as a function of variance and mean - J. Rodal.jpg|325px|thumb|विचरण और माध्य के कार्य के रूप में बीटा वितरण के लिए अतिरिक्त कर्टोसिस]]गियर के हानि का आकलन करने के लिए ध्वनिक विश्लेषण में बीटा वितरण प्रयुक्त किया गया है, क्योंकि बीटा वितरण के कर्टोसिस को गियर की स्थिति का अच्छा संकेतक बताया गया है।<ref name=Oguamanam>{{cite journal |last1=Oguamanam |first1=D.C.D. |last2=Martin |first2=H. R. |last3=Huissoon |first3=J. P. |title=गियर क्षति विश्लेषण के लिए बीटा वितरण के अनुप्रयोग पर|journal=Applied Acoustics |year=1995 |volume=45 |issue=3 |pages=247–261 |doi=10.1016/0003-682X(95)00001-P}}</ref> कर्टोसिस का उपयोग किसी व्यक्ति के कदमों से उत्पन्न भूकंपीय संकेत को अन्य संकेत से अलग करने के लिए भी किया जाता है। जैसा कि जमीन पर चलने वाले व्यक्ति या अन्य लक्ष्य भूकंपीय तरंगों के रूप में निरंतर संकेत उत्पन्न करते हैं, उनके द्वारा उत्पन्न भूकंपीय तरंगों के आधार पर विभिन्न लक्ष्यों को अलग किया जा सकता है। कर्टोसिस आवेगी संकेतबं के प्रति संवेदनशील है, इसलिए यह वाहनों, हवाओं, ध्वनि आदि द्वारा उत्पन्न अन्य संकेत की तुलना में मानव पदचिन्हों द्वारा उत्पन्न संकेतबं के प्रति अधिक संवेदनशील है।<ref name=Liang>{{cite journal|author1=Zhiqiang Liang |author2=Jianming Wei |author3=Junyu Zhao |author4=Haitao Liu |author5=Baoqing Li |author6=Jie Shen |author7=Chunlei Zheng |title=कर्टोसिस का सांख्यिकीय अर्थ और भूकंपीय संकेतों के आधार पर व्यक्तियों की पहचान के लिए इसका नया अनुप्रयोग|journal=Sensors |date=27 August 2008 |volume=8 |issue=8 |pages=5106–5119 |doi=10.3390/s8085106|pmid=27873804 |pmc=3705491 |bibcode=2008Senso...8.5106L |doi-access=free }}</ref> दुर्भाग्य से, ककुदता के लिए अंकन मानकीकृत नहीं किया गया है। अतिरिक्त कर्टोसिस के लिए केनी और कीपिंग में प्रतीक γ<sub>2</sub> का प्रयोग करें <ref name="Abramowitz">{{cite book|last=Abramowitz|first=Milton and Irene A. Stegun|title=सूत्र, रेखांकन और गणितीय तालिकाओं के साथ गणितीय कार्यों की पुस्तिका|year=1965|publisher=Dover|isbn=978-0-486-61272-0|url=https://archive.org/details/handbookofmathe000abra}}</ref>, किन्तु [[अब्रामोवित्ज़ और स्टेगुन]] विभिन्न शब्दावली का प्रयोग करें।<ref name="Kenney and Keeping">{{cite book|last=Kenney|first=J. F., and E. S. Keeping|title=Mathematics of Statistics Part Two, 2nd edition|year=1951|publisher=D. Van Nostrand Company Inc.}}</ref> भ्रम को रोकने के लिए कर्टोसिस के मध्य (माध्य पर केंद्रित चौथा क्षण, विचरण के वर्ग द्वारा सामान्यीकृत)<ref name=Weisstein.Kurtosi>{{cite web|last=Weisstein.|first=Eric W.|title=कुकुदता|url=http://mathworld.wolfram.com/कुकुदता.html|publisher=MathWorld--A Wolfram Web Resource|access-date=13 August 2012}}</ref> और अतिरिक्त कर्टोसिस, प्रतीकों का उपयोग करते समय, उन्हें निम्नानुसार लिखा जाएगा:<ref name="Handbook of Beta Distribution">{{cite book|editor-last=Gupta|editor-first=Arjun K.|title=हैंडबुक ऑफ़ बीटा डिस्ट्रीब्यूशन एंड इट्स एप्लीकेशन्स|year=2004|publisher=CRC Press|isbn=978-0824753962}}</ref><ref name=Panik>{{cite book|last=Panik|first=Michael J|title=प्रारंभिक दृष्टिकोण से उन्नत सांख्यिकी|year=2005|publisher=Academic Press|isbn=978-0120884940}}</ref> | ||

:<math>\begin{align} | :<math>\begin{align} | ||

\text{excess kurtosis} | \text{excess kurtosis} | ||

| Line 545: | Line 542: | ||

&=\frac{6[(\alpha - \beta)^2 (\alpha +\beta + 1) - \alpha \beta (\alpha + \beta + 2)]} | &=\frac{6[(\alpha - \beta)^2 (\alpha +\beta + 1) - \alpha \beta (\alpha + \beta + 2)]} | ||

{\alpha \beta (\alpha + \beta + 2) (\alpha + \beta + 3)} . | {\alpha \beta (\alpha + \beta + 2) (\alpha + \beta + 3)} . | ||

\end{align}</math> | \end{align} </math> | ||

उपरोक्त व्यंजक में α = β देने से प्राप्त होता है | उपरोक्त व्यंजक में α = β देने से प्राप्त होता है | ||

:<math>\text{excess kurtosis} =- \frac{6}{3+2\alpha} \text{ if }\alpha=\beta </math>. | :<math>\text{excess kurtosis} =- \frac{6}{3+2\alpha} \text{ if }\alpha=\beta </math>. | ||

इसलिए, सममित बीटा वितरण के लिए, अतिरिक्त कर्टोसिस | इसलिए, सममित बीटा वितरण के लिए, अतिरिक्त कर्टोसिस ऋणात्मक है, {α = β} → 0 के रूप में सीमा पर -2 के न्यूनतम मान से बढ़ रहा है, और शून्य के अधिकतम मान को {α = β} → ∞ के रूप में आ रहा है। तथा −2 का मान अतिरिक्त कर्टोसिस का न्यूनतम मूल्य है जिसे कोई भी वितरण (न केवल बीटा वितरण, किंतु किसी भी संभावित प्रकार का वितरण) कभी भी प्राप्त कर सकता है। यह न्यूनतम मूल्य तब प्राप्त होता है जब सभी प्रायिकता घनत्व पूरी तरह से प्रत्येक छोर x = 0 और x = 1 पर केंद्रित होते हैं, मध्य में कुछ भी नहीं होता है: प्रत्येक छोर पर समान संभावना 1/2 के साथ 2-बिंदु बर्नौली वितरण (एक सिक्का टॉस: देखें) आगे की चर्चा के लिए विषमता के वर्ग से घिरे कर्टोसिस के नीचे का खंड)। संभाव्यता वितरण के संभावित आउटलेयर (या संभावित दुर्लभ, वेरिएबल मान) के माप के रूप में [[ कुकुदता ]] का विवरण, बीटा वितरण सहित सभी वितरणों के लिए सही है। जब दुर्लभ, वेरिएबल म मान बीटा वितरण में हो सकते हैं, तब इसका कर्टोसिस जितना अधिक होगा; अन्यथा, कर्टोसिस कम होता है। α ≠ β, विषम बीटा वितरण के लिए, अतिरिक्त कर्टोसिस असीमित धनात्मक मूल्यों तक पहुंच सकता है (विशेष रूप से α → 0 के लिए परिमित β के लिए, या β → 0 के लिए परिमित α के लिए) क्योंकि मोड से दूर की ओर कभी-कभी चरम मान उत्पन्न होंगे। न्यूनतम कर्टोसिस तब होता है जब द्रव्यमान घनत्व प्रत्येक छोर पर समान रूप से केंद्रित होता है (और इसलिए माध्य केंद्र में होता है), और सिरों के मध्य द्रव्यमान घनत्व की कोई संभावना नहीं होती है। | ||

औसत μ और | औसत μ और प्रतिरूप आकार ν = α + β के संदर्भ में सांख्यिकीय मापदंड का उपयोग करना: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 558: | Line 555: | ||

\beta & {} = (1 - \mu) \nu , \text{ where }\nu =(\alpha + \beta) >0. | \beta & {} = (1 - \mu) \nu , \text{ where }\nu =(\alpha + \beta) >0. | ||

\end{align}</math> | \end{align}</math> | ||

माध्य μ और | माध्य μ और प्रतिरूप आकार ν के संदर्भ में अतिरिक्त कर्टोसिस को निम्नानुसार व्यक्त किया जा सकता है: | ||

:<math>\text{excess kurtosis} =\frac{6}{3 + \nu}\bigg (\frac{(1 - 2 \mu)^2 (1 + \nu)}{\mu (1 - \mu) (2 + \nu)} - 1 \bigg )</math> | :<math>\text{excess kurtosis} =\frac{6}{3 + \nu}\bigg (\frac{(1 - 2 \mu)^2 (1 + \nu)}{\mu (1 - \mu) (2 + \nu)} - 1 \bigg )</math> | ||

अतिरिक्त कर्टोसिस को केवल निम्नलिखित दो मापदंडों के संदर्भ में भी व्यक्त किया जा सकता है: विचरण संस्करण, और | अतिरिक्त कर्टोसिस को केवल निम्नलिखित दो मापदंडों के संदर्भ में भी व्यक्त किया जा सकता है: विचरण संस्करण, और प्रतिरूप आकार ν निम्नानुसार है: | ||

:<math>\text{excess kurtosis} =\frac{6}{(3 + \nu)(2 + \nu)}\left(\frac{1}{\text{ var }} - 6 - 5 \nu \right)\text{ if }\text{ var }< \mu(1-\mu)</math> | :<math>\text{excess kurtosis} =\frac{6}{(3 + \nu)(2 + \nu)}\left(\frac{1}{\text{ var }} - 6 - 5 \nu \right)\text{ if }\text{ var }< \mu(1-\mu)</math> | ||

| Line 567: | Line 564: | ||

:<math>\text{excess kurtosis} =\frac{6 \text{ var } (1 - \text{ var } - 5 \mu (1 - \mu) )}{(\text{var } + \mu (1 - \mu))(2\text{ var } + \mu (1 - \mu) )}\text{ if }\text{ var }< \mu(1-\mu)</math> | :<math>\text{excess kurtosis} =\frac{6 \text{ var } (1 - \text{ var } - 5 \mu (1 - \mu) )}{(\text{var } + \mu (1 - \mu))(2\text{ var } + \mu (1 - \mu) )}\text{ if }\text{ var }< \mu(1-\mu)</math> | ||

विचरण और माध्य के कार्य के रूप में अतिरिक्त कर्टोसिस की साजिश से पता चलता है कि अतिरिक्त | विचरण और माध्य के कार्य के रूप में अतिरिक्त कर्टोसिस की साजिश से पता चलता है कि अतिरिक्त कुर्तबसिस का न्यूनतम मूल्य (−2, जो किसी भी वितरण के लिए अतिरिक्त कर्टोसिस के लिए न्यूनतम संभव मूल्य है) अंतर के अधिकतम मूल्य के साथ घनिष्ठ रूप से जुड़ा हुआ है ( 1/4) और समरूपता की स्थिति: मध्य बिंदु पर होने वाली माध्य (μ = 1/2)। यह शून्य विषमता के साथ α = β = 0 के सममित स्तिथियाँ के लिए होता है। सीमा पर, यह 2 बिंदु बर्नौली वितरण है जिसमें समान संभावना 1/2 प्रत्येक डायराक डेल्टा फलन के अंत में x = 0 और x = 1 और हर स्थान शून्य संभावना है। (एक सिक्के का उछाल: सिक्के का फलक x = 0 और दूसरा फलक x = 1 है।) प्रसरण अधिकतम है क्योंकि वितरण के दो मोडल है और प्रत्येक छोर पर दो मोड (स्पाइक्स) के मध्य कुछ भी नहीं है। अतिरिक्त कर्टोसिस न्यूनतम है:क्योंकि संभाव्यता घनत्व द्रव्यमान माध्य पर शून्य है और यह प्रत्येक छोर पर दो चोटियों पर केंद्रित है। अतिरिक्त कर्टोसिस न्यूनतम संभव मान (किसी भी वितरण के लिए) तक पहुँच जाता है जब प्रायिकता घनत्व फलन के प्रत्येक छोर पर दो स्पाइक्स होते हैं: यह द्वि-शिखर होता है। और उनके मध्य में कुछ भी नहीं होता है | ||

दूसरी ओर, प्लॉट से पता चलता है कि अत्यधिक | दूसरी ओर, प्लॉट से पता चलता है कि अत्यधिक विषम स्थितियों के लिए, जहां माध्य या दूसरे छोर (μ = 0 या μ = 1) के पास स्थित है, विचरण शून्य के समीप है, और अतिरिक्त कर्टोसिस तेजी से अनंत तक पहुंचता है जब बंटन का माध्य या तब अंत की ओर पहुंचता है। | ||

वैकल्पिक रूप से, अतिरिक्त कर्टोसिस को केवल निम्नलिखित दो मापदंडों के संदर्भ में भी व्यक्त किया जा सकता है: | वैकल्पिक रूप से, अतिरिक्त कर्टोसिस को केवल निम्नलिखित दो मापदंडों के संदर्भ में भी व्यक्त किया जा सकता है: विषमता का वर्ग, और प्रतिरूप आकार ν निम्नानुसार है: | ||

:<math>\text{excess kurtosis} =\frac{6}{3 + \nu}\bigg(\frac{(2 + \nu)}{4} (\text{skewness})^2 - 1\bigg)\text{ if (skewness)}^2-2< \text{excess kurtosis}< \frac{3}{2} (\text{skewness})^2</math> | :<math>\text{excess kurtosis} =\frac{6}{3 + \nu}\bigg(\frac{(2 + \nu)}{4} (\text{skewness})^2 - 1\bigg)\text{ if (skewness)}^2-2< \text{excess kurtosis}< \frac{3}{2} (\text{skewness})^2</math> | ||

इस अंतिम अभिव्यक्ति से, [[कार्ल पियर्सन]] द्वारा अपने पेपर में व्यावहारिक रूप से सदी पहले प्रकाशित समान सीमाएँ प्राप्त कर सकते हैं,<ref name=Pearson />बीटा वितरण के लिए ( | इस अंतिम अभिव्यक्ति से, [[कार्ल पियर्सन]] द्वारा अपने पेपर में व्यावहारिक रूप से सदी पहले प्रकाशित समान सीमाएँ प्राप्त कर सकते हैं,<ref name=Pearson />बीटा वितरण के लिए (विषमता के वर्ग से घिरा कर्टोसिस शीर्षक वाला नीचे दिया गया अनुभाग देखें)। उपरोक्त व्यंजक में α + β= ν = 0 समुच्चय करने पर, पियर्सन की निचली सीमा प्राप्त होती है (सीमा के नीचे विषमता और अतिरिक्त कर्टोसिस के लिए मान (अतिरिक्त कर्टोसिस + 2 - विषमता<sup>2</sup> = 0) किसी भी वितरण के लिए नहीं हो सकता है, और इसलिए कार्ल पियर्सन ने उचित रूप से इस सीमा के नीचे के क्षेत्र को असंभव क्षेत्र कहा है)। α + β = ν → ∞ की सीमा पियर्सन की ऊपरी सीमा निर्धारित करती है। | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 583: | Line 580: | ||

:<math>(\text{skewness})^2-2< \text{excess kurtosis}< \tfrac{3}{2} (\text{skewness})^2</math> | :<math>(\text{skewness})^2-2< \text{excess kurtosis}< \tfrac{3}{2} (\text{skewness})^2</math> | ||

ν = α + β के मान जैसे कि ν शून्य से अनंत तक होता है, 0 < ν < ∞, बीटा वितरण के पूरे क्षेत्र को अतिरिक्त कर्टोसिस बनाम स्क्वायर | ν = α + β के मान जैसे कि ν शून्य से अनंत तक होता है, 0 < ν < ∞, बीटा वितरण के पूरे क्षेत्र को अतिरिक्त कर्टोसिस बनाम स्क्वायर विषमता के विमान में फैलाता है। | ||

सममित | सममित स्तिथियाँ (α = β) के लिए, निम्नलिखित सीमाएं प्रयुक्त होती हैं: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 592: | Line 589: | ||

&\lim_{\mu \to \frac{1}{2}} \text{excess kurtosis} = - \frac{6}{3 + \nu} | &\lim_{\mu \to \frac{1}{2}} \text{excess kurtosis} = - \frac{6}{3 + \nu} | ||

\end{align}</math> | \end{align}</math> | ||

असममित | असममित स्थितियों के लिए (α ≠ β) निम्नलिखित सीमाएँ (केवल विख्यात वेरिएबल सीमा के समीप पहुंचकर) उपरोक्त अभिव्यक्तियों से प्राप्त की जा सकती हैं: | ||

:<math> \begin{align} | :<math> \begin{align} | ||

| Line 599: | Line 596: | ||

&\lim_{\beta \to \infty}\text{excess kurtosis} = \frac{6}{\alpha},\text{ } \lim_{\alpha \to 0}(\lim_{\beta \to \infty} \text{excess kurtosis}) = \infty,\text{ } \lim_{\alpha \to \infty}(\lim_{\beta \to \infty} \text{excess kurtosis}) = 0\\ | &\lim_{\beta \to \infty}\text{excess kurtosis} = \frac{6}{\alpha},\text{ } \lim_{\alpha \to 0}(\lim_{\beta \to \infty} \text{excess kurtosis}) = \infty,\text{ } \lim_{\alpha \to \infty}(\lim_{\beta \to \infty} \text{excess kurtosis}) = 0\\ | ||

&\lim_{\nu \to 0} \text{excess kurtosis} = - 6 + \frac{1}{\mu (1 - \mu)},\text{ } \lim_{\mu \to 0}(\lim_{\nu \to 0} \text{excess kurtosis}) = \infty,\text{ } \lim_{\mu \to 1}(\lim_{\nu \to 0} \text{excess kurtosis}) = \infty | &\lim_{\nu \to 0} \text{excess kurtosis} = - 6 + \frac{1}{\mu (1 - \mu)},\text{ } \lim_{\mu \to 0}(\lim_{\nu \to 0} \text{excess kurtosis}) = \infty,\text{ } \lim_{\mu \to 1}(\lim_{\nu \to 0} \text{excess kurtosis}) = \infty | ||

\end{align}</math> | \end{align} </math> | ||

[[File:Excess Kurtosis for Beta Distribution with alpha and beta ranging from 1 to 5 - J. Rodal.jpg|325px]][[File:Excess Kurtosis for Beta Distribution with alpha and beta ranging from 0.1 to 5 - J. Rodal.jpg|325px]] | [[File:Excess Kurtosis for Beta Distribution with alpha and beta ranging from 1 to 5 - J. Rodal.jpg|325px]][[File:Excess Kurtosis for Beta Distribution with alpha and beta ranging from 0.1 to 5 - J. Rodal.jpg|325px]] | ||

अभिलक्षणिक फलन (संभाव्यता सिद्धांत) प्रायिकता घनत्व फलन का [[फूरियर रूपांतरण]] है। बीटा डिस्ट्रीब्यूशन का विशिष्ट कार्य कंफ्लुएंट हाइपरजियोमेट्रिक | === विशेषता फलन === | ||

अभिलक्षणिक फलन (संभाव्यता सिद्धांत) प्रायिकता घनत्व फलन का [[फूरियर रूपांतरण]] है। बीटा डिस्ट्रीब्यूशन का विशिष्ट कार्य कंफ्लुएंट हाइपरजियोमेट्रिक फलन है। कुमेर का कंफ्लुएंट हाइपरजियोमेट्रिक फलन (पहली तरह का):<ref name="JKB" /><ref name="Abramowitz" /><ref name="Zwillinger_2014">{{cite book |author-first1=Izrail Solomonovich |author-last1=Gradshteyn |author-link1=Izrail Solomonovich Gradshteyn |author-first2=Iosif Moiseevich |author-last2=Ryzhik |author-link2=Iosif Moiseevich Ryzhik |author-first3=Yuri Veniaminovich |author-last3=Geronimus |author-link3=Yuri Veniaminovich Geronimus |author-first4=Michail Yulyevich |author-last4=Tseytlin |author-link4=Michail Yulyevich Tseytlin |author-first5=Alan |author-last5=Jeffrey |editor1-first=Daniel |editor1-last=Zwillinger |editor2-first=Victor Hugo |editor2-last=Moll |editor-link2=Victor Hugo Moll |translator=Scripta Technica, Inc. |title=इंटीग्रल्स, सीरीज़ और उत्पादों की तालिका|publisher=[[Academic Press, Inc.]] |date=2015 |orig-year=October 2014 |edition=8 |language=en |isbn=978-0-12-384933-5 |lccn=2014010276 <!-- |url=https://books.google.com/books?id=NjnLAwAAQBAJ |access-date=2016-02-21-->|title-link=Gradshteyn and Ryzhik}}</ref> | |||

:<math>\begin{align} | :<math>\begin{align} | ||

\varphi_X(\alpha;\beta;t) | \varphi_X(\alpha;\beta;t) | ||

| Line 615: | Line 611: | ||

&= 1 +\sum_{k=1}^{\infty} \left( \prod_{r=0}^{k-1} \frac{\alpha+r}{\alpha+\beta+r} \right) \frac{(it)^k}{k!} | &= 1 +\sum_{k=1}^{\infty} \left( \prod_{r=0}^{k-1} \frac{\alpha+r}{\alpha+\beta+r} \right) \frac{(it)^k}{k!} | ||

\end{align}</math> | \end{align}</math> | ||

जहाँ | |||

: <math>x^{(n)}=x(x+1)(x+2)\cdots(x+n-1)</math> | : <math>x^{(n)}=x(x+1)(x+2)\cdots(x+n-1)</math> | ||

| Line 622: | Line 618: | ||

:<math> \varphi_X(\alpha;\beta;0)={}_1F_1(\alpha; \alpha+\beta; 0) = 1 </math>. | :<math> \varphi_X(\alpha;\beta;0)={}_1F_1(\alpha; \alpha+\beta; 0) = 1 </math>. | ||

इसके | इसके अतिरिक्त, वेरिएबल टी की उत्पत्ति के संबंध में विशेषता फलन के वास्तविक और काल्पनिक भाग निम्नलिखित समरूपता का आनंद लेते हैं: | ||

:<math> \textrm{Re} \left [ {}_1F_1(\alpha; \alpha+\beta; it) \right ] = \textrm{Re} \left [ {}_1F_1(\alpha; \alpha+\beta; - it) \right ] </math> | :<math> \textrm{Re} \left [ {}_1F_1(\alpha; \alpha+\beta; it) \right ] = \textrm{Re} \left [ {}_1F_1(\alpha; \alpha+\beta; - it) \right ] </math> | ||

:<math> \textrm{Im} \left [ {}_1F_1(\alpha; \alpha+\beta; it) \right ] = - \textrm{Im} \left [ {}_1F_1(\alpha; \alpha+\beta; - it) \right ] </math> | :<math> \textrm{Im} \left [ {}_1F_1(\alpha; \alpha+\beta; it) \right ] = - \textrm{Im} \left [ {}_1F_1(\alpha; \alpha+\beta; - it) \right ] </math> | ||

सममित | सममित स्तिथि α = β [[बेसेल समारोह|बेसेल फलन]] के लिए बीटा वितरण के विशिष्ट कार्य को सरल करता है, क्योंकि विशेष स्तिथियों में α + β = 2α [[संगम हाइपरज्यामितीय समारोह|संगम हाइपरज्यामितीय फलन]] पहली तरह <math>I_{\alpha-\frac 1 2}</math> ) (पहली तरह का) बेसेल फलन (संशोधित बेसेल फलन) को कम करता है अर्नस्ट कुमेर | कुमेर के दूसरे परिवर्तन का उपयोग इस प्रकार है: | ||

बीमा रूपिंग अनुप्रयोगों के लिए सममित स्तिथियाँ α = β = n/2 का और उदाहरण चित्र 11 में पाया जा सकता है <ref>{{cite journal |url=https://www.researchgate.net/publication/347575735 |doi=10.13140/RG.2.2.16399.71848|year=2020 |last1=Buchanan |first1=Kris |last2=Wheeland |first2=Sara |last3=Flores |first3=Carlos |last4=Overturf |first4=Drew |last5=Adeyemi |first5=Timi |last6=Acevedo |first6=Vincent |last7=Huff |first7=Gregory |title=Analysis of Collaborative Beamforming for Circularly Bound Random Antenna Array Distributions }}</ref> | |||

:<math>\begin{align} {}_1F_1(\alpha;2\alpha; it) &= e^{\frac{it}{2}} {}_0F_1 \left(; \alpha+\tfrac{1}{2}; \frac{(it)^2}{16} \right) \\ | :<math>\begin{align} {}_1F_1(\alpha;2\alpha; it) &= e^{\frac{it}{2}} {}_0F_1 \left(; \alpha+\tfrac{1}{2}; \frac{(it)^2}{16} \right) \\ | ||

&= e^{\frac{it}{2}} \left(\frac{it}{4}\right)^{\frac{1}{2}-\alpha} \Gamma\left(\alpha+\tfrac{1}{2}\right) I_{\alpha-\frac 1 2}\left(\frac{it}{2}\right).\end{align}</math> | &= e^{\frac{it}{2}} \left(\frac{it}{4}\right)^{\frac{1}{2}-\alpha} \Gamma\left(\alpha+\tfrac{1}{2}\right) I_{\alpha-\frac 1 2}\left(\frac{it}{2}\right).\end{align}</math> | ||

साथ वाले भूखंडों में, सममित (α = β) और विषम (α ≠ β) | साथ वाले भूखंडों में, सममित (α = β) और विषम (α ≠ β) स्थितियों के लिए बीटा वितरण के विशेषता फलन (संभाव्यता सिद्धांत) की [[जटिल संख्या]] (Re) प्रदर्शित की जाती है। | ||

=== अन्य क्षण === | === अन्य क्षण === | ||

==== मोमेंट जनरेटिंग | ==== मोमेंट जनरेटिंग फलन ==== | ||

यह भी अनुसरण करता है<ref name=JKB /><ref name="Handbook of Beta Distribution" />वह [[क्षण उत्पन्न करने वाला कार्य]] है | यह भी अनुसरण करता है<ref name=JKB /><ref name="Handbook of Beta Distribution" /> वह [[क्षण उत्पन्न करने वाला कार्य]] है | ||

:<math>\begin{align} | :<math>\begin{align} | ||

| Line 645: | Line 641: | ||

&= \sum_{n=0}^\infty \frac {\alpha^{(n)}} {(\alpha+\beta)^{(n)}}\frac {t^n}{n!}\\[4pt] | &= \sum_{n=0}^\infty \frac {\alpha^{(n)}} {(\alpha+\beta)^{(n)}}\frac {t^n}{n!}\\[4pt] | ||

&= 1 +\sum_{k=1}^{\infty} \left( \prod_{r=0}^{k-1} \frac{\alpha+r}{\alpha+\beta+r} \right) \frac{t^k}{k!} | &= 1 +\sum_{k=1}^{\infty} \left( \prod_{r=0}^{k-1} \frac{\alpha+r}{\alpha+\beta+r} \right) \frac{t^k}{k!} | ||

\end{align}</math> | \end{align}</math> | ||