क्रॉस एन्ट्रापी

| Information theory |

|---|

|

सूचना सिद्धांत में, दो संभाव्यता वितरणों और के मध्य तिर्यक्-एन्ट्रॉपी यदि समुच्चय के लिए उपयोग की जाने वाली कोडन योजना अनुमानित वास्तविक वितरण के बजाय संभाव्यता वितरण के लिए अनुकूलित है, तो घटनाओं के समान अंतर्निहित समुच्चय पर समुच्चय से खींची गई घटना की पहचान करने के लिए आवश्यक अंश की औसत संख्या को मापता है।

परिभाषा

वितरण की तिर्यक्-एन्ट्रॉपी वितरण के सापेक्ष किसी दिए गए समुच्चय को इस प्रकार परिभाषित किया गया है:

जहाँ वितरण के संबंध में अपेक्षित मान संचालक है।

परिभाषा कुल्बैक-लीब्लर विचलन का उपयोग करके तैयार की जा सकती है, विचलन से का (इसके संबंध में , की सापेक्ष एन्ट्रापी के रूप में भी जाना जाता है)।

जहाँ की एन्ट्रापी है।

असतत संभाव्यता वितरण और के लिए, उसी समर्थन के साथ (माप सिद्धांत) इसका अर्थ यह है:

|

(Eq.1) |

सतत वितरण की स्थिति समान है। हमें यह मानना होगा कि कुछ संदर्भ माप के संबंध में और बिल्कुल सतत हैं (सामान्यतः बोरेल σ-बीजगणित पर एक लेब्सेग माप है। मान लीजिए कि और , और के संभाव्यता घनत्व फलन हैं। तब

और इसलिए

|

(Eq.2) |

एनबी: संकेतन का उपयोग एक अलग अवधारणा, संयुक्त एन्ट्रापी और के लिए भी किया जाता है।

प्रेरणा

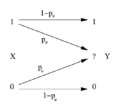

सूचना सिद्धांत में, क्राफ्ट-मैकमिलन प्रमेय स्थापित करता है कि एक मान की पहचान करने के लिए किसी संकेत को कोड करने के लिए कोई भी सीधे डिकोड करने योग्य कोडन योजना संभावनाओं के एक समुच्चय से बाहर