माध्यिका: Difference between revisions

No edit summary |

No edit summary |

||

| Line 64: | Line 64: | ||

: 1, 2, 2, 2, 3, 14। | : 1, 2, 2, 2, 3, 14। | ||

इस स्थिति में माध्यिका 2 है, जैसा कि [[मोड (सांख्यिकी)]] है, और इसे 4 के अंकगणितीय माध्य की तुलना में [[केंद्रीय प्रवृत्ति]] के बेहतर संकेत के रूप में देखा जा सकता है, जो कि मूल्यों में से एक को छोड़कर सभी से बड़ा है। चूंकि, व्यापक रूप से उद्धृत अनुभवजन्य संबंध है कि माध्य की तुलना में माध्य को वितरण की पूंछ में आगे स्थानांतरित कर दिया जाता है, यह सामान्यतः सच नहीं है। अधिक से अधिक, कोई यह कह सकता है कि दो आँकड़े बहुत दूर नहीं हो सकते | इस स्थिति में माध्यिका 2 है, जैसा कि [[मोड (सांख्यिकी)]] है, और इसे 4 के अंकगणितीय माध्य की तुलना में [[केंद्रीय प्रवृत्ति]] के बेहतर संकेत के रूप में देखा जा सकता है, जो कि मूल्यों में से एक को छोड़कर सभी से बड़ा है। चूंकि, व्यापक रूप से उद्धृत अनुभवजन्य संबंध है कि माध्य की तुलना में माध्य को वितरण की पूंछ में आगे स्थानांतरित कर दिया जाता है, यह सामान्यतः सच नहीं है। अधिक से अधिक, कोई यह कह सकता है कि दो आँकड़े बहुत दूर नहीं हो सकते, {{slink||असमानता संबंधित साधन और माध्यिकाएँ}} नीचे देखे।<ref>{{cite journal |url=http://www.amstat.org/publications/jse/v13n2/vonhippel.html |title=Mean, Median, and Skew: Correcting a Textbook Rule |journal=Journal of Statistics Education |volume=13 |issue=2 |author=Paul T. von Hippel |year=2005 |access-date=2015-06-18 |archive-date=2008-10-14 |archive-url=https://web.archive.org/web/20081014045349/http://www.amstat.org/publications/jse/v13n2/vonhippel.html |url-status=dead }}</ref> | ||

चूंकि एक मध्यिका एक सेट में मध्य डेटा पर आधारित होती है, इसकी गणना करने के लिए चरम परिणामों के मूल्य को जानना आवश्यक नहीं है। उदाहरण के लिए, किसी समस्या को हल करने के लिए आवश्यक समय की जांच करने वाले मनोविज्ञान परीक्षण में, यदि बहुत कम संख्या में लोग दिए गए समय में समस्या को हल करने में विफल | चूंकि एक मध्यिका एक सेट में मध्य डेटा पर आधारित होती है, इसकी गणना करने के लिए चरम परिणामों के मूल्य को जानना आवश्यक नहीं होता है। उदाहरण के लिए, किसी समस्या को हल करने के लिए आवश्यक समय की जांच करने वाले मनोविज्ञान परीक्षण में, यदि बहुत कम संख्या में लोग दिए गए समय में समस्या को हल करने में विफल रहता है, तब भी माध्यिका की गणना की जा सकती है।<ref name="Robson">{{cite book | last1=Robson|first1=Colin | title=मनोविज्ञान में प्रयोग, डिजाइन और सांख्यिकी|date=1994|publisher=Penguin |isbn=0-14-017648-9|pages=42–45}}</ref> | ||

व्यावहारिक उद्देश्यों के लिए, स्थान और फैलाव के विभिन्न उपायों की तुलना अधिकांशतः इस आधार पर की जाती है कि डेटा के नमूने से संबंधित | क्योंकि मध्यिका समझने में आसान और गणना करने में आसान होती है, जबकि माध्य के लिए एक प्रबल सन्निकटन भी है, माध्यिका वर्णनात्मक संख्याओं में एक लोकप्रिय सारांश संख्या है। इस संदर्भ में, [[परिवर्तनशीलता (सांख्यिकी)]] के माप के लिए कई विकल्प है: श्रेणी (सांख्यिकी), अंतःचतुर्थक श्रेणी, माध्य निरपेक्ष विचलन, और माध्य निरपेक्ष विचलन। | ||

व्यावहारिक उद्देश्यों के लिए, स्थान और फैलाव के विभिन्न उपायों की तुलना अधिकांशतः इस आधार पर की जाती है कि डेटा के नमूने से संबंधित संख्या मूल्यों का कितना अच्छा अनुमान लगाया जा सकता है। माध्यिका, नमूना माध्यिका का उपयोग करके अनुमानित, इस संबंध में अच्छे गुण होते है। चूंकि यह सामान्यतः इष्टतम नहीं होता है यदि किसी दिए गए संख्या वितरण को मान लिया जाए, इसके गुण हमेशा यथोचित रूप से अच्छे होते है। उदाहरण के लिए, उम्मीदवार अनुमानकों की [[दक्षता (सांख्यिकी)]] की तुलना से पता चलता है कि नमूना माध्य अधिक सांख्यिकीय रूप से कुशल है कब—और केवल कब—डेटा वितरणों के मिश्रण से से असंदूषित है। फिर भी, माध्यिका में न्यूनतम-विचरण माध्य (बड़े सामान्य नमूनों के लिए) की तुलना में 64% दक्षता है, जिसका कहना है कि माध्यिका का प्रसरण माध्य के विचरण से ~50% अधिक होता है।<ref name="Williams 2001 165">{{cite book |last=Williams |first=D. |year=2001 |title=बाधाओं का वजन|url=https://archive.org/details/weighingoddscour00will_530 |url-access=limited |publisher=Cambridge University Press |isbn=052100618X |page=[https://archive.org/details/weighingoddscour00will_530/page/n184 165]}}</ref><ref>{{Cite book | last1=Maindonald|first1=John| url=https://books.google.com/books?id=8bMj8m-4RDQC&pg=PA104| title=Data Analysis and Graphics Using R: An Example-Based Approach| last2=Braun|first2=W. John |date=2010-05-06|publisher=Cambridge University Press|isbn=978-1-139-48667-5| pages=104|language=en}}</ref> | |||

== संभाव्यता वितरण == | == संभाव्यता वितरण == | ||

[[File:visualisation mode median mean.svg|thumb|100px|मोड का ज्यामितीय विज़ुअलाइज़ेशन, माध्यिका और मनमाना संभाव्यता घनत्व फ़ंक्शन का माध्य<ref>{{cite web|title=एपी सांख्यिकी समीक्षा - घनत्व वक्र और सामान्य वितरण| url=http://apstatsreview.tumblr.com/post/50058615236/density-curves-and-the-normal-distributions|access-date=16 March 2015| archive-url=https://web.archive.org/web/20150408230922/https://apstatsreview.tumblr.com/post/50058615236/density-curves-and-the-normal-distributions |archive-date=8 April 2015}}</ref>]]संचयी | [[File:visualisation mode median mean.svg|thumb|100px|मोड का ज्यामितीय विज़ुअलाइज़ेशन, माध्यिका और मनमाना संभाव्यता घनत्व फ़ंक्शन का माध्य<ref>{{cite web|title=एपी सांख्यिकी समीक्षा - घनत्व वक्र और सामान्य वितरण| url=http://apstatsreview.tumblr.com/post/50058615236/density-curves-and-the-normal-distributions|access-date=16 March 2015| archive-url=https://web.archive.org/web/20150408230922/https://apstatsreview.tumblr.com/post/50058615236/density-curves-and-the-normal-distributions |archive-date=8 April 2015}}</ref>]]संचयी वितरण फ़ंक्शन F के साथ किसी [[वास्तविक संख्या]]-मूल्यवान संभाव्यता वितरण के लिए, माध्यिका को किसी वास्तविक संख्या m के रूप में परिभाषित किया जाता है जो असमानताओं को संतुष्ट करता है | ||

<math display="block">\int_{(-\infty,m]} dF(x) \geq \frac{1}{2} \text{ and } \int_{[m,\infty)} dF(x) \geq \frac{1}{2}.</math> | <math display="block">\int_{(-\infty,m]} dF(x) \geq \frac{1}{2} \text{ and } \int_{[m,\infty)} dF(x) \geq \frac{1}{2}.</math> | ||

एक समतुल्य | एक समतुल्य सूत्र F के अनुसार वितरित एक यादृच्छिक चर X का उपयोग करता है: | ||

<math display="block">\operatorname{P}(X\leq m) \geq \frac{1}{2}\text{ and } \operatorname{P}(X\geq m) \geq \frac{1}{2}</math> | <math display="block">\operatorname{P}(X\leq m) \geq \frac{1}{2}\text{ and } \operatorname{P}(X\geq m) \geq \frac{1}{2}</math> | ||

ध्यान दें कि इस परिभाषा के लिए एक्स को एक [[पूर्ण निरंतरता]] की आवश्यकता नहीं है (जिसकी प्रायिकता घनत्व फ़ंक्शन f है), और न ही इसे [[असतत वितरण]] की आवश्यकता है। पूर्व स्थिति में, असमानताओं को समानता में अपग्रेड किया जा सकता है: एक माध्यिका संतुष्ट करती है | ध्यान दें कि इस परिभाषा के लिए एक्स को एक [[पूर्ण निरंतरता]] की आवश्यकता नहीं होती है (जिसकी प्रायिकता घनत्व फ़ंक्शन f है), और न ही इसे [[असतत वितरण]] की आवश्यकता होती है। पूर्व स्थिति में, असमानताओं को समानता में अपग्रेड किया जा सकता है: एक माध्यिका संतुष्ट करती है | ||

<math display="block">\operatorname{P}(X \leq m) = \int_{-\infty}^m{f(x)\, dx} = \frac{1}{2} = \int_m^{\infty}{f(x)\, dx} = \operatorname{P}(X\geq m).</math> | <math display="block">\operatorname{P}(X \leq m) = \int_{-\infty}^m{f(x)\, dx} = \frac{1}{2} = \int_m^{\infty}{f(x)\, dx} = \operatorname{P}(X\geq m).</math> | ||

आर पर किसी भी संभाव्यता वितरण में कम से कम एक माध्यिका होती है, लेकिन पैथोलॉजिकल स्थितियों में एक से अधिक माध्यिका हो सकती है: यदि 'एफ' एक अंतराल पर 1/2 स्थिर है (जिससे कि वहां ''एफ'' = 0 हो), तो उस अंतराल का कोई भी मान एक माध्यिका है। | आर पर किसी भी संभाव्यता वितरण में कम से कम एक माध्यिका होती है, लेकिन पैथोलॉजिकल स्थितियों में एक से अधिक माध्यिका हो सकती है: यदि 'एफ' एक अंतराल पर 1/2 स्थिर है (जिससे कि वहां ''एफ'' = 0 हो), तो उस अंतराल का कोई भी मान एक माध्यिका है। | ||

=== विशेष वितरण के माध्यम === | === विशेष वितरण के माध्यम === | ||

कुछ प्रकार के वितरणों के माध्यों की गणना उनके प्राचलों से आसानी से की जा सकती है | कुछ प्रकार के वितरणों के माध्यों की गणना उनके प्राचलों से आसानी से की जा सकती है, इसके अतिरिक्त, वे कुछ वितरणों के लिए भी उपस्थित है जिनमें एक अच्छी तरह से परिभाषित माध्य की कमी होती है, जैसे [[कॉची वितरण]]: | ||

* एक सममित | * एक सममित वितरण का माध्य बहुलक के साथ मेल खाता है। | ||

* एक [[सममित वितरण]] का माध्यिका जिसका माध्य μ होता है, वह भी μ मान लेता है। | * एक [[सममित वितरण]] का माध्यिका जिसका माध्य μ होता है, वह भी μ मान लेता है। | ||

** माध्य μ और प्रसरण σ के साथ एक [[सामान्य वितरण]] का माध्यिका | ** माध्य μ और प्रसरण σ<sup>2</sup> के साथ एक [[सामान्य वितरण]] का माध्यिका μ है। वास्तव में, एक सामान्य वितरण के लिए, माध्य = माध्यिका = बहुलक। | ||

** अंतराल [ए, बी] में एक [[समान वितरण (निरंतर)]] का माध्यिका (ए+बी) /2 है, जो माध्य भी है। | ** अंतराल [ए, बी] में एक [[समान वितरण (निरंतर)]] का माध्यिका (ए+बी) /2 है, जो माध्य भी है। | ||

* स्थान पैरामीटर x | * स्थान पैरामीटर x<sub>0</sub> के साथ कॉची वितरण की माध्यिका और स्केल पैरामीटर y x<sub>0</sub> है। | ||

* एक पावर लॉ x का माध्यिका<sup>−a</sup>, घातांक a के साथ > 1, 2 होता है<sup>1/(ए − 1)</sup>x<sub>min</sub>, जहां एक्स<sub>min</sub> न्यूनतम मूल्य है जिसके लिए शक्ति कानून धारण करता है<ref>[https://arxiv.org/abs/cond-mat/0412004 Newman, Mark EJ. "Power laws, Pareto distributions and Zipf's law." Contemporary physics 46.5 (2005): 323–351.]</ref> | * एक पावर लॉ x का माध्यिका<sup>−a</sup>, घातांक a के साथ > 1, 2 होता है<sup>1/(ए − 1)</sup>x<sub>min</sub>, जहां एक्स<sub>min</sub> न्यूनतम मूल्य है जिसके लिए शक्ति कानून धारण करता है<ref>[https://arxiv.org/abs/cond-mat/0412004 Newman, Mark EJ. "Power laws, Pareto distributions and Zipf's law." Contemporary physics 46.5 (2005): 323–351.]</ref> | ||

* [[दर पैरामीटर]] λ के साथ एक घातीय वितरण का माध्य 2 का प्राकृतिक लघुगणक दर पैरामीटर द्वारा विभाजित है: λ<sup>−1</sup>ln 2. | * [[दर पैरामीटर]] λ के साथ एक घातीय वितरण का माध्य 2 का प्राकृतिक लघुगणक दर पैरामीटर द्वारा विभाजित है: λ<sup>−1</sup>ln 2. | ||

| Line 118: | Line 119: | ||

: <math>\|\mu - m\| \leq \sqrt{ \operatorname{E}\left(\|X - \mu\|^2\right) } = \sqrt{ \operatorname{trace}\left(\operatorname{var}(X)\right) }</math> | : <math>\|\mu - m\| \leq \sqrt{ \operatorname{E}\left(\|X - \mu\|^2\right) } = \sqrt{ \operatorname{trace}\left(\operatorname{var}(X)\right) }</math> | ||

जहाँ m एक स्थानिक माध्यिका है, जो कि फ़ंक्शन का एक न्यूनतम है <math>a \mapsto \operatorname{E}(\|X-a\|).\,</math> स्थानिक माध्य अद्वितीय होता है जब डेटा-सेट का आयाम दो या अधिक होता है।<ref name="Kemperman">{{cite journal |first=Johannes H. B. |last=Kemperman |title=The median of a finite measure on a Banach space: Statistical data analysis based on the L1-norm and related methods |journal=Papers from the First International Conference Held at Neuchâtel, August 31–September 4, 1987 |editor-first=Yadolah |editor-last=Dodge |publisher=North-Holland Publishing Co. |location=Amsterdam |pages=217–230 |mr=949228 |year=1987 }}</ref><ref name="MilasevicDucharme">{{cite journal |first1=Philip |last1=Milasevic |first2=Gilles R. |last2=Ducharme |title=स्थानिक माध्यिका की विशिष्टता|journal=[[Annals of Statistics]] |volume=15 |year=1987 |number=3 |pages=1332–1333 |mr=902264 |doi=10.1214/aos/1176350511|doi-access=free }}</ref> | जहाँ m एक स्थानिक माध्यिका है, जो कि फ़ंक्शन का एक न्यूनतम है <math>a \mapsto \operatorname{E}(\|X-a\|).\,</math> स्थानिक माध्य अद्वितीय होता है जब डेटा-सेट का आयाम दो या अधिक होता है।<ref name="Kemperman">{{cite journal |first=Johannes H. B. |last=Kemperman |title=The median of a finite measure on a Banach space: Statistical data analysis based on the L1-norm and related methods |journal=Papers from the First International Conference Held at Neuchâtel, August 31–September 4, 1987 |editor-first=Yadolah |editor-last=Dodge |publisher=North-Holland Publishing Co. |location=Amsterdam |pages=217–230 |mr=949228 |year=1987 }}</ref><ref name="MilasevicDucharme">{{cite journal |first1=Philip |last1=Milasevic |first2=Gilles R. |last2=Ducharme |title=स्थानिक माध्यिका की विशिष्टता|journal=[[Annals of Statistics]] |volume=15 |year=1987 |number=3 |pages=1332–1333 |mr=902264 |doi=10.1214/aos/1176350511|doi-access=free }}</ref> | ||

एक वैकल्पिक प्रमाण एकतरफा चेबीशेव असमानता का उपयोग करता है | एक वैकल्पिक प्रमाण एकतरफा चेबीशेव असमानता का उपयोग करता है, यह स्थान और पैमाने के मापदंडों पर एक असमानता में प्रकट होता है # एक अनुप्रयोग - माध्य और माध्यिका के बीच की दूरी। यह सूत्र भी कैंटेली की असमानता से सीधे अनुसरण करता है।<ref>[http://www.montefiore.ulg.ac.be/~kvansteen/MATH0008-2/ac20112012/Class3/Chapter2_ac1112_vfinalPartII.pdf K.Van Steen ''Notes on probability and statistics'' ]</ref> | ||

==== यूनिमॉडल डिस्ट्रीब्यूशन ==== | ==== यूनिमॉडल डिस्ट्रीब्यूशन ==== | ||

[[एकरूपता]] वितरण के स्थिति में, माध्यिका और माध्य के बीच की दूरी पर एक तेज सीमा प्राप्त कर सकते है: | [[एकरूपता]] वितरण के स्थिति में, माध्यिका और माध्य के बीच की दूरी पर एक तेज सीमा प्राप्त कर सकते है: | ||

| Line 145: | Line 146: | ||

====नमूना माध्यिका की कुशल गणना ==== | ====नमूना माध्यिका की कुशल गणना ==== | ||

यदि [[छँटाई एल्गोरिथ्म]] | तुलना-सॉर्टिंग एन आइटम की आवश्यकता है {{math|[[Big O notation|Ω]](''n'' log ''n'')}} संचालन, चयन एल्गोरिदम ऑर्डर स्टेटिस्टिक की गणना कर सकते है{{mvar|k}}सबसे छोटा {{mvar|n}} आइटम केवल के साथ {{math|Θ(''n'')}} संचालन। इसमें माध्यिका सम्मलित है, जो कि है {{math|{{sfrac|''n''|2}}}}वें क्रम के आँकड़े (या सम संख्या के नमूनों के लिए, दो मध्य क्रम के संख्याओ का अंकगणितीय माध्य)।<ref>{{cite book | isbn=0-201-00029-6 | author=Alfred V. Aho and John E. Hopcroft and Jeffrey D. Ullman | title=कंप्यूटर एल्गोरिदम का डिजाइन और विश्लेषण| location=Reading/MA | publisher=Addison-Wesley | year=1974 | url-access=registration | url=https://archive.org/details/designanalysisof00ahoarich }} Here: Section 3.6 "Order Statistics", p.97-99, in particular Algorithm 3.6 and Theorem 3.9.</ref> | यदि [[छँटाई एल्गोरिथ्म]] | तुलना-सॉर्टिंग एन आइटम की आवश्यकता है {{math|[[Big O notation|Ω]](''n'' log ''n'')}} संचालन, चयन एल्गोरिदम ऑर्डर स्टेटिस्टिक की गणना कर सकते है{{mvar|k}}सबसे छोटा {{mvar|n}} आइटम केवल के साथ {{math|Θ(''n'')}} संचालन। इसमें माध्यिका सम्मलित है, जो कि है {{math|{{sfrac|''n''|2}}}}वें क्रम के आँकड़े (या सम संख्या के नमूनों के लिए, दो मध्य क्रम के संख्याओ का अंकगणितीय माध्य)।<ref>{{cite book | isbn=0-201-00029-6 | author=Alfred V. Aho and John E. Hopcroft and Jeffrey D. Ullman | title=कंप्यूटर एल्गोरिदम का डिजाइन और विश्लेषण| location=Reading/MA | publisher=Addison-Wesley | year=1974 | url-access=registration | url=https://archive.org/details/designanalysisof00ahoarich }} Here: Section 3.6 "Order Statistics", p.97-99, in particular Algorithm 3.6 and Theorem 3.9.</ref> | ||

चयन एल्गोरिदम में अभी भी आवश्यकता का नकारात्मक पहलू है {{math|Ω(''n'')}} मेमोरी, अर्थात, उन्हें स्मृति में पूर्ण नमूना (या इसका एक रैखिक आकार वाला भाग) रखने की आवश्यकता है। क्योंकि यह, साथ ही साथ रैखिक समय की आवश्यकता निषेधात्मक हो सकती है, माध्यिका के लिए कई आकलन प्रक्रियाएं विकसित की गई है। एक साधारण नियम तीन नियमों का माध्यिका है, जो माध्यिका को तीन-तत्व उपनमूने के माध्यिका के रूप में अनुमानित करता है | चयन एल्गोरिदम में अभी भी आवश्यकता का नकारात्मक पहलू है {{math|Ω(''n'')}} मेमोरी, अर्थात, उन्हें स्मृति में पूर्ण नमूना (या इसका एक रैखिक आकार वाला भाग) रखने की आवश्यकता है। क्योंकि यह, साथ ही साथ रैखिक समय की आवश्यकता निषेधात्मक हो सकती है, माध्यिका के लिए कई आकलन प्रक्रियाएं विकसित की गई है। एक साधारण नियम तीन नियमों का माध्यिका है, जो माध्यिका को तीन-तत्व उपनमूने के माध्यिका के रूप में अनुमानित करता है, यह सामान्यतः [[जल्दी से सुलझाएं]] सॉर्टिंग एल्गोरिदम में सबरूटीन के रूप में उपयोग किया जाता है, जो इसके इनपुट के माध्यिका के अनुमान का उपयोग करता है। एक अधिक [[मजबूत अनुमानक|प्रबल अनुमानक]] [[जॉन टुकी]] का नौवां है, जो सीमित पुनरावर्तन के साथ लागू तीन नियमों का माध्यिका है:<ref>{{cite journal |first1=Jon L. |last1=Bentley |first2=M. Douglas |last2=McIlroy |title=इंजीनियरिंग एक तरह का कार्य|journal=Software: Practice and Experience |volume=23 |issue=11 |pages=1249–1265 |year=1993 |url=http://citeseer.ist.psu.edu/viewdoc/summary?doi=10.1.1.14.8162 |doi=10.1002/spe.4380231105|s2cid=8822797 }}</ref> यदि {{mvar|A}} एक [[सरणी (डेटा संरचना)]] के रूप में रखा गया नमूना है, और | ||

:{{math|med3(''A'') {{=}} median(''A''[1], ''A''[{{sfrac|''n''|2}}], ''A''[''n''])}}, | :{{math|med3(''A'') {{=}} median(''A''[1], ''A''[{{sfrac|''n''|2}}], ''A''[''n''])}}, | ||

| Line 168: | Line 169: | ||

| doi = 10.1093/biomet/60.3.439 | | doi = 10.1093/biomet/60.3.439 | ||

| mr = 0326872 | jstor = 2334992 | | mr = 0326872 | jstor = 2334992 | ||

}}</ref> घनत्व फ़ंक्शन वाली | }}</ref> घनत्व फ़ंक्शन वाली संख्या से नमूना माध्यिका का वितरण <math>f(x)</math> माध्य के साथ असम्बद्ध रूप से सामान्य है <math>\mu</math> और विचरण<ref name="Rider1960">{{cite journal |last=Rider |first=Paul R. |year=1960 |title=कई विशेष आबादी से छोटे नमूनों की माध्यिका का प्रसरण|journal=[[Journal of the American Statistical Association|J. Amer. Statist. Assoc.]] |volume=55 |issue=289 |pages=148–150 |doi=10.1080/01621459.1960.10482056 }}</ref> | ||

: <math> \frac{ 1 }{ 4n f( m )^2 }</math> | : <math> \frac{ 1 }{ 4n f( m )^2 }</math> | ||

कहाँ <math>m</math> की माध्यिका है <math>f(x)</math> और <math>n</math> नमूना आकार है। एक आधुनिक प्रमाण नीचे दिया गया है। लाप्लास के परिणाम को अब क्वांटाइल के एक विशेष स्थिति के रूप में समझा जाता है # एक नमूने से क्वांटाइल का अनुमान लगाना। | कहाँ <math>m</math> की माध्यिका है <math>f(x)</math> और <math>n</math> नमूना आकार है। एक आधुनिक प्रमाण नीचे दिया गया है। लाप्लास के परिणाम को अब क्वांटाइल के एक विशेष स्थिति के रूप में समझा जाता है # एक नमूने से क्वांटाइल का अनुमान लगाना। | ||

| Line 175: | Line 176: | ||

===== स्पर्शोन्मुख वितरण की व्युत्पत्ति ===== | ===== स्पर्शोन्मुख वितरण की व्युत्पत्ति ===== | ||

हम नमूना आकार को एक विषम संख्या के रूप में लेते है <math> N = 2n + 1 </math> और हमारे चर को निरंतर मानें | हम नमूना आकार को एक विषम संख्या के रूप में लेते है <math> N = 2n + 1 </math> और हमारे चर को निरंतर मानें, असतत चर के स्थिति का सूत्र नीचे दिया गया है {{slink||Empirical local density}}. नमूने को माध्यिका के नीचे, माध्यिका पर और माध्यिका से ऊपर के रूप में संक्षेपित किया जा सकता है, जो संभावनाओं के साथ त्रिनोमियल वितरण से मेल खाता है <math> F(v) </math>, <math> f(v) </math> और <math> 1 - F(v) </math>. एक सतत चर के लिए, कई नमूना मानों की औसत के बराबर बराबर होने की संभावना 0 है, इसलिए कोई बिंदु पर घनत्व की गणना कर सकता है <math> v </math> सीधे ट्रिनोमियल वितरण से: | ||

: <math> \Pr[\operatorname{Median}=v]\,dv=\frac{(2n+1)!}{n!n!} F(v)^n(1 - F(v))^nf(v)\, dv</math>. | : <math> \Pr[\operatorname{Median}=v]\,dv=\frac{(2n+1)!}{n!n!} F(v)^n(1 - F(v))^nf(v)\, dv</math>. | ||

| Line 201: | Line 202: | ||

|- | |- | ||

|} | |} | ||

क्योंकि अवलोकन असतत-मूल्यवान है, माध्यिका के त्रुटिहीन वितरण का निर्माण उपरोक्त अभिव्यक्ति का तत्काल अनुवाद नहीं है <math> \Pr(\operatorname{Median} = v) </math> | क्योंकि अवलोकन असतत-मूल्यवान है, माध्यिका के त्रुटिहीन वितरण का निर्माण उपरोक्त अभिव्यक्ति का तत्काल अनुवाद नहीं है <math> \Pr(\operatorname{Median} = v) </math>, किसी के नमूने में माध्यिका के कई उदाहरण हो सकते है (और सामान्यतः होते है)। इसलिए हमें इन सभी संभावनाओं का योग करना चाहिए: | ||

: <math> \Pr(\operatorname{Median} = v) = \sum_{i=0}^n \sum_{k=0}^n \frac{N!}{i!(N-i-k)!k!} F(v-1)^i(1 - F(v))^kf(v)^{N-i-k} </math> | : <math> \Pr(\operatorname{Median} = v) = \sum_{i=0}^n \sum_{k=0}^n \frac{N!}{i!(N-i-k)!k!} F(v-1)^i(1 - F(v))^kf(v)^{N-i-k} </math> | ||

| Line 227: | Line 228: | ||

==== नमूना डेटा से भिन्नता का अनुमान ==== | ==== नमूना डेटा से भिन्नता का अनुमान ==== | ||

का मान है <math>(2 f(x))^{-2}</math>- का विषम मूल्य <math>n^{-1/2} (\nu - m)</math> कहाँ <math>\nu</math> | का मान है <math>(2 f(x))^{-2}</math>- का विषम मूल्य <math>n^{-1/2} (\nu - m)</math> कहाँ <math>\nu</math> संख्या औसत है-कई लेखकों द्वारा अध्ययन किया गया है। मानक डिलीट वन रीसैंपलिंग (सांख्यिकी) #Jackknife विधि [[लगातार अनुमानक]] परिणाम उत्पन्न करती है।<ref name=Efron1982>{{cite book |last=Efron |first=B. |year=1982 |title=द जैकनाइफ, द बूटस्ट्रैप और अन्य रीसैंपलिंग योजनाएं|publisher=SIAM |location=Philadelphia |isbn=0898711797 }}</ref> एक विकल्प—डिलीट k विधि—जहाँ <math>k</math> नमूना आकार के साथ बढ़ता है विषम रूप से सुसंगत दिखाया गया है।<ref name=Shao1989>{{cite journal |last1=Shao |first1=J. |last2=Wu |first2=C. F. |year=1989 |title=जैकनाइफ भिन्नता अनुमान के लिए एक सामान्य सिद्धांत|journal=[[Annals of Statistics|Ann. Stat.]] |volume=17 |issue=3 |pages=1176–1197 |jstor=2241717 |doi=10.1214/aos/1176347263|doi-access=free }}</ref> बड़े डेटा सेट के लिए यह विधि कम्प्यूटेशनल रूप से महंगी हो सकती है। बूटस्ट्रैप अनुमान सुसंगत होने के लिए जाना जाता है,<ref name=Efron1979>{{cite journal |last=Efron |first=B. |year=1979 |title=Bootstrap Methods: Another Look at the Jackknife |journal=[[Annals of Statistics|Ann. Stat.]] |volume=7 |issue=1 |pages=1–26 |jstor=2958830 |doi=10.1214/aos/1176344552|doi-access=free }}</ref> लेकिन बहुत धीरे-धीरे अभिसरण करता है ([[कम्प्यूटेशनल जटिलता सिद्धांत]] <math>n^{-\frac{1}{4}}</math>).<ref name=Hall1988>{{cite journal |last1=Hall |first1=P. |last2=Martin |first2=M. A. |s2cid=119701556 |year=1988 |title=बूटस्ट्रैप क्वांटाइल वेरिएंस एस्टीमेटर की सटीक अभिसरण दर|journal=Probab Theory Related Fields |volume=80 |issue=2 |pages=261–268 |doi=10.1007/BF00356105 }}</ref> अन्य तरीके प्रस्तावित किए गए है लेकिन उनका व्यवहार बड़े और छोटे नमूनों के बीच भिन्न हो सकता है।<ref name=Jimenez-Gamero2004>{{cite journal |last1=Jiménez-Gamero |first1=M. D. |last2=Munoz-García |first2=J. |first3=R. |last3=Pino-Mejías |year=2004 |title=माध्यिका के लिए कम बूटस्ट्रैप|journal=Statistica Sinica |volume=14 |issue=4 |pages=1179–1198 |url=http://www3.stat.sinica.edu.tw/statistica/password.asp?vol=14&num=4&art=11 }}</ref> | ||

==== दक्षता==== | ==== दक्षता==== | ||

नमूना माध्यिका की दक्षता (आँकड़े), माध्यिका के विचरण के माध्य के विचरण के अनुपात के रूप में मापी जाती है, नमूना आकार और अंतर्निहित | नमूना माध्यिका की दक्षता (आँकड़े), माध्यिका के विचरण के माध्य के विचरण के अनुपात के रूप में मापी जाती है, नमूना आकार और अंतर्निहित संख्या वितरण पर निर्भर करती है। आकार के नमूने के लिए <math>N = 2n + 1</math> सामान्य वितरण से, बड़े एन के लिए दक्षता है | ||

: <math> \frac{2}{\pi} \frac{N+2}{N} </math> | : <math> \frac{2}{\pi} \frac{N+2}{N} </math> | ||

| Line 237: | Line 238: | ||

दूसरे शब्दों में, माध्यिका का आपेक्षिक प्रसरण होगा <math>\pi/2 \approx 1.57</math>, या माध्य के विचरण से 57% अधिक - माध्यिका की सापेक्ष [[मानक त्रुटि]] होगी <math>(\pi/2)^\frac{1}{2} \approx 1.25</math>, या [[माध्य की मानक त्रुटि]] से 25% अधिक, <math>\sigma/\sqrt{n}</math> (ऊपर अनुभाग #नमूना वितरण भी देखें।)<ref>{{Cite book | url=https://books.google.com/books?id=8bMj8m-4RDQC&q=standard%20error%20of%20the%20median&pg=PA104 |title = Data Analysis and Graphics Using R: An Example-Based Approach|isbn = 9781139486675|last1 = Maindonald|first1 = John|last2 = John Braun|first2 = W.|date = 2010-05-06}}</ref> | दूसरे शब्दों में, माध्यिका का आपेक्षिक प्रसरण होगा <math>\pi/2 \approx 1.57</math>, या माध्य के विचरण से 57% अधिक - माध्यिका की सापेक्ष [[मानक त्रुटि]] होगी <math>(\pi/2)^\frac{1}{2} \approx 1.25</math>, या [[माध्य की मानक त्रुटि]] से 25% अधिक, <math>\sigma/\sqrt{n}</math> (ऊपर अनुभाग #नमूना वितरण भी देखें।)<ref>{{Cite book | url=https://books.google.com/books?id=8bMj8m-4RDQC&q=standard%20error%20of%20the%20median&pg=PA104 |title = Data Analysis and Graphics Using R: An Example-Based Approach|isbn = 9781139486675|last1 = Maindonald|first1 = John|last2 = John Braun|first2 = W.|date = 2010-05-06}}</ref> | ||

=== अन्य अनुमानक === | === अन्य अनुमानक === | ||

अविभाजित वितरणों के लिए जो एक माध्यिका के बारे में सममित है, हॉजेस-लेहमन अनुमानक एक प्रबल आँकड़े और | अविभाजित वितरणों के लिए जो एक माध्यिका के बारे में सममित है, हॉजेस-लेहमन अनुमानक एक प्रबल आँकड़े और संख्या माध्यिका की अत्यधिक दक्षता (आँकड़े) है।<ref name="HM">{{cite book |last1=Hettmansperger |first1=Thomas P. |last2=McKean |first2=Joseph W. |title=मजबूत गैर पैरामीट्रिक सांख्यिकीय तरीके|series=Kendall's Library of Statistics |volume=5 |publisher=Edward Arnold |location=London |year=1998 |isbn=0-340-54937-8 |mr=1604954 }}</ref> | ||

यदि डेटा एक [[सांख्यिकीय मॉडल]] द्वारा प्रतिनिधित्व किया जाता है जो संभाव्यता वितरण के एक विशेष परिवार को निर्दिष्ट करता है, तो माध्यिका का अनुमान उस संभाव्यता वितरण के परिवार को डेटा में फिट करके और फिट किए गए वितरण के सैद्धांतिक माध्य की गणना करके प्राप्त किया जा सकता है। पेरेटो प्रक्षेप इसका एक अनुप्रयोग है जब | यदि डेटा एक [[सांख्यिकीय मॉडल]] द्वारा प्रतिनिधित्व किया जाता है जो संभाव्यता वितरण के एक विशेष परिवार को निर्दिष्ट करता है, तो माध्यिका का अनुमान उस संभाव्यता वितरण के परिवार को डेटा में फिट करके और फिट किए गए वितरण के सैद्धांतिक माध्य की गणना करके प्राप्त किया जा सकता है। पेरेटो प्रक्षेप इसका एक अनुप्रयोग है जब संख्या को पारेटो वितरण माना जाता है। | ||

== बहुभिन्नरूपी माध्यिका == | == बहुभिन्नरूपी माध्यिका == | ||

इससे पहले, इस लेख में अविभाजित माध्यिका पर चर्चा की गई थी, जब नमूना या | इससे पहले, इस लेख में अविभाजित माध्यिका पर चर्चा की गई थी, जब नमूना या संख्या का एक-आयाम था। जब आयाम दो या उच्चतर होता है, तो ऐसी कई अवधारणाएँ होती है जो एकविभाजित माध्यिका की परिभाषा का विस्तार करती है, इस तरह के प्रत्येक बहुभिन्नरूपी माध्यिका एकात्मक माध्यिका से सहमत होती है जब आयाम बिल्कुल एक होता है।<ref name="HM" /><ref>Small, Christopher G. "A survey of multidimensional medians." International Statistical Review/Revue Internationale de Statistique (1990): 263–277. {{doi|10.2307/1403809}} {{JSTOR|1403809}}</ref><ref>Niinimaa, A., and H. Oja. "Multivariate median." Encyclopedia of statistical sciences (1999).</ref><ref>Mosler, Karl. Multivariate Dispersion, Central Regions, and Depth: The Lift Zonoid Approach. Vol. 165. Springer Science & Business Media, 2012.</ref> | ||

=== सीमांत माध्यिका === | === सीमांत माध्यिका === | ||

निर्देशांक के एक निश्चित सेट के संबंध में परिभाषित वैक्टर के लिए सीमांत माध्य परिभाषित किया गया है। एक सीमांत माध्यिका को सदिश के रूप में परिभाषित किया जाता है, जिसके घटक अविभाजित माध्यिकाएँ है। सीमांत मध्यिका की गणना करना आसान है, और इसके गुणों का अध्ययन पुरी और सेन द्वारा किया गया था।<ref name="HM" /><ref>Puri, Madan L.; Sen, Pranab K.; ''Nonparametric Methods in Multivariate Analysis'', John Wiley & Sons, New York, NY, 1971. (Reprinted by Krieger Publishing)</ref> | निर्देशांक के एक निश्चित सेट के संबंध में परिभाषित वैक्टर के लिए सीमांत माध्य परिभाषित किया गया है। एक सीमांत माध्यिका को सदिश के रूप में परिभाषित किया जाता है, जिसके घटक अविभाजित माध्यिकाएँ है। सीमांत मध्यिका की गणना करना आसान है, और इसके गुणों का अध्ययन पुरी और सेन द्वारा किया गया था।<ref name="HM" /><ref>Puri, Madan L.; Sen, Pranab K.; ''Nonparametric Methods in Multivariate Analysis'', John Wiley & Sons, New York, NY, 1971. (Reprinted by Krieger Publishing)</ref> | ||

| Line 283: | Line 284: | ||

=== छद्म-माध्यिका === | === छद्म-माध्यिका === | ||

{{Main|स्यूडोमेडियन}} | {{Main|स्यूडोमेडियन}} | ||

अविभाजित वितरणों के लिए जो एक माध्यिका के बारे में सममित है, हॉजेस-लेहमन अनुमानक | अविभाजित वितरणों के लिए जो एक माध्यिका के बारे में सममित है, हॉजेस-लेहमन अनुमानक संख्या मध्यिका का एक प्रबल और अत्यधिक कुशल अनुमानक है, गैर-सममित वितरण के लिए, हॉजेस-लेहमन अनुमानक संख्या छद्म-माध्यिका का एक प्रबल और अत्यधिक कुशल अनुमानक है, जो एक सममित वितरण का माध्यिका है और जो संख्या मध्यिका के करीब है।<ref>{{Cite journal|last1=Pratt|first1=William K.|last2=Cooper|first2=Ted J.|last3=Kabir|first3=Ihtisham|s2cid=173183609|editor1-first=Francis J|editor1-last=Corbett|date=1985-07-11|title=स्यूडोमेडियन फ़िल्टर|journal=Architectures and Algorithms for Digital Image Processing II|volume=0534|pages=34|doi=10.1117/12.946562|bibcode=1985SPIE..534...34P}}</ref> हॉजेस-लेहमन अनुमानक को बहुभिन्नरूपी वितरणों के लिए सामान्यीकृत किया गया है।<ref name="Oja 2010 xiv+232">{{cite book|title=Multivariate nonparametric methods with ''R'': An approach based on spatial signs and ranks|last=Oja|first=Hannu|publisher=Springer|year=2010|isbn=978-1-4419-0467-6|series=Lecture Notes in Statistics|volume=199|location=New York, NY|pages=xiv+232|doi=10.1007/978-1-4419-0468-3|mr=2598854}}</ref> | ||

=== प्रतिगमन के वेरिएंट === | === प्रतिगमन के वेरिएंट === | ||

थिल-सेन अनुमानक [[ढलान]]ों के माध्यिका खोजने के आधार पर प्रबल सांख्यिकी [[रेखीय प्रतिगमन]] के लिए एक विधि है।<ref>{{citation | थिल-सेन अनुमानक [[ढलान]]ों के माध्यिका खोजने के आधार पर प्रबल सांख्यिकी [[रेखीय प्रतिगमन]] के लिए एक विधि है।<ref>{{citation | ||

| Line 308: | Line 309: | ||

== माध्य-निष्पक्ष अनुमानक == | == माध्य-निष्पक्ष अनुमानक == | ||

{{main|एक अनुमानक का पूर्वाग्रह#माध्य-निष्पक्ष अनुमानक}} | {{main|एक अनुमानक का पूर्वाग्रह#माध्य-निष्पक्ष अनुमानक}} | ||

औसत-निष्पक्ष आकलनकर्ता का कोई भी पूर्वाग्रह चुकता-त्रुटि हानि फ़ंक्शन के संबंध में [[जोखिम]] ([[अपेक्षित हानि]]) को कम करता है, जैसा कि [[गॉस]] द्वारा देखा गया है। ए एस्टिमेटर का पूर्वाग्रह # माध्य निष्पक्ष अनुमानक, और अन्य [[हानि कार्य]]ों के संबंध में पूर्वाग्रह | मध्य-निष्पक्ष अनुमानक पूर्ण विचलन के संबंध में जोखिम को कम करता है। पूर्ण-विचलन हानि फ़ंक्शन, जैसा कि [[लाप्लास]] द्वारा देखा गया है। अन्य नुकसान कार्यों का उपयोग [[सांख्यिकीय सिद्धांत]] में किया जाता है, विशेष रूप से प्रबल | औसत-निष्पक्ष आकलनकर्ता का कोई भी पूर्वाग्रह चुकता-त्रुटि हानि फ़ंक्शन के संबंध में [[जोखिम]] ([[अपेक्षित हानि]]) को कम करता है, जैसा कि [[गॉस]] द्वारा देखा गया है। ए एस्टिमेटर का पूर्वाग्रह # माध्य निष्पक्ष अनुमानक, और अन्य [[हानि कार्य]]ों के संबंध में पूर्वाग्रह | मध्य-निष्पक्ष अनुमानक पूर्ण विचलन के संबंध में जोखिम को कम करता है। पूर्ण-विचलन हानि फ़ंक्शन, जैसा कि [[लाप्लास]] द्वारा देखा गया है। अन्य नुकसान कार्यों का उपयोग [[सांख्यिकीय सिद्धांत]] में किया जाता है, विशेष रूप से प्रबल संख्याओं में। | ||

1947 में [https://web.archive.org/web/20110310043642/http://www.universityofcalifornia.edu/senate/inmemoriam/georgewbrown.htm जॉर्ज डब्ल्यू. ब्राउन] द्वारा मध्य-निष्पक्ष आकलनकर्ताओं के सिद्धांत को पुनर्जीवित किया गया:<ref name="Brown" /> | 1947 में [https://web.archive.org/web/20110310043642/http://www.universityofcalifornia.edu/senate/inmemoriam/georgewbrown.htm जॉर्ज डब्ल्यू. ब्राउन] द्वारा मध्य-निष्पक्ष आकलनकर्ताओं के सिद्धांत को पुनर्जीवित किया गया:<ref name="Brown" /> | ||

| Line 318: | Line 319: | ||

मध्य-निष्पक्ष आकलनकर्ताओं के निर्माण के तरीके है जो इष्टतम है (माध्य-निष्पक्ष अनुमानकों के लिए न्यूनतम-विचरण संपत्ति के समान अर्थ में)। [[मोनोटोन संभावना अनुपात]] वाले संभाव्यता वितरण के लिए इस तरह के निर्माण उपस्थित है। मोनोटोन संभावना-कार्य।<ref>Pfanzagl, Johann. "On optimal median unbiased estimators in the presence of nuisance parameters." The Annals of Statistics (1979): 187–193.</ref><ref>{{cite journal | last1 = Brown | first1 = L. D. | last2 = Cohen | first2 = Arthur | last3 = Strawderman | first3 = W. E. | year = 1976 | title = अनुप्रयोगों के साथ सख्त मोनोटोन संभावना अनुपात के लिए एक पूर्ण वर्ग प्रमेय| url = http://projecteuclid.org/euclid.aos/1176343543 | journal = Ann. Statist. | volume = 4 | issue = 4| pages = 712–722 | doi = 10.1214/aos/1176343543 | doi-access = free }}</ref> ऐसी ही एक प्रक्रिया राव-ब्लैकवेल प्रमेय का एक एनालॉग है। माध्य-निष्पक्ष आकलनकर्ताओं के लिए राव-ब्लैकवेल प्रक्रिया: यह प्रक्रिया राव-ब्लैकवेल प्रक्रिया की तुलना में संभाव्यता वितरण के एक छोटे वर्ग के लिए है, लेकिन हानि कार्यों के एक बड़े वर्ग के लिए है।<ref>{{cite journal | last1 = Page | last2 = Brown | first2 = L. D. | last3 = Cohen | first3 = Arthur | last4 = Strawderman | first4 = W. E. | year = 1976 | title = अनुप्रयोगों के साथ सख्त मोनोटोन संभावना अनुपात के लिए एक पूर्ण वर्ग प्रमेय| url = http://projecteuclid.org/euclid.aos/1176343543 | journal = Ann. Statist. | volume = 4 | issue = 4| pages = 712–722 | doi = 10.1214/aos/1176343543 | doi-access = free }}</ref> | मध्य-निष्पक्ष आकलनकर्ताओं के निर्माण के तरीके है जो इष्टतम है (माध्य-निष्पक्ष अनुमानकों के लिए न्यूनतम-विचरण संपत्ति के समान अर्थ में)। [[मोनोटोन संभावना अनुपात]] वाले संभाव्यता वितरण के लिए इस तरह के निर्माण उपस्थित है। मोनोटोन संभावना-कार्य।<ref>Pfanzagl, Johann. "On optimal median unbiased estimators in the presence of nuisance parameters." The Annals of Statistics (1979): 187–193.</ref><ref>{{cite journal | last1 = Brown | first1 = L. D. | last2 = Cohen | first2 = Arthur | last3 = Strawderman | first3 = W. E. | year = 1976 | title = अनुप्रयोगों के साथ सख्त मोनोटोन संभावना अनुपात के लिए एक पूर्ण वर्ग प्रमेय| url = http://projecteuclid.org/euclid.aos/1176343543 | journal = Ann. Statist. | volume = 4 | issue = 4| pages = 712–722 | doi = 10.1214/aos/1176343543 | doi-access = free }}</ref> ऐसी ही एक प्रक्रिया राव-ब्लैकवेल प्रमेय का एक एनालॉग है। माध्य-निष्पक्ष आकलनकर्ताओं के लिए राव-ब्लैकवेल प्रक्रिया: यह प्रक्रिया राव-ब्लैकवेल प्रक्रिया की तुलना में संभाव्यता वितरण के एक छोटे वर्ग के लिए है, लेकिन हानि कार्यों के एक बड़े वर्ग के लिए है।<ref>{{cite journal | last1 = Page | last2 = Brown | first2 = L. D. | last3 = Cohen | first3 = Arthur | last4 = Strawderman | first4 = W. E. | year = 1976 | title = अनुप्रयोगों के साथ सख्त मोनोटोन संभावना अनुपात के लिए एक पूर्ण वर्ग प्रमेय| url = http://projecteuclid.org/euclid.aos/1176343543 | journal = Ann. Statist. | volume = 4 | issue = 4| pages = 712–722 | doi = 10.1214/aos/1176343543 | doi-access = free }}</ref> | ||

== इतिहास == | == इतिहास == | ||

प्राचीन निकट पूर्व में वैज्ञानिक शोधकर्ताओं ने सारांश | प्राचीन निकट पूर्व में वैज्ञानिक शोधकर्ताओं ने सारांश संख्याओं का पूरी तरह से उपयोग नहीं किया है, इसके अतिरिक्त उन मूल्यों का चयन किया है जो एक व्यापक सिद्धांत के साथ अधिकतम स्थिरता प्रदान करते है जो विभिन्न प्रकार की घटनाओं को एकीकृत करता है।<ref name=":0">{{Cite journal|last1=Bakker|first1=Arthur|last2=Gravemeijer|first2=Koeno P. E.|s2cid=143708116|date=2006-06-01|title=मीन और मेडियन की एक ऐतिहासिक घटना|journal=Educational Studies in Mathematics|language=en|volume=62|issue=2|pages=149–168|doi=10.1007/s10649-006-7099-8|issn=1573-0816}}</ref> भूमध्यसागरीय (और, बाद में, यूरोपीय) विद्वानों के समुदाय के भीतर, माध्य जैसे आँकड़े मौलिक रूप से मध्ययुगीन और प्रारंभिक आधुनिक विकास है। (यूरोप के बाहर माध्यिका का इतिहास और इसके पूर्ववर्तियों का अपेक्षाकृत अध्ययन नहीं किया गया है।) | ||

भिन्न [[आर्थिक मूल्यांकन]] का निष्पक्ष विश्लेषण करने के लिए माध्यिका का विचार 6वीं शताब्दी में [[तल्मूड]] में प्रकट हुआ।<ref>{{Cite web|url=http://danadler.com/blog/2014/12/31/talmud-and-modern-economics/|title=तल्मूड और आधुनिक अर्थशास्त्र|last=Adler|first=Dan|date=31 December 2014|website=Jewish American and Israeli Issues|url-status=dead|archive-url=https://web.archive.org/web/20151206134315/http://danadler.com/blog/2014/12/31/talmud-and-modern-economics/|archive-date=6 December 2015|access-date=22 February 2020}}</ref><ref>[http://www.wisdom.weizmann.ac.il/math/AABeyond12/presentations/Aumann.pdf Modern Economic Theory in the Talmud] by [[Yisrael Aumann]]</ref> चूँकि, यह अवधारणा व्यापक वैज्ञानिक समुदाय में नहीं फैली। | भिन्न [[आर्थिक मूल्यांकन]] का निष्पक्ष विश्लेषण करने के लिए माध्यिका का विचार 6वीं शताब्दी में [[तल्मूड]] में प्रकट हुआ।<ref>{{Cite web|url=http://danadler.com/blog/2014/12/31/talmud-and-modern-economics/|title=तल्मूड और आधुनिक अर्थशास्त्र|last=Adler|first=Dan|date=31 December 2014|website=Jewish American and Israeli Issues|url-status=dead|archive-url=https://web.archive.org/web/20151206134315/http://danadler.com/blog/2014/12/31/talmud-and-modern-economics/|archive-date=6 December 2015|access-date=22 February 2020}}</ref><ref>[http://www.wisdom.weizmann.ac.il/math/AABeyond12/presentations/Aumann.pdf Modern Economic Theory in the Talmud] by [[Yisrael Aumann]]</ref> चूँकि, यह अवधारणा व्यापक वैज्ञानिक समुदाय में नहीं फैली। | ||

इसके अतिरिक्त, आधुनिक माध्यिका का निकटतम पूर्वज अल-बिरूनी द्वारा आविष्कृत मध्य-श्रेणी है।<ref name="Eisenhart">{{Cite speech|last=Eisenhart|first=Churchill|author-link=Churchill Eisenhart|event=131st Annual Meeting of the American Statistical Association|location=Colorado State University|date=24 August 1971|url=https://www.stat.uchicago.edu/~stigler/eisenhart.pdf|title=प्राचीन काल से आज तक मापन के एक सेट के सर्वोत्तम माध्य की अवधारणा का विकास|format=PDF}}</ref>{{Rp|31}}<ref name=":2">{{Cite web|url=http://priceonomics.com/how-the-average-triumphed-over-the-median/|title=माध्यिका पर औसत की विजय कैसे हुई|website=Priceonomics|date=5 April 2016|language=en|access-date=2020-02-23}}</ref> बाद के विद्वानों के लिए अल-बिरूनी के कार्य का प्रसारण अस्पष्ट है। अल-बिरूनी ने अपनी तकनीक को धातुओं की जांच के लिए लागू किया, लेकिन, उनके काम को प्रकाशित करने के बाद, अधिकांश [[परख]]ने वालों ने अभी भी अपने परिणामों से सबसे प्रतिकूल मूल्य को अपनाया, ऐसा न हो कि वे [[ मानमर्दन |मानमर्दन]] दिखाई दें।<ref name="Eisenhart" />{{Rp|35–8}} चूंकि, डिस्कवरी के युग के दौरान समुद्र में नेविगेशन में वृद्धि का मतलब था कि जहाज के नेविगेटर को तेजी से शत्रुतापूर्ण तटों के विरुद्ध प्रतिकूल मौसम में अक्षांश का निर्धारण करने का प्रयास करना पड़ा, जिससे सारांश | इसके अतिरिक्त, आधुनिक माध्यिका का निकटतम पूर्वज अल-बिरूनी द्वारा आविष्कृत मध्य-श्रेणी है।<ref name="Eisenhart">{{Cite speech|last=Eisenhart|first=Churchill|author-link=Churchill Eisenhart|event=131st Annual Meeting of the American Statistical Association|location=Colorado State University|date=24 August 1971|url=https://www.stat.uchicago.edu/~stigler/eisenhart.pdf|title=प्राचीन काल से आज तक मापन के एक सेट के सर्वोत्तम माध्य की अवधारणा का विकास|format=PDF}}</ref>{{Rp|31}}<ref name=":2">{{Cite web|url=http://priceonomics.com/how-the-average-triumphed-over-the-median/|title=माध्यिका पर औसत की विजय कैसे हुई|website=Priceonomics|date=5 April 2016|language=en|access-date=2020-02-23}}</ref> बाद के विद्वानों के लिए अल-बिरूनी के कार्य का प्रसारण अस्पष्ट है। अल-बिरूनी ने अपनी तकनीक को धातुओं की जांच के लिए लागू किया, लेकिन, उनके काम को प्रकाशित करने के बाद, अधिकांश [[परख]]ने वालों ने अभी भी अपने परिणामों से सबसे प्रतिकूल मूल्य को अपनाया, ऐसा न हो कि वे [[ मानमर्दन |मानमर्दन]] दिखाई दें।<ref name="Eisenhart" />{{Rp|35–8}} चूंकि, डिस्कवरी के युग के दौरान समुद्र में नेविगेशन में वृद्धि का मतलब था कि जहाज के नेविगेटर को तेजी से शत्रुतापूर्ण तटों के विरुद्ध प्रतिकूल मौसम में अक्षांश का निर्धारण करने का प्रयास करना पड़ा, जिससे सारांश संख्याओं में नए सिरे से रुचि उत्पन्न हुई। चाहे फिर से खोजा गया हो या स्वतंत्र रूप से आविष्कार किया गया हो, हैरियट के निर्देशों में रैले की यात्रा के लिए गुयाना, 1595 में समुद्री नाविकों के लिए मध्य-श्रेणी की सिफारिश की गई है।<ref name="Eisenhart" />{{Rp|45–8}} | ||

माध्यिका का विचार सबसे पहले [[एडवर्ड राइट (गणितज्ञ)]] की 1599 की पुस्तक सर्टेनी एरर्स इन नेविगेशन में कम्पास नेविगेशन के बारे में एक खंड पर प्रकट हुआ होगा। राइट मापा मूल्यों को छोड़ने के लिए अनिच्छुक था, और यह महसूस किया हो सकता है कि मध्य-श्रेणी की तुलना में डेटासेट के अधिक अनुपात को सम्मलित करने वाले माध्यिका के सही होने की अधिक संभावना थी। चूंकि, राइट ने अपनी तकनीक के उपयोग का उदाहरण नहीं दिया, जिससे यह सत्यापित करना कठिन हो गया कि उन्होंने माध्यिका की आधुनिक धारणा का वर्णन किया है।<ref name=":0" /><ref name=":2" />{{Efn|Subsequent scholars appear to concur with Eisenhart that Boroughs' 1580 figures, while suggestive of the median, in fact describe an arithmetic mean.;<ref name="Eisenhart" />{{rp|62–3}} Boroughs is mentioned in no other work.}} माध्यिका (संभाव्यता के संदर्भ में) निश्चित रूप से क्रिस्टियान ह्यूजेन्स के पत्राचार में प्रकट हुई, लेकिन एक आंकड़े के उदाहरण के रूप में जो बीमांकिक विज्ञान के लिए अनुपयुक्त था।<ref name=":0" /> | माध्यिका का विचार सबसे पहले [[एडवर्ड राइट (गणितज्ञ)]] की 1599 की पुस्तक सर्टेनी एरर्स इन नेविगेशन में कम्पास नेविगेशन के बारे में एक खंड पर प्रकट हुआ होगा। राइट मापा मूल्यों को छोड़ने के लिए अनिच्छुक था, और यह महसूस किया हो सकता है कि मध्य-श्रेणी की तुलना में डेटासेट के अधिक अनुपात को सम्मलित करने वाले माध्यिका के सही होने की अधिक संभावना थी। चूंकि, राइट ने अपनी तकनीक के उपयोग का उदाहरण नहीं दिया, जिससे यह सत्यापित करना कठिन हो गया कि उन्होंने माध्यिका की आधुनिक धारणा का वर्णन किया है।<ref name=":0" /><ref name=":2" />{{Efn|Subsequent scholars appear to concur with Eisenhart that Boroughs' 1580 figures, while suggestive of the median, in fact describe an arithmetic mean.;<ref name="Eisenhart" />{{rp|62–3}} Boroughs is mentioned in no other work.}} माध्यिका (संभाव्यता के संदर्भ में) निश्चित रूप से क्रिस्टियान ह्यूजेन्स के पत्राचार में प्रकट हुई, लेकिन एक आंकड़े के उदाहरण के रूप में जो बीमांकिक विज्ञान के लिए अनुपयुक्त था।<ref name=":0" /> | ||

माध्यिका की सबसे पहली सिफारिश 1757 की है, जब [[रोजर जोसेफ बोस्कोविच]] ने L1 मानदंड|L के आधार पर एक प्रतिगमन विधि विकसित की थी।<sup>1</sup> मानदंड और इसलिए अप्रत्यक्ष रूप से माध्यिका पर।<ref name=":0" /><ref name="Stigler1986">{{cite book|last=Stigler|first=S. M.|url=https://archive.org/details/historyofstatist00stig|title=The History of Statistics: The Measurement of Uncertainty Before 1900|publisher=Harvard University Press|year=1986|isbn=0674403401}}</ref> 1774 में, पियरे-साइमन लाप्लास ने इस इच्छा को स्पष्ट किया: उन्होंने सुझाव दिया कि माध्यिका को पश्च संभाव्यता घनत्व फ़ंक्शन के मान के मानक अनुमानक के रूप में उपयोग किया जाना चाहिए। त्रुटि की अपेक्षित परिमाण को कम करने के लिए विशिष्ट मानदंड था | माध्यिका की सबसे पहली सिफारिश 1757 की है, जब [[रोजर जोसेफ बोस्कोविच]] ने L1 मानदंड|L के आधार पर एक प्रतिगमन विधि विकसित की थी।<sup>1</sup> मानदंड और इसलिए अप्रत्यक्ष रूप से माध्यिका पर।<ref name=":0" /><ref name="Stigler1986">{{cite book|last=Stigler|first=S. M.|url=https://archive.org/details/historyofstatist00stig|title=The History of Statistics: The Measurement of Uncertainty Before 1900|publisher=Harvard University Press|year=1986|isbn=0674403401}}</ref> 1774 में, पियरे-साइमन लाप्लास ने इस इच्छा को स्पष्ट किया: उन्होंने सुझाव दिया कि माध्यिका को पश्च संभाव्यता घनत्व फ़ंक्शन के मान के मानक अनुमानक के रूप में उपयोग किया जाना चाहिए। त्रुटि की अपेक्षित परिमाण को कम करने के लिए विशिष्ट मानदंड था, <math>|\alpha - \alpha^{*}|</math> कहाँ <math>\alpha^{*}</math> अनुमान है और <math>\alpha</math> सच्चा मूल्य है। इसके लिए, लाप्लास ने 1800 के प्रारंभिक दिनों में नमूना माध्य और नमूना माध्यिका दोनों के वितरण को निर्धारित किया।<ref name="Stigler1973" /><ref name="Laplace1818">Laplace PS de (1818) ''Deuxième supplément à la Théorie Analytique des Probabilités'', Paris, Courcier</ref> चूंकि, एक दशक बाद, [[कार्ल फ्रेडरिक गॉस]] और [[एड्रियन मैरी लीजेंड्रे]] ने कम से कम वर्ग विधि विकसित की, जो कम करता है <math>(\alpha - \alpha^{*})^{2}</math> माध्य प्राप्त करना। प्रतिगमन के संदर्भ में, गॉस और लेजेंड्रे के नवप्रवर्तन अत्यधिक आसान संगणना प्रदान करते है। परिणाम स्वरुप, 150 साल बाद कंप्यूटिंग डिवाइस#एनालॉग कंप्यूटर के उदय तक लेपलेस के प्रस्ताव को सामान्यतः खारिज कर दिया गया था (और अभी भी एक अपेक्षाकृत असामान्य एल्गोरिदम है)।<ref>{{cite book|last1=Jaynes|first1=E.T.|title=Probability theory : the logic of science|date=2007|publisher=Cambridge Univ. Press|location=Cambridge [u.a.]|isbn=978-0-521-59271-0|page=172|edition=5. print.}}</ref> | ||

1843 में [[एंटोनी ऑगस्टिन कोर्टन]] पहले थे<ref>{{Cite book|title=Dictionary of Mathematical Geosciences: With Historical Notes|last=Howarth|first=Richard|publisher=Springer|year=2017|pages=374}}</ref> मध्यिका शब्द का उपयोग उस मान के लिए करना जो संभाव्यता | 1843 में [[एंटोनी ऑगस्टिन कोर्टन]] पहले थे<ref>{{Cite book|title=Dictionary of Mathematical Geosciences: With Historical Notes|last=Howarth|first=Richard|publisher=Springer|year=2017|pages=374}}</ref> मध्यिका शब्द का उपयोग उस मान के लिए करना जो संभाव्यता वितरण को दो बराबर हिस्सों में विभाजित करता है। [[गुस्ताव थियोडोर फेचनर]] ने समाज मौलिक और मनोवैज्ञानिक घटनाओं में मध्यिका (सेंट्रलवर्थ) का उपयोग किया।<ref name="Keynes1921">Keynes, J.M. (1921) ''[[A Treatise on Probability]]''. Pt II Ch XVII §5 (p 201) (2006 reprint, Cosimo Classics, {{isbn|9781596055308}} : multiple other reprints)</ref> पहले इसका उपयोग केवल खगोल विज्ञान और संबंधित क्षेत्रों में किया जाता था। गुस्ताव थियोडोर फेचनर ने माध्यिका को डेटा के औपचारिक विश्लेषण में लोकप्रिय बनाया, चूंकि इसका उपयोग पहले लाप्लास द्वारा किया गया था,<ref name="Keynes1921" />और माध्यिका फ्रांसिस य्सिड्रो एजवर्थ|एफ की एक पाठ्यपुस्तक में दिखाई दी। वाई एडगेवर्थ।<ref>{{Cite book|last=Stigler|first=Stephen M.|url=https://books.google.com/books?id=qQusWukdPa4C&q=stigler+%22statistics+on+the+table%22|title=Statistics on the Table: The History of Statistical Concepts and Methods|date=2002|publisher=Harvard University Press|isbn=978-0-674-00979-0|pages=105–7|language=en}}</ref> [[फ्रांसिस गैल्टन]] ने 1881 में अंग्रेजी शब्द मेडियन का प्रयोग किया,<ref name=Galton1881>Galton F (1881) "Report of the Anthropometric Committee" pp 245–260. [https://www.biodiversitylibrary.org/item/94448 ''Report of the 51st Meeting of the British Association for the Advancement of Science'']</ref><ref>{{Cite journal|last=David|first=H. A.|date=1995|title=First (?) Occurrence of Common Terms in Mathematical Statistics|journal=The American Statistician|volume=49|issue=2|pages=121–133|doi=10.2307/2684625|jstor=2684625|issn=0003-1305}}</ref> पहले 1869 में मध्य-सबसे मूल्य और 1880 में माध्यम का उपयोग किया था।<ref>[https://www.encyclopediaofmath.org/index.php/Galton,_Francis ''encyclopediaofmath.org'']</ref><ref>[http://www.personal.psu.edu/users/e/c/ecb5/Courses/M475W/WeeklyReadings/Week%2013/DevelopmentOfModernStatistics.pdf ''personal.psu.edu'']</ref> | ||

सांख्यिकीविदों ने 19वीं शताब्दी के दौरान इसकी सहज स्पष्टता और मैन्युअल संगणना में आसानी के लिए माध्यकों के उपयोग को तीव्रता से प्रोत्साहित किया। चूंकि, माध्यिका की धारणा खुद को उच्च क्षणों के सिद्धांत के साथ-साथ अंकगणितीय माध्य के लिए उधार नहीं देती है, और कंप्यूटर द्वारा गणना करना बहुत कठिन है। परिणामस्वरूप, 20वीं शताब्दी के दौरान अंकगणितीय माध्य द्वारा सामान्य औसत की धारणा के रूप में औसत को लगातार हटा दिया गया।<ref name=":0" /><ref name=":2" /> | सांख्यिकीविदों ने 19वीं शताब्दी के दौरान इसकी सहज स्पष्टता और मैन्युअल संगणना में आसानी के लिए माध्यकों के उपयोग को तीव्रता से प्रोत्साहित किया। चूंकि, माध्यिका की धारणा खुद को उच्च क्षणों के सिद्धांत के साथ-साथ अंकगणितीय माध्य के लिए उधार नहीं देती है, और कंप्यूटर द्वारा गणना करना बहुत कठिन है। परिणामस्वरूप, 20वीं शताब्दी के दौरान अंकगणितीय माध्य द्वारा सामान्य औसत की धारणा के रूप में औसत को लगातार हटा दिया गया।<ref name=":0" /><ref name=":2" /> | ||

== यह भी देखें == | == यह भी देखें == | ||

Revision as of 07:06, 1 May 2023

सांख्यिकी और संभाव्यता सिद्धांत में, माध्यिका वह मान है जो डेटा नमूने के निचले आधे हिस्से से उच्च आधे हिस्से को अलग करता है। डेटा सेट के लिए, इसे "मध्य" मान के रूप में माना जा सकता है। माध्य की तुलना में डेटा का वर्णन करने में माध्यिका की मूल विशेषता (अधिकांशतः इसे "औसत" के रूप में वर्णित किया जाता है) यह है कि यह बहुत बड़े या छोटे मूल्यों के एक छोटे अनुपात से तिरछा नहीं होता है, और इसलिए केंद्र का बेहतर प्रतिनिधित्व प्रदान करता है। औसत आय, उदाहरण के लिए, आय वितरण के केंद्र का वर्णन करने का एक बेहतर विधि हो सकती है क्योंकि अकेले सबसे बड़ी आय में वृद्धि का माध्यिका पर कोई प्रभाव नहीं पड़ता है। इस कारण से, प्रबल संख्याओ में माध्यिका का केंद्रीय महत्व होता है।

संख्याओं का परिमित डेटा सेट

संख्याओं की एक परिमित सूची का मध्य संख्या होता है, जब उन संख्याओं को सबसे छोटे से सबसे बड़े क्रम में सूचीबद्ध किया जाता है।

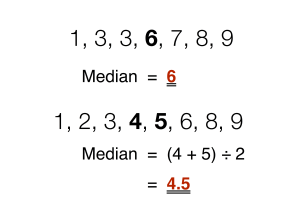

यदि डेटा सेट में विषम संख्या में अवलोकन होता है, तो बीच का चयन किया जाता है। उदाहरण के लिए, सात संख्याओं की निम्न सूची,

- 1, 3, 3, 6, 7, 8, 9

माध्यिका 6 है, जो चौथा मान है।

यदि डेटा सेट में टिप्पणियों की एक समान संख्या है, तो कोई विशिष्ट मध्य मान नहीं होता है और माध्यिका को सामान्यतः दो मध्य मानों के अंकगणितीय माध्य के रूप में परिभाषित किया जाता है।[1][2] उदाहरण के लिए, यह डेटा 8 अंकों का सेट है

- 1, 2, 3, 4, 5, 6, 8, 9

का माध्य मान 4.5 है, अर्थात . (अधिक तकनीकी शब्दों में, यह माध्यिका को पूरी तरह से ट्रिम किए गए अनुमानक मध्य-श्रेणी के रूप में व्याख्या करता है)।

सामान्यतः, इस सम्मेलन के साथ, माध्यिका को निम्नानुसार परिभाषित किया जा सकता है: डेटा सेट के लिए का तत्व, सबसे छोटे से सबसे बड़े के क्रम में,

- यदि असामान्य है,

- यदि सम है,

| प्रकार | विवरण | उदाहरण | परिणाम |

|---|---|---|---|

| मध्य स्तर | किसी डेटा सेट के न्यूनतम और अधिकतम के बीच का मध्य बिंदु | 1, 2, 2, 3, 4, 7, 9 | 5 |

| अंकगणित औसत | मानों की संख्या से विभाजित डेटा सेट के मानों का योग: | (1 + 2 + 2 + 3 + 4 + 7 + 9) / 7 | 4 |

| माध्यिका | डेटा सेट के बड़े और छोटे हिस्सों को अलग करने वाला मध्य मान | 1, 2, 2, 3, 4, 7, 9 | 3 |

| मोड | डेटा सेट में सबसे अधिक बार मान | 1, 2, 2, 3, 4, 7, 9 | 2 |

औपचारिक परिभाषा

औपचारिक रूप से, संख्या का एक औसत कोई भी मूल्य होता है जैसे कि कम से कम आधी संख्या प्रस्तावित औसत से कम या उसके बराबर होता है और कम से कम आधी प्रस्तावित औसत से अधिक या उसके बराबर होता है। जैसा कि ऊपर देखा गया है, माध्यिकाएँ अद्वितीय नहीं हो सकती है। यदि प्रत्येक सेट में आधी से कम संख्या होती है, तो कुछ संख्या अद्वितीय माध्यिका के बिल्कुल बराबर होती है।

माध्यिका किसी भी कमजोर क्रम डेटा के लिए अच्छी तरह से परिभाषित होता है, और किसी भी दूरी मीट्रिक से स्वतंत्र होता है। माध्यिका को इस प्रकार उन कक्षाओं पर लागू किया जा सकता है जो रैंक वाली है लेकिन संख्यात्मक नहीं होता है (उदाहरण के लिए जब छात्रों को ए से एफ तक ग्रेड दिया जाता है तो माध्यिका ग्रेड निकालना), चूंकि स्थितियों की संख्या सम होने पर परिणाम कक्षाओं के बीच में आधा होता है।

दूसरी ओर, एक ज्यामितीय माध्य, किसी भी संख्या में आयामों में परिभाषित किया गया है। एक संबंधित अवधारणा, जिसमें परिणाम को नमूने के एक सदस्य के अनुरूप होने के लिए मजबूर किया जाता है।

माध्यिका के लिए कोई व्यापक रूप से स्वीकृत मानक संकेतन नहीं होता है, लेकिन कुछ लेखक एक चर x के माध्यिका का प्रतिनिधित्व या तो x͂ या μ1/2 के रूप में करते है[1]कभी-कभी एम.[3][4] इनमें से किसी भी स्थिति में, माध्यिका के लिए अन्य प्रतीकों के उपयोग को स्पष्ट रूप से परिभाषित करने की आवश्यकता होती है जब उन्हें प्रस्तुत किया जाता है।

माध्यिका अन्य स्थान पैरामीटर की एक विशेष स्थिति है: यह दूसरा चतुर्थक, 5वाँ दशमक और 50वाँ प्रतिशतक है।

महत्वपूर्ण

माध्यिका का उपयोग स्थान पैरामीटर के माप के रूप में किया जा सकता है, जब कोई अत्यधिक मूल्यों को कम महत्व देता है, सामान्यतः क्योंकि वितरण तिरछा होता है, मान ज्ञात नहीं होते है, या ग़ैर अविश्वसनीय होते है, अर्थात माप/प्रतिलेखन त्रुटियाँ होती है।

उदाहरण के लिए, बहुसेट पर विचार करें

- 1, 2, 2, 2, 3, 14।

इस स्थिति में माध्यिका 2 है, जैसा कि मोड (सांख्यिकी) है, और इसे 4 के अंकगणितीय माध्य की तुलना में केंद्रीय प्रवृत्ति के बेहतर संकेत के रूप में देखा जा सकता है, जो कि मूल्यों में से एक को छोड़कर सभी से बड़ा है। चूंकि, व्यापक रूप से उद्धृत अनुभवजन्य संबंध है कि माध्य की तुलना में माध्य को वितरण की पूंछ में आगे स्थानांतरित कर दिया जाता है, यह सामान्यतः सच नहीं है। अधिक से अधिक, कोई यह कह सकता है कि दो आँकड़े बहुत दूर नहीं हो सकते, § असमानता संबंधित साधन और माध्यिकाएँ नीचे देखे।[5]

चूंकि एक मध्यिका एक सेट में मध्य डेटा पर आधारित होती है, इसकी गणना करने के लिए चरम परिणामों के मूल्य को जानना आवश्यक नहीं होता है। उदाहरण के लिए, किसी समस्या को हल करने के लिए आवश्यक समय की जांच करने वाले मनोविज्ञान परीक्षण में, यदि बहुत कम संख्या में लोग दिए गए समय में समस्या को हल करने में विफल रहता है, तब भी माध्यिका की गणना की जा सकती है।[6]

क्योंकि मध्यिका समझने में आसान और गणना करने में आसान होती है, जबकि माध्य के लिए एक प्रबल सन्निकटन भी है, माध्यिका वर्णनात्मक संख्याओं में एक लोकप्रिय सारांश संख्या है। इस संदर्भ में, परिवर्तनशीलता (सांख्यिकी) के माप के लिए कई विकल्प है: श्रेणी (सांख्यिकी), अंतःचतुर्थक श्रेणी, माध्य निरपेक्ष विचलन, और माध्य निरपेक्ष विचलन।

व्यावहारिक उद्देश्यों के लिए, स्थान और फैलाव के विभिन्न उपायों की तुलना अधिकांशतः इस आधार पर की जाती है कि डेटा के नमूने से संबंधित संख्या मूल्यों का कितना अच्छा अनुमान लगाया जा सकता है। माध्यिका, नमूना माध्यिका का उपयोग करके अनुमानित, इस संबंध में अच्छे गुण होते है। चूंकि यह सामान्यतः इष्टतम नहीं होता है यदि किसी दिए गए संख्या वितरण को मान लिया जाए, इसके गुण हमेशा यथोचित रूप से अच्छे होते है। उदाहरण के लिए, उम्मीदवार अनुमानकों की दक्षता (सांख्यिकी) की तुलना से पता चलता है कि नमूना माध्य अधिक सांख्यिकीय रूप से कुशल है कब—और केवल कब—डेटा वितरणों के मिश्रण से से असंदूषित है। फिर भी, माध्यिका में न्यूनतम-विचरण माध्य (बड़े सामान्य नमूनों के लिए) की तुलना में 64% दक्षता है, जिसका कहना है कि माध्यिका का प्रसरण माध्य के विचरण से ~50% अधिक होता है।[7][8]

संभाव्यता वितरण

संचयी वितरण फ़ंक्शन F के साथ किसी वास्तविक संख्या-मूल्यवान संभाव्यता वितरण के लिए, माध्यिका को किसी वास्तविक संख्या m के रूप में परिभाषित किया जाता है जो असमानताओं को संतुष्ट करता है

विशेष वितरण के माध्यम

कुछ प्रकार के वितरणों के माध्यों की गणना उनके प्राचलों से आसानी से की जा सकती है, इसके अतिरिक्त, वे कुछ वितरणों के लिए भी उपस्थित है जिनमें एक अच्छी तरह से परिभाषित माध्य की कमी होती है, जैसे कॉची वितरण:

- एक सममित वितरण का माध्य बहुलक के साथ मेल खाता है।

- एक सममित वितरण का माध्यिका जिसका माध्य μ होता है, वह भी μ मान लेता है।

- माध्य μ और प्रसरण σ2 के साथ एक सामान्य वितरण का माध्यिका μ है। वास्तव में, एक सामान्य वितरण के लिए, माध्य = माध्यिका = बहुलक।

- अंतराल [ए, बी] में एक समान वितरण (निरंतर) का माध्यिका (ए+बी) /2 है, जो माध्य भी है।

- स्थान पैरामीटर x0 के साथ कॉची वितरण की माध्यिका और स्केल पैरामीटर y x0 है।

- एक पावर लॉ x का माध्यिका−a, घातांक a के साथ > 1, 2 होता है1/(ए − 1)xmin, जहां एक्सmin न्यूनतम मूल्य है जिसके लिए शक्ति कानून धारण करता है[10]

- दर पैरामीटर λ के साथ एक घातीय वितरण का माध्य 2 का प्राकृतिक लघुगणक दर पैरामीटर द्वारा विभाजित है: λ−1ln 2.

- आकृति पैरामीटर k और स्केल पैरामीटर λ के साथ वेइबुल वितरण का माध्य λ(ln 2) है1/k.

गुण

अनुकूलता संपत्ति

यादृच्छिक चर X के संबंध में एक वास्तविक चर c की औसत पूर्ण त्रुटि है

बशर्ते कि X का प्रायिकता वितरण ऐसा हो कि उपरोक्त अपेक्षा उपस्थित हो, तो m, X का एक माध्यिका है यदि और केवल यदि m, X के संबंध में माध्य निरपेक्ष त्रुटि का न्यूनतम है।[11] विशेष रूप से, यदि m एक नमूना माध्यिका है, तो यह निरपेक्ष विचलनों के अंकगणितीय माध्य को कम करता है।[12] चूँकि, ध्यान दें कि ऐसे स्थितियों में जहाँ नमूने में समान संख्या में तत्व होते है, यह मिनिमाइज़र अद्वितीय नहीं होता है।

अधिक सामान्यतः, एक औसत को न्यूनतम के रूप में परिभाषित किया जाता है

जैसा कि बहुभिन्नरूपी माध्यिकाओं (विशेष रूप से, स्थानिक माध्यिका) पर अनुभाग में नीचे चर्चा की गई है।

माध्यिका की यह अनुकूलन-आधारित परिभाषा सांख्यिकीय डेटा-विश्लेषण में उपयोगी है, उदाहरण के लिए, k-माध्यिका क्लस्टरिंग|k-माध्यिका क्लस्टरिंग।

असमानता संबंधित साधन और माध्यिका

यदि वितरण में परिमित विचरण है, तो माध्यिका के बीच की दूरी और मतलब एक मानक विचलन से घिरा है।

इस सीमा को 1979 में असतत नमूनों के लिए बुक और शेर द्वारा सिद्ध किया गया था,[13] और सामान्यतः 1982 में पेज और मूर्ति द्वारा।[14] O'Cinneide द्वारा बाद के प्रमाण पर एक टिप्पणी में,[15] 1991 में मॉलोज़ ने एक संक्षिप्त प्रमाण प्रस्तुत किया जो जेन्सेन की असमानता का दो बार उपयोग करता है,[16] निम्नलिखित नुसार। |· का उपयोग करके, हमारे पास है

पहली और तीसरी असमानताएँ जेन्सेन की असमानता से आती है जो निरपेक्ष-मूल्य फ़ंक्शन और वर्ग फ़ंक्शन पर लागू होती है, जो प्रत्येक उत्तल है। दूसरी असमानता इस तथ्य से आती है कि एक माध्यिका निरपेक्ष विचलन फलन को न्यूनतम करती है .

असमानता के एक बहुभिन्नरूपी संस्करण को प्राप्त करने के लिए मैलोज़ के प्रमाण को सामान्यीकृत किया जा सकता है[17] बस पूर्ण मूल्य को एक मानक (गणित) के साथ बदलकर:

जहाँ m एक स्थानिक माध्यिका है, जो कि फ़ंक्शन का एक न्यूनतम है स्थानिक माध्य अद्वितीय होता है जब डेटा-सेट का आयाम दो या अधिक होता है।[18][19] एक वैकल्पिक प्रमाण एकतरफा चेबीशेव असमानता का उपयोग करता है, यह स्थान और पैमाने के मापदंडों पर एक असमानता में प्रकट होता है # एक अनुप्रयोग - माध्य और माध्यिका के बीच की दूरी। यह सूत्र भी कैंटेली की असमानता से सीधे अनुसरण करता है।[20]

यूनिमॉडल डिस्ट्रीब्यूशन

एकरूपता वितरण के स्थिति में, माध्यिका और माध्य के बीच की दूरी पर एक तेज सीमा प्राप्त कर सकते है:

- .[21]

माध्यिका और बहुलक के बीच एक समान संबंध होता है:

माध्यिका के लिए जेन्सेन की असमानता

जेन्सेन की असमानता बताती है कि किसी भी यादृच्छिक चर एक्स के लिए एक परिमित अपेक्षा ई [एक्स] और किसी भी उत्तल समारोह एफ के लिए

यह असमानता माध्यिका के लिए भी सामान्य है। हम एक समारोह कहते है f: R → R एक C फंक्शन है, यदि किसी t के लिए,

एक बंद अंतराल है (एक सिंगलटन (गणित) या एक खाली सेट के पतित स्थितियों की अनुमति)। प्रत्येक उत्तल कार्य एक सी कार्य है, लेकिन विपरीत धारण नहीं करता है। यदि f एक C फलन है, तब

यदि माध्यिकाएँ अद्वितीय नहीं है, तो कथन संबंधित सर्वोच्चता के लिए मान्य है।[22]

नमूने के लिए मेडियन

नमूना औसत

नमूना माध्यिका की कुशल गणना

यदि छँटाई एल्गोरिथ्म | तुलना-सॉर्टिंग एन आइटम की आवश्यकता है Ω(n log n) संचालन, चयन एल्गोरिदम ऑर्डर स्टेटिस्टिक की गणना कर सकते हैkसबसे छोटा n आइटम केवल के साथ Θ(n) संचालन। इसमें माध्यिका सम्मलित है, जो कि है n/2वें क्रम के आँकड़े (या सम संख्या के नमूनों के लिए, दो मध्य क्रम के संख्याओ का अंकगणितीय माध्य)।[23] चयन एल्गोरिदम में अभी भी आवश्यकता का नकारात्मक पहलू है Ω(n) मेमोरी, अर्थात, उन्हें स्मृति में पूर्ण नमूना (या इसका एक रैखिक आकार वाला भाग) रखने की आवश्यकता है। क्योंकि यह, साथ ही साथ रैखिक समय की आवश्यकता निषेधात्मक हो सकती है, माध्यिका के लिए कई आकलन प्रक्रियाएं विकसित की गई है। एक साधारण नियम तीन नियमों का माध्यिका है, जो माध्यिका को तीन-तत्व उपनमूने के माध्यिका के रूप में अनुमानित करता है, यह सामान्यतः जल्दी से सुलझाएं सॉर्टिंग एल्गोरिदम में सबरूटीन के रूप में उपयोग किया जाता है, जो इसके इनपुट के माध्यिका के अनुमान का उपयोग करता है। एक अधिक प्रबल अनुमानक जॉन टुकी का नौवां है, जो सीमित पुनरावर्तन के साथ लागू तीन नियमों का माध्यिका है:[24] यदि A एक सरणी (डेटा संरचना) के रूप में रखा गया नमूना है, और

- med3(A) = median(A[1], A[n/2], A[n]),

तब

- ninther(A) = med3(med3(A[1 ... 1/3n]), med3(A[1/3n ... 2/3n]), med3(A[2/3n ... n]))

रेमेडियन माध्यिका के लिए एक अनुमानक है जिसके लिए रैखिक समय की आवश्यकता होती है लेकिन उप-रैखिक मेमोरी, नमूने पर एक ही पास में काम करती है।[25]

नमूना वितरण

नमूना माध्य और नमूना मध्यिका दोनों का वितरण पियरे-साइमन लाप्लास द्वारा निर्धारित किया गया था।[26] घनत्व फ़ंक्शन वाली संख्या से नमूना माध्यिका का वितरण माध्य के साथ असम्बद्ध रूप से सामान्य है और विचरण[27]

कहाँ की माध्यिका है और नमूना आकार है। एक आधुनिक प्रमाण नीचे दिया गया है। लाप्लास के परिणाम को अब क्वांटाइल के एक विशेष स्थिति के रूप में समझा जाता है # एक नमूने से क्वांटाइल का अनुमान लगाना।

सामान्य नमूनों के लिए, घनत्व है , इस प्रकार बड़े नमूनों के लिए माध्यिका का प्रसरण बराबर होता है [7] (नीचे सेक्शन #Efficiency भी देखें।)

स्पर्शोन्मुख वितरण की व्युत्पत्ति

हम नमूना आकार को एक विषम संख्या के रूप में लेते है और हमारे चर को निरंतर मानें, असतत चर के स्थिति का सूत्र नीचे दिया गया है § Empirical local density. नमूने को माध्यिका के नीचे, माध्यिका पर और माध्यिका से ऊपर के रूप में संक्षेपित किया जा सकता है, जो संभावनाओं के साथ त्रिनोमियल वितरण से मेल खाता है , और . एक सतत चर के लिए, कई नमूना मानों की औसत के बराबर बराबर होने की संभावना 0 है, इसलिए कोई बिंदु पर घनत्व की गणना कर सकता है सीधे ट्रिनोमियल वितरण से:

- .

अब हम बीटा फ़ंक्शन का परिचय देते है। पूर्णांक तर्कों के लिए और , इसे इस रूप में व्यक्त किया जा सकता है . साथ ही, इसे याद करें . इन संबंधों का उपयोग करना और दोनों को स्थापित करना और के बराबर अंतिम अभिव्यक्ति के रूप में लिखे जाने की अनुमति देता है

इसलिए माध्यिका का घनत्व कार्य एक सममित बीटा वितरण पुशफॉरवर्ड माप है . इसका माध्य, जैसा कि हम आशा करते है, 0.5 है और इसका प्रसरण है . श्रृंखला नियम द्वारा, नमूना माध्यिका का संगत विचरण है

- .

अतिरिक्त 2 नगण्य सीमा (गणित) है।

अनुभवजन्य स्थानीय घनत्व

व्यवहार में, कार्य और अधिकांशतः ज्ञात या ग्रहण नहीं किया जाता है। चूँकि, उनका अनुमान एक प्रेक्षित आवृत्ति वितरण से लगाया जा सकता है। इस खंड में, हम एक उदाहरण देते है। निम्नलिखित तालिका पर विचार करें, जो 3,800 (असतत-मूल्यवान) टिप्पणियों के नमूने का प्रतिनिधित्व करती है:

| v | 0 | 0.5 | 1 | 1.5 | 2 | 2.5 | 3 | 3.5 | 4 | 4.5 | 5 |

|---|---|---|---|---|---|---|---|---|---|---|---|

| f(v) | 0.000 | 0.008 | 0.010 | 0.013 | 0.083 | 0.108 | 0.328 | 0.220 | 0.202 | 0.023 | 0.005 |

| F(v) | 0.000 | 0.008 | 0.018 | 0.031 | 0.114 | 0.222 | 0.550 | 0.770 | 0.972 | 0.995 | 1.000 |

क्योंकि अवलोकन असतत-मूल्यवान है, माध्यिका के त्रुटिहीन वितरण का निर्माण उपरोक्त अभिव्यक्ति का तत्काल अनुवाद नहीं है , किसी के नमूने में माध्यिका के कई उदाहरण हो सकते है (और सामान्यतः होते है)। इसलिए हमें इन सभी संभावनाओं का योग करना चाहिए:

यहाँ, i माध्यिका से सख्ती से कम अंकों की संख्या है और k संख्या सख्ती से अधिक है।

इन प्रारंभिकताओं का उपयोग करते हुए, माध्य और माध्यिका की मानक त्रुटियों पर नमूना आकार के प्रभाव की जांच करना संभव है। प्रेक्षित माध्य 3.16 है, अवलोकित अपरिष्कृत मध्यिका 3 है और अवलोकित प्रक्षेपित मध्यिका 3.174 है। निम्न तालिका कुछ तुलनात्मक आँकड़े देती है।

Sample size Statistic |

3 | 9 | 15 | 21 |

|---|---|---|---|---|

| माध्यिका का अपेक्षित मूल्य | 3.198 | 3.191 | 3.174 | 3.161 |

| माध्यिका की मानक त्रुटि (सूत्र के ऊपर) | 0.482 | 0.305 | 0.257 | 0.239 |

| माध्यिका की मानक त्रुटि (असिम्प्टोटिक सन्निकटन) | 0.879 | 0.508 | 0.393 | 0.332 |

| माध्य की मानक त्रुटि | 0.421 | 0.243 | 0.188 | 0.159 |

माध्यिका का अपेक्षित मान थोड़ा कम हो जाता है क्योंकि नमूना आकार बढ़ता है, जैसा कि अपेक्षित होगा, माध्यिका और माध्य दोनों की मानक त्रुटियाँ नमूना आकार के व्युत्क्रम वर्गमूल के अनुपात में होती है। स्पर्शोन्मुख सन्निकटन मानक त्रुटि को कम करके सावधानी के पक्ष में गलतियाँ करता है।

नमूना डेटा से भिन्नता का अनुमान

का मान है - का विषम मूल्य कहाँ संख्या औसत है-कई लेखकों द्वारा अध्ययन किया गया है। मानक डिलीट वन रीसैंपलिंग (सांख्यिकी) #Jackknife विधि लगातार अनुमानक परिणाम उत्पन्न करती है।[28] एक विकल्प—डिलीट k विधि—जहाँ नमूना आकार के साथ बढ़ता है विषम रूप से सुसंगत दिखाया गया है।[29] बड़े डेटा सेट के लिए यह विधि कम्प्यूटेशनल रूप से महंगी हो सकती है। बूटस्ट्रैप अनुमान सुसंगत होने के लिए जाना जाता है,[30] लेकिन बहुत धीरे-धीरे अभिसरण करता है (कम्प्यूटेशनल जटिलता सिद्धांत ).[31] अन्य तरीके प्रस्तावित किए गए है लेकिन उनका व्यवहार बड़े और छोटे नमूनों के बीच भिन्न हो सकता है।[32]

दक्षता

नमूना माध्यिका की दक्षता (आँकड़े), माध्यिका के विचरण के माध्य के विचरण के अनुपात के रूप में मापी जाती है, नमूना आकार और अंतर्निहित संख्या वितरण पर निर्भर करती है। आकार के नमूने के लिए सामान्य वितरण से, बड़े एन के लिए दक्षता है

दक्षता की ओर प्रवृत्त होता है जैसा अनंत की ओर जाता है।

दूसरे शब्दों में, माध्यिका का आपेक्षिक प्रसरण होगा , या माध्य के विचरण से 57% अधिक - माध्यिका की सापेक्ष मानक त्रुटि होगी , या माध्य की मानक त्रुटि से 25% अधिक, (ऊपर अनुभाग #नमूना वितरण भी देखें।)[33]

अन्य अनुमानक

अविभाजित वितरणों के लिए जो एक माध्यिका के बारे में सममित है, हॉजेस-लेहमन अनुमानक एक प्रबल आँकड़े और संख्या माध्यिका की अत्यधिक दक्षता (आँकड़े) है।[34] यदि डेटा एक सांख्यिकीय मॉडल द्वारा प्रतिनिधित्व किया जाता है जो संभाव्यता वितरण के एक विशेष परिवार को निर्दिष्ट करता है, तो माध्यिका का अनुमान उस संभाव्यता वितरण के परिवार को डेटा में फिट करके और फिट किए गए वितरण के सैद्धांतिक माध्य की गणना करके प्राप्त किया जा सकता है। पेरेटो प्रक्षेप इसका एक अनुप्रयोग है जब संख्या को पारेटो वितरण माना जाता है।

बहुभिन्नरूपी माध्यिका

इससे पहले, इस लेख में अविभाजित माध्यिका पर चर्चा की गई थी, जब नमूना या संख्या का एक-आयाम था। जब आयाम दो या उच्चतर होता है, तो ऐसी कई अवधारणाएँ होती है जो एकविभाजित माध्यिका की परिभाषा का विस्तार करती है, इस तरह के प्रत्येक बहुभिन्नरूपी माध्यिका एकात्मक माध्यिका से सहमत होती है जब आयाम बिल्कुल एक होता है।[34][35][36][37]

सीमांत माध्यिका

निर्देशांक के एक निश्चित सेट के संबंध में परिभाषित वैक्टर के लिए सीमांत माध्य परिभाषित किया गया है। एक सीमांत माध्यिका को सदिश के रूप में परिभाषित किया जाता है, जिसके घटक अविभाजित माध्यिकाएँ है। सीमांत मध्यिका की गणना करना आसान है, और इसके गुणों का अध्ययन पुरी और सेन द्वारा किया गया था।[34][38]

ज्यामितीय माध्यिका

नमूना बिंदुओं के असतत सेट का ज्यामितीय माध्यिका यूक्लिडियन अंतरिक्ष में है[lower-alpha 1] नमूना बिंदुओं के लिए दूरियों के योग को कम करने वाला बिंदु।

सीमांत माध्यिका के विपरीत, ज्यामितीय माध्य यूक्लिडियन समानता (ज्यामिति) जैसे अनुवाद (ज्यामिति) और रोटेशन (गणित) के संबंध में समान है।

सभी दिशाओं में माध्यिका

यदि सभी समन्वय प्रणालियों के लिए सीमांत माध्यिकाएं मेल खाती है, तो उनके सामान्य स्थान को सभी दिशाओं में माध्यिका कहा जा सकता है।[40] यह अवधारणा माध्यिका मतदाता प्रमेय के कारण मतदान सिद्धांत के लिए प्रासंगिक है। जब यह उपस्थित होता है, तो सभी दिशाओं में माध्य ज्यामितीय माध्यिका (कम से कम असतत वितरण के लिए) के साथ मेल खाता है।

केंद्र बिंदु

उच्च आयामों में माध्यिका का एक वैकल्पिक सामान्यीकरण केंद्र बिंदु (ज्यामिति) है।

अन्य मध्य-संबंधित अवधारणाएँ

इंटरपोलेटेड माध्यिका

असतत चर के साथ व्यवहार करते समय, कभी-कभी देखे गए मूल्यों को अंतर्निहित निरंतर अंतराल के मध्य बिंदु के रूप में मानना उपयोगी होता है। इसका एक उदाहरण लिकर्ट पैमाना है, जिस पर संभावित प्रतिक्रियाओं की एक निर्धारित संख्या के साथ एक पैमाने पर राय या प्राथमिकताएं व्यक्त की जाती है। यदि पैमाने में सकारात्मक पूर्णांक होते है, तो 3 के अवलोकन को 2.50 से 3.50 के अंतराल का प्रतिनिधित्व करने वाला माना जा सकता है। अंतर्निहित चर के माध्यिका का अनुमान लगाना संभव है। यदि, कहते है, 22% प्रेक्षणों का मान 2 या उससे कम है और 55.0% का मान 3 या उससे कम है (इसलिए 33% का मान 3 है), तो माध्यक 3 है क्योंकि माध्यिका का सबसे छोटा मान है जिसके लिए आधे से अधिक है। लेकिन प्रक्षेपित औसत कहीं 2.50 और 3.50 के बीच है। पहले हम अंतराल की चौड़ाई का आधा हिस्सा जोड़ते है माध्यिका अंतराल की ऊपरी सीमा प्राप्त करने के लिए माध्यिका के लिए। फिर हम अंतराल चौड़ाई के उस अनुपात को घटाते है जो 33% के अनुपात के बराबर होता है जो 50% चिह्न से ऊपर होता है। दूसरे शब्दों में, हम अंतराल चौड़ाई को प्रेक्षणों की संख्या के अनुपात में विभाजित करते है। इस स्थिति में, 33% माध्यिका के नीचे 28% और उसके ऊपर 5% में विभाजित है, इसलिए हम 3.50 के ऊपरी सीमा से अंतराल चौड़ाई के 5/33 को घटाकर 3.35 का एक प्रक्षेपित औसत देते है। अधिक औपचारिक रूप से, यदि मान ज्ञात है, प्रक्षेपित माध्यिका की गणना की जा सकती है

वैकल्पिक रूप से, यदि देखे गए नमूने में है औसत श्रेणी से ऊपर स्कोर, इसमें स्कोर और इसके नीचे स्कोर तो इंटरपोलेटेड माध्यिका द्वारा दिया जाता है

छद्म-माध्यिका

अविभाजित वितरणों के लिए जो एक माध्यिका के बारे में सममित है, हॉजेस-लेहमन अनुमानक संख्या मध्यिका का एक प्रबल और अत्यधिक कुशल अनुमानक है, गैर-सममित वितरण के लिए, हॉजेस-लेहमन अनुमानक संख्या छद्म-माध्यिका का एक प्रबल और अत्यधिक कुशल अनुमानक है, जो एक सममित वितरण का माध्यिका है और जो संख्या मध्यिका के करीब है।[41] हॉजेस-लेहमन अनुमानक को बहुभिन्नरूपी वितरणों के लिए सामान्यीकृत किया गया है।[42]

प्रतिगमन के वेरिएंट

थिल-सेन अनुमानक ढलानों के माध्यिका खोजने के आधार पर प्रबल सांख्यिकी रेखीय प्रतिगमन के लिए एक विधि है।[43]

माध्य फ़िल्टर

मध्य फ़िल्टर मूर्ति प्रोद्योगिकी का एक महत्वपूर्ण उपकरण है, जो ग्रेस्केल इमेज से किसी भी नमक और काली मिर्च के शोर को प्रभावी ढंग से हटा सकता है।

क्लस्टर विश्लेषण

क्लस्टर विश्लेषण में, k-माध्यिका क्लस्टरिंग एल्गोरिदम क्लस्टर्स को परिभाषित करने का एक विधि प्रदान करता है, जिसमें क्लस्टर-साधनों के बीच की दूरी को अधिकतम करने का मानदंड जो कि k-मतलब क्लस्टरिंग में उपयोग किया जाता है, को क्लस्टर-माध्यकों के बीच की दूरी को अधिकतम करके बदल दिया जाता है।

माध्यिका-मध्य रेखा

यह प्रबल प्रतिगमन की एक विधि है। यह विचार 1940 में अब्राहम का जन्म हुआ के समय का है, जिन्होंने द्विचर डेटा के एक सेट को स्वतंत्र पैरामीटर के मान के आधार पर दो हिस्सों में विभाजित करने का सुझाव दिया था। : माध्यिका से कम मानों वाला बायां आधा भाग और माध्यिका से अधिक मानों वाला दायां आधा भाग।[44] उन्होंने आश्रित के साधन लेने का सुझाव दिया और स्वतंत्र बाएँ और दाएँ हिस्सों के चर और इन दो बिंदुओं को मिलाने वाली रेखा के ढलान का अनुमान लगाना। डेटा सेट में अधिकांश बिंदुओं को फिट करने के लिए लाइन को तब समायोजित किया जा सकता है।

1942 में नायर और श्रीवास्तव ने एक समान विचार का सुझाव दिया, लेकिन उप-नमूने के साधनों की गणना करने से पहले नमूने को तीन बराबर भागों में विभाजित करने की वकालत की।[45] ब्राउन और मूड ने 1951 में साधन के अतिरिक्त दो उप-नमूने के माध्यिका का उपयोग करने का विचार प्रस्तावित किया।[46] टकी ने इन विचारों को संयोजित किया और नमूने को तीन समान आकार के उपनमूने में विभाजित करने और उप-नमूने के माध्यिका के आधार पर रेखा का अनुमान लगाने की सिफारिश की।[47]

माध्य-निष्पक्ष अनुमानक

औसत-निष्पक्ष आकलनकर्ता का कोई भी पूर्वाग्रह चुकता-त्रुटि हानि फ़ंक्शन के संबंध में जोखिम (अपेक्षित हानि) को कम करता है, जैसा कि गॉस द्वारा देखा गया है। ए एस्टिमेटर का पूर्वाग्रह # माध्य निष्पक्ष अनुमानक, और अन्य हानि कार्यों के संबंध में पूर्वाग्रह | मध्य-निष्पक्ष अनुमानक पूर्ण विचलन के संबंध में जोखिम को कम करता है। पूर्ण-विचलन हानि फ़ंक्शन, जैसा कि लाप्लास द्वारा देखा गया है। अन्य नुकसान कार्यों का उपयोग सांख्यिकीय सिद्धांत में किया जाता है, विशेष रूप से प्रबल संख्याओं में।

1947 में जॉर्ज डब्ल्यू. ब्राउन द्वारा मध्य-निष्पक्ष आकलनकर्ताओं के सिद्धांत को पुनर्जीवित किया गया:[48]

एक-आयामी पैरामीटर θ का एक अनुमान मध्य-निष्पक्ष कहा जाएगा, यदि निश्चित θ के लिए, अनुमान के वितरण का औसत मान θ पर है; यानी, अनुमान उतनी ही बार कम करके आंका जाता है जितनी बार यह अधिक अनुमान लगाता है। यह आवश्यकता अधिकांश उद्देश्यों के लिए औसत-निष्पक्ष आवश्यकता को पूरा करने के लिए प्रतीत होती है और इसकी अतिरिक्त संपत्ति है कि यह एक-से-एक परिवर्तन के तहत अपरिवर्तनीय है।

— page 584

मध्य-निष्पक्ष आकलनकर्ताओं के और गुणों की सूचना दी गई है।[49][50][51][52] मध्य-निष्पक्ष आकलनकर्ता अंतःक्रियात्मक फलन|एक-से-एक परिवर्तन के अनुसार अपरिवर्तनीय है।

मध्य-निष्पक्ष आकलनकर्ताओं के निर्माण के तरीके है जो इष्टतम है (माध्य-निष्पक्ष अनुमानकों के लिए न्यूनतम-विचरण संपत्ति के समान अर्थ में)। मोनोटोन संभावना अनुपात वाले संभाव्यता वितरण के लिए इस तरह के निर्माण उपस्थित है। मोनोटोन संभावना-कार्य।[53][54] ऐसी ही एक प्रक्रिया राव-ब्लैकवेल प्रमेय का एक एनालॉग है। माध्य-निष्पक्ष आकलनकर्ताओं के लिए राव-ब्लैकवेल प्रक्रिया: यह प्रक्रिया राव-ब्लैकवेल प्रक्रिया की तुलना में संभाव्यता वितरण के एक छोटे वर्ग के लिए है, लेकिन हानि कार्यों के एक बड़े वर्ग के लिए है।[55]

इतिहास

प्राचीन निकट पूर्व में वैज्ञानिक शोधकर्ताओं ने सारांश संख्याओं का पूरी तरह से उपयोग नहीं किया है, इसके अतिरिक्त उन मूल्यों का चयन किया है जो एक व्यापक सिद्धांत के साथ अधिकतम स्थिरता प्रदान करते है जो विभिन्न प्रकार की घटनाओं को एकीकृत करता है।[56] भूमध्यसागरीय (और, बाद में, यूरोपीय) विद्वानों के समुदाय के भीतर, माध्य जैसे आँकड़े मौलिक रूप से मध्ययुगीन और प्रारंभिक आधुनिक विकास है। (यूरोप के बाहर माध्यिका का इतिहास और इसके पूर्ववर्तियों का अपेक्षाकृत अध्ययन नहीं किया गया है।)

भिन्न आर्थिक मूल्यांकन का निष्पक्ष विश्लेषण करने के लिए माध्यिका का विचार 6वीं शताब्दी में तल्मूड में प्रकट हुआ।[57][58] चूँकि, यह अवधारणा व्यापक वैज्ञानिक समुदाय में नहीं फैली।

इसके अतिरिक्त, आधुनिक माध्यिका का निकटतम पूर्वज अल-बिरूनी द्वारा आविष्कृत मध्य-श्रेणी है।[59]: 31 [60] बाद के विद्वानों के लिए अल-बिरूनी के कार्य का प्रसारण अस्पष्ट है। अल-बिरूनी ने अपनी तकनीक को धातुओं की जांच के लिए लागू किया, लेकिन, उनके काम को प्रकाशित करने के बाद, अधिकांश परखने वालों ने अभी भी अपने परिणामों से सबसे प्रतिकूल मूल्य को अपनाया, ऐसा न हो कि वे मानमर्दन दिखाई दें।[59]: 35–8 चूंकि, डिस्कवरी के युग के दौरान समुद्र में नेविगेशन में वृद्धि का मतलब था कि जहाज के नेविगेटर को तेजी से शत्रुतापूर्ण तटों के विरुद्ध प्रतिकूल मौसम में अक्षांश का निर्धारण करने का प्रयास करना पड़ा, जिससे सारांश संख्याओं में नए सिरे से रुचि उत्पन्न हुई। चाहे फिर से खोजा गया हो या स्वतंत्र रूप से आविष्कार किया गया हो, हैरियट के निर्देशों में रैले की यात्रा के लिए गुयाना, 1595 में समुद्री नाविकों के लिए मध्य-श्रेणी की सिफारिश की गई है।[59]: 45–8

माध्यिका का विचार सबसे पहले एडवर्ड राइट (गणितज्ञ) की 1599 की पुस्तक सर्टेनी एरर्स इन नेविगेशन में कम्पास नेविगेशन के बारे में एक खंड पर प्रकट हुआ होगा। राइट मापा मूल्यों को छोड़ने के लिए अनिच्छुक था, और यह महसूस किया हो सकता है कि मध्य-श्रेणी की तुलना में डेटासेट के अधिक अनुपात को सम्मलित करने वाले माध्यिका के सही होने की अधिक संभावना थी। चूंकि, राइट ने अपनी तकनीक के उपयोग का उदाहरण नहीं दिया, जिससे यह सत्यापित करना कठिन हो गया कि उन्होंने माध्यिका की आधुनिक धारणा का वर्णन किया है।[56][60][lower-alpha 2] माध्यिका (संभाव्यता के संदर्भ में) निश्चित रूप से क्रिस्टियान ह्यूजेन्स के पत्राचार में प्रकट हुई, लेकिन एक आंकड़े के उदाहरण के रूप में जो बीमांकिक विज्ञान के लिए अनुपयुक्त था।[56]

माध्यिका की सबसे पहली सिफारिश 1757 की है, जब रोजर जोसेफ बोस्कोविच ने L1 मानदंड|L के आधार पर एक प्रतिगमन विधि विकसित की थी।1 मानदंड और इसलिए अप्रत्यक्ष रूप से माध्यिका पर।[56][61] 1774 में, पियरे-साइमन लाप्लास ने इस इच्छा को स्पष्ट किया: उन्होंने सुझाव दिया कि माध्यिका को पश्च संभाव्यता घनत्व फ़ंक्शन के मान के मानक अनुमानक के रूप में उपयोग किया जाना चाहिए। त्रुटि की अपेक्षित परिमाण को कम करने के लिए विशिष्ट मानदंड था, कहाँ अनुमान है और सच्चा मूल्य है। इसके लिए, लाप्लास ने 1800 के प्रारंभिक दिनों में नमूना माध्य और नमूना माध्यिका दोनों के वितरण को निर्धारित किया।[26][62] चूंकि, एक दशक बाद, कार्ल फ्रेडरिक गॉस और एड्रियन मैरी लीजेंड्रे ने कम से कम वर्ग विधि विकसित की, जो कम करता है माध्य प्राप्त करना। प्रतिगमन के संदर्भ में, गॉस और लेजेंड्रे के नवप्रवर्तन अत्यधिक आसान संगणना प्रदान करते है। परिणाम स्वरुप, 150 साल बाद कंप्यूटिंग डिवाइस#एनालॉग कंप्यूटर के उदय तक लेपलेस के प्रस्ताव को सामान्यतः खारिज कर दिया गया था (और अभी भी एक अपेक्षाकृत असामान्य एल्गोरिदम है)।[63] 1843 में एंटोनी ऑगस्टिन कोर्टन पहले थे[64] मध्यिका शब्द का उपयोग उस मान के लिए करना जो संभाव्यता वितरण को दो बराबर हिस्सों में विभाजित करता है। गुस्ताव थियोडोर फेचनर ने समाज मौलिक और मनोवैज्ञानिक घटनाओं में मध्यिका (सेंट्रलवर्थ) का उपयोग किया।[65] पहले इसका उपयोग केवल खगोल विज्ञान और संबंधित क्षेत्रों में किया जाता था। गुस्ताव थियोडोर फेचनर ने माध्यिका को डेटा के औपचारिक विश्लेषण में लोकप्रिय बनाया, चूंकि इसका उपयोग पहले लाप्लास द्वारा किया गया था,[65]और माध्यिका फ्रांसिस य्सिड्रो एजवर्थ|एफ की एक पाठ्यपुस्तक में दिखाई दी। वाई एडगेवर्थ।[66] फ्रांसिस गैल्टन ने 1881 में अंग्रेजी शब्द मेडियन का प्रयोग किया,[67][68] पहले 1869 में मध्य-सबसे मूल्य और 1880 में माध्यम का उपयोग किया था।[69][70] सांख्यिकीविदों ने 19वीं शताब्दी के दौरान इसकी सहज स्पष्टता और मैन्युअल संगणना में आसानी के लिए माध्यकों के उपयोग को तीव्रता से प्रोत्साहित किया। चूंकि, माध्यिका की धारणा खुद को उच्च क्षणों के सिद्धांत के साथ-साथ अंकगणितीय माध्य के लिए उधार नहीं देती है, और कंप्यूटर द्वारा गणना करना बहुत कठिन है। परिणामस्वरूप, 20वीं शताब्दी के दौरान अंकगणितीय माध्य द्वारा सामान्य औसत की धारणा के रूप में औसत को लगातार हटा दिया गया।[56][60]

यह भी देखें

- पूर्ण विचलन

- एक अनुमानक का पूर्वाग्रह

- केंद्रीय प्रवृत्ति

- Lipschitz कार्यों के लिए माप की एकाग्रता

- माध्यिका ग्राफ

- माध्यिकाओं की माध्यिका - रैखिक समय में अनुमानित माध्यिका की गणना करने के लिए एल्गोरिथम

- औसत खोज

- माध्यिका ढाल

- औसत मतदाता सिद्धांत

- मेडोइड्स - उच्च आयामों में माध्यिका का सामान्यीकरण

टिप्पणियाँ

संदर्भ

- ↑ 1.0 1.1 Weisstein, Eric W. "Statistical Median". MathWorld.

- ↑ Simon, Laura J.; "Descriptive statistics" Archived 2010-07-30 at the Wayback Machine, Statistical Education Resource Kit, Pennsylvania State Department of Statistics

- ↑ David J. Sheskin (27 August 2003). पैरामीट्रिक और गैर पैरामीट्रिक सांख्यिकीय प्रक्रियाओं की पुस्तिका (Third ed.). CRC Press. pp. 7–. ISBN 978-1-4200-3626-8. Retrieved 25 February 2013.

- ↑ Derek Bissell (1994). एसपीसी और टीक्यूएम के लिए सांख्यिकीय तरीके. CRC Press. pp. 26–. ISBN 978-0-412-39440-9. Retrieved 25 February 2013.

- ↑ Paul T. von Hippel (2005). "Mean, Median, and Skew: Correcting a Textbook Rule". Journal of Statistics Education. 13 (2). Archived from the original on 2008-10-14. Retrieved 2015-06-18.

- ↑ Robson, Colin (1994). मनोविज्ञान में प्रयोग, डिजाइन और सांख्यिकी. Penguin. pp. 42–45. ISBN 0-14-017648-9.

- ↑ 7.0 7.1 Williams, D. (2001). बाधाओं का वजन. Cambridge University Press. p. 165. ISBN 052100618X.

- ↑ Maindonald, John; Braun, W. John (2010-05-06). Data Analysis and Graphics Using R: An Example-Based Approach (in English). Cambridge University Press. p. 104. ISBN 978-1-139-48667-5.

- ↑ "एपी सांख्यिकी समीक्षा - घनत्व वक्र और सामान्य वितरण". Archived from the original on 8 April 2015. Retrieved 16 March 2015.

- ↑ Newman, Mark EJ. "Power laws, Pareto distributions and Zipf's law." Contemporary physics 46.5 (2005): 323–351.

- ↑ Stroock, Daniel (2011). सिद्धांत संभावना. Cambridge University Press. pp. 43. ISBN 978-0-521-13250-3.

- ↑ André Nicolas (https://math.stackexchange.com/users/6312/andr%c3%a9-nicolas), The Median Minimizes the Sum of Absolute Deviations (The $ {L}_{1} $ Norm), URL (version: 2012-02-25): https://math.stackexchange.com/q/113336

- ↑ Stephen A. Book; Lawrence Sher (1979). "How close are the mean and the median?". The Two-Year College Mathematics Journal. 10 (3): 202–204. doi:10.2307/3026748. JSTOR 3026748. Retrieved 12 March 2022.

- ↑ Warren Page; Vedula N. Murty (1982). "Nearness Relations Among Measures of Central Tendency and Dispersion: Part 1". The Two-Year College Mathematics Journal. 13 (5): 315–327. doi:10.1080/00494925.1982.11972639 (inactive 31 December 2022). Retrieved 12 March 2022.

{{cite journal}}: CS1 maint: DOI inactive as of December 2022 (link) - ↑ O'Cinneide, Colm Art (1990). "माध्य किसी भी माध्यिका के एक मानक विचलन के भीतर है". The American Statistician. 44 (4): 292–293. doi:10.1080/00031305.1990.10475743. Retrieved 12 March 2022.

- ↑ Mallows, Colin (August 1991). "O'Kinneide पर एक और टिप्पणी". The American Statistician. 45 (3): 257. doi:10.1080/00031305.1991.10475815.

- ↑ Piché, Robert (2012). रैंडम वैक्टर और रैंडम सीक्वेंस. Lambert Academic Publishing. ISBN 978-3659211966.

- ↑ Kemperman, Johannes H. B. (1987). Dodge, Yadolah (ed.). "The median of a finite measure on a Banach space: Statistical data analysis based on the L1-norm and related methods". Papers from the First International Conference Held at Neuchâtel, August 31–September 4, 1987. Amsterdam: North-Holland Publishing Co.: 217–230. MR 0949228.

- ↑ Milasevic, Philip; Ducharme, Gilles R. (1987). "स्थानिक माध्यिका की विशिष्टता". Annals of Statistics. 15 (3): 1332–1333. doi:10.1214/aos/1176350511. MR 0902264.

- ↑ K.Van Steen Notes on probability and statistics

- ↑ Basu, S.; Dasgupta, A. (1997). "The Mean, Median, and Mode of Unimodal Distributions:A Characterization". Theory of Probability and Its Applications. 41 (2): 210–223. doi:10.1137/S0040585X97975447. S2CID 54593178.

- ↑ Merkle, M. (2005). "माध्यिका के लिए जेन्सेन की असमानता". Statistics & Probability Letters. 71 (3): 277–281. doi:10.1016/j.spl.2004.11.010.

- ↑ Alfred V. Aho and John E. Hopcroft and Jeffrey D. Ullman (1974). कंप्यूटर एल्गोरिदम का डिजाइन और विश्लेषण. Reading/MA: Addison-Wesley. ISBN 0-201-00029-6. Here: Section 3.6 "Order Statistics", p.97-99, in particular Algorithm 3.6 and Theorem 3.9.

- ↑ Bentley, Jon L.; McIlroy, M. Douglas (1993). "इंजीनियरिंग एक तरह का कार्य". Software: Practice and Experience. 23 (11): 1249–1265. doi:10.1002/spe.4380231105. S2CID 8822797.

- ↑ Rousseeuw, Peter J.; Bassett, Gilbert W. Jr. (1990). "The remedian: a robust averaging method for large data sets" (PDF). J. Amer. Statist. Assoc. 85 (409): 97–104. doi:10.1080/01621459.1990.10475311.

- ↑ 26.0 26.1 Stigler, Stephen (December 1973). "Studies in the History of Probability and Statistics. XXXII: Laplace, Fisher and the Discovery of the Concept of Sufficiency". Biometrika. 60 (3): 439–445. doi:10.1093/biomet/60.3.439. JSTOR 2334992. MR 0326872.

- ↑ Rider, Paul R. (1960). "कई विशेष आबादी से छोटे नमूनों की माध्यिका का प्रसरण". J. Amer. Statist. Assoc. 55 (289): 148–150. doi:10.1080/01621459.1960.10482056.

- ↑ Efron, B. (1982). द जैकनाइफ, द बूटस्ट्रैप और अन्य रीसैंपलिंग योजनाएं. Philadelphia: SIAM. ISBN 0898711797.

- ↑ Shao, J.; Wu, C. F. (1989). "जैकनाइफ भिन्नता अनुमान के लिए एक सामान्य सिद्धांत". Ann. Stat. 17 (3): 1176–1197. doi:10.1214/aos/1176347263. JSTOR 2241717.

- ↑ Efron, B. (1979). "Bootstrap Methods: Another Look at the Jackknife". Ann. Stat. 7 (1): 1–26. doi:10.1214/aos/1176344552. JSTOR 2958830.

- ↑ Hall, P.; Martin, M. A. (1988). "बूटस्ट्रैप क्वांटाइल वेरिएंस एस्टीमेटर की सटीक अभिसरण दर". Probab Theory Related Fields. 80 (2): 261–268. doi:10.1007/BF00356105. S2CID 119701556.

- ↑ Jiménez-Gamero, M. D.; Munoz-García, J.; Pino-Mejías, R. (2004). "माध्यिका के लिए कम बूटस्ट्रैप". Statistica Sinica. 14 (4): 1179–1198.

- ↑ Maindonald, John; John Braun, W. (2010-05-06). Data Analysis and Graphics Using R: An Example-Based Approach. ISBN 9781139486675.

- ↑ 34.0 34.1 34.2 Hettmansperger, Thomas P.; McKean, Joseph W. (1998). मजबूत गैर पैरामीट्रिक सांख्यिकीय तरीके. Kendall's Library of Statistics. Vol. 5. London: Edward Arnold. ISBN 0-340-54937-8. MR 1604954.

- ↑ Small, Christopher G. "A survey of multidimensional medians." International Statistical Review/Revue Internationale de Statistique (1990): 263–277. doi:10.2307/1403809 JSTOR 1403809

- ↑ Niinimaa, A., and H. Oja. "Multivariate median." Encyclopedia of statistical sciences (1999).

- ↑ Mosler, Karl. Multivariate Dispersion, Central Regions, and Depth: The Lift Zonoid Approach. Vol. 165. Springer Science & Business Media, 2012.